WordStar – Als Tastaturkürzel König waren und DOS die Bühne hielt

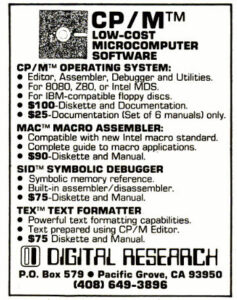

Als Mikrocomputer Ende der siebziger Jahre zunehmend in Werkstätten, Büros und Hobbykellern auftauchten, wuchs der Wunsch nach einer Textverarbeitung, die ernsthafte Schreibarbeit ermöglichen konnte. Seymour I. Rubinstein, vormals bei IMSAI tätig, erkannte diese Lücke und gründete 1978 MicroPro International. Er engagierte den außergewöhnlich begabten Programmierer Rob Barnaby, der bereits zuvor systemnahe Editoren für CP/M entwickelt hatte und in Fachkreisen als jemand galt, der Programme eher aus der Perspektive der Maschine als jener des Anwenders dachte. Zeitgenossen beschrieben ihn als einen Entwickler, der keine Rücksicht auf konventionelle Benutzerführung nahm, sondern darauf vertraute, dass Menschen seine effiziente, aber anspruchsvolle Logik erlernen konnten. Ein Ausspruch, den frühere Kollegen Barnabys überlieferten, bringt dies gut auf den Punkt: „Rob wrote software for the computer, and expected people to keep up“ („Rob schrieb Software für den Computer und erwartete, dass die Menschen mithalten“).

Als Mikrocomputer Ende der siebziger Jahre zunehmend in Werkstätten, Büros und Hobbykellern auftauchten, wuchs der Wunsch nach einer Textverarbeitung, die ernsthafte Schreibarbeit ermöglichen konnte. Seymour I. Rubinstein, vormals bei IMSAI tätig, erkannte diese Lücke und gründete 1978 MicroPro International. Er engagierte den außergewöhnlich begabten Programmierer Rob Barnaby, der bereits zuvor systemnahe Editoren für CP/M entwickelt hatte und in Fachkreisen als jemand galt, der Programme eher aus der Perspektive der Maschine als jener des Anwenders dachte. Zeitgenossen beschrieben ihn als einen Entwickler, der keine Rücksicht auf konventionelle Benutzerführung nahm, sondern darauf vertraute, dass Menschen seine effiziente, aber anspruchsvolle Logik erlernen konnten. Ein Ausspruch, den frühere Kollegen Barnabys überlieferten, bringt dies gut auf den Punkt: „Rob wrote software for the computer, and expected people to keep up“ („Rob schrieb Software für den Computer und erwartete, dass die Menschen mithalten“).

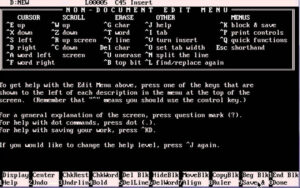

Barnaby entwickelte WordStar zwischen 1978 und 1979 fast vollständig in handoptimiertem 8080-Assembler, und weil CP/M-Systeme nur 64 Kilobyte Arbeitsspeicher boten, entwarf er ein ausgeklügeltes Overlay-System, das Programmteile je nach Bedarf nachlud. Dass viele Terminals dieser Zeit keine Pfeiltasten besaßen, führte zu seinem berühmten Steuerungsdiamanten: Ctrl-S, Ctrl-E, Ctrl-D und Ctrl-X für die Bewegung des Cursors. Dieser Tastensatz wurde auf Dutzenden Plattformen übernommen und machte WordStar zu einem Werkzeug, das überall gleich funktionierte – ein Vorteil, den kein Konkurrent jener Zeit in diesem Umfang bieten konnte. Ein Nutzer erinnerte sich viele Jahre später: „Once you got the hang of the WordStar keystroke diamond it was magic to use“ („Wenn man den WordStar-Diamond einmal beherrschte, war er magisch zu benutzen“).

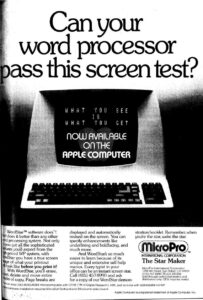

WordStar erschien im Juni 1979 zu einem Preis von 495 US-Dollar, inflationsbereinigt rund 1.300 Euro. Der Betrag war hoch, aber WordStar bot Funktionen, die seiner Zeit voraus waren: automatischer Zeilenumbruch, Seitenvorschau im Textmodus, Blockbearbeitung, Seriendruck, einfaches Makrosystem und eine sauber strukturierte Dokument- und Nicht-Dokument-Logik. Durch OEM-Bundles, insbesondere mit dem Osborne 1, verbreitete sich das Programm schnell. BYTE schrieb 1983 anerkennend: „without a doubt the best-known and probably the most widely used personal computer word-processing program“ („ohne Zweifel das bekannteste und wahrscheinlich am weitesten verbreitete Textverarbeitungsprogramm für Personal Computer“). ThoughtCo bezeichnet WordStar später als „the first commercially successful word-processing software program for microcomputers“ („die erste kommerziell erfolgreiche Textverarbeitungssoftware für Mikrocomputer“). Rubinstein sagte rückblickend: „WordStar was a tremendous learning experience. I didn’t know all that much about the world of big business“ („WordStar war eine gewaltige Lernerfahrung. Ich wusste nicht allzu viel über die Welt des großen Geschäfts“).

Intern verlief die Entwicklung allerdings unruhig. Der rapide wachsende Erfolg erforderte Teamarbeit, doch Barnabys ursprünglicher Quelltext war maschinennah, komplex und nur spärlich dokumentiert. Mehrere Entwickler mussten später Teile des Codes praktisch neu erschließen, als das Programm für MS-DOS und weitere Plattformen angepasst wurde. Trotz dieser Herausforderungen blieb WordStar über Jahre das dominierende Schreibwerkzeug auf CP/M und frühen DOS-Rechnern.

Intern verlief die Entwicklung allerdings unruhig. Der rapide wachsende Erfolg erforderte Teamarbeit, doch Barnabys ursprünglicher Quelltext war maschinennah, komplex und nur spärlich dokumentiert. Mehrere Entwickler mussten später Teile des Codes praktisch neu erschließen, als das Programm für MS-DOS und weitere Plattformen angepasst wurde. Trotz dieser Herausforderungen blieb WordStar über Jahre das dominierende Schreibwerkzeug auf CP/M und frühen DOS-Rechnern.

Die Fachpresse sah WordStar zugleich als mächtig und schwierig. PC Magazine sprach von einer „arrogant indifference to user feedback“ („arroganten Gleichgültigkeit gegenüber Nutzerfeedback“) und bezeichnete es dennoch als „the most powerful word processor available“ („die mächtigste verfügbare Textverarbeitung“). Diese doppelte Wahrnehmung fasst die Retroanalyse gut zusammen, die WordStar als „arrogant, difficult, powerful“ („arrogant, schwierig, mächtig“) einstuft. Die Lernkurve war steil, aber wer sie meisterte, schrieb schneller als mit jedem anderen Programm seiner Zeit.

Während WordStar Anfang der achtziger Jahre Marktführer war, gewann WordPerfect rasch an Boden. Ein zeitgenössischer Tester beschrieb WordPerfect als „more than full-featured“ („mehr als voll ausgestattet“) und betonte Funktionen, die in WordStar fehlten, insbesondere im Bereich Druckeransteuerung und Formatlogik. MicroPros Antwort, WordStar 2000, entfernte sich so weit vom bekannten Bedienkonzept, dass viele treue Nutzer es ablehnten; ein Tester spottete, es habe „all the charm of an elephant on motorized skates“ („den Charme eines Elefanten auf motorisierten Rollschuhen“).

Der Niedergang setzte sich in den frühen neunziger Jahren fort, bis MicroPro schließlich in anderen Firmenstrukturen aufging. Dennoch bleibt WordStar ein kulturelles Phänomen, das weit über seine technische Ära hinausstrahlt. Der Science-Fiction-Autor Robert J. Sawyer schrieb seine Werke bis in die 2010er-Jahre in WordStar 7 unter MS-DOS, und George R. R. Martin erklärte öffentlich, er nutze bis heute WordStar 4.0 auf einem vom Netz getrennten Rechner, weil moderne Programme ihn beim Schreiben störten. Sein Satz „I don’t want any help“ („Ich will keine Hilfe“) beschreibt treffend jene Schlichtheit, die viele Autoren auch Jahrzehnte später noch an WordStar schätzen.

Heute lebt WordStar in Emulationen wie DOSBox-X weiter, und seine Tastenkombinationen haben den Sprung in Unix-Editoren wie „jstar“ geschafft. WordStar ist damit eines der wenigen Textverarbeitungsprogramme, dessen Erbe nicht in Menüs oder Icons, sondern im Muskelgedächtnis seiner Nutzer fortbesteht. Es war nie das freundlichste Programm, aber eines der kraftvollsten – ein Werkzeug aus einer Ära, in der Software nicht dekoriert, sondern geschmiedet wurde, und in der Geschwindigkeit und Präzision den Ausschlag gaben.

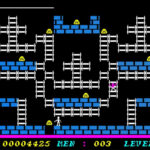

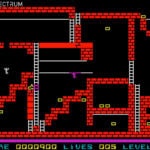

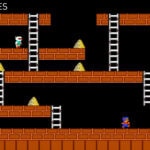

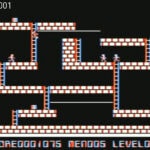

In einer Zeit, als das mobile Internet noch sündhaft teuer mit Dublonen oder der eigenen Seele bezahlt werden musste, war der Mobilfunknutzer auf wenige Möglichkeiten der Unterhaltung während der Busfahrt beschränkt, sofern er nicht immer wieder alte SMS sichten oder aber telefonieren wollte. Nokia hatte mit den Nutzern Mitleid und präsentierte ab 1997 Kurzweil – und diese Kurzweil hieß Snake. Preislich war Snake untrennbar mit dem Kauf eines Nokia-Handys verbunden – es war also faktisch kostenlos. Dass ein monochromes Display mit vier Richtungen und einer stetigen Bewegung der Schlange eine ganze Generation prägen würde, erwartete damals niemand. Doch das Spiel wurde auf über 350 Millionen Geräten ausgeliefert und damit zu einem der populärsten Titel der Welt, gespielt in Pausenhöfen, in U-Bahnen, in überlangen Schulstunden und in stillen Momenten, in denen das Telefon sonst nur Uhrzeit, Akku und die obligatorische SMS-Zahl anzeigte. Doch Nokia hatte das Spiel nicht erfunden.

In einer Zeit, als das mobile Internet noch sündhaft teuer mit Dublonen oder der eigenen Seele bezahlt werden musste, war der Mobilfunknutzer auf wenige Möglichkeiten der Unterhaltung während der Busfahrt beschränkt, sofern er nicht immer wieder alte SMS sichten oder aber telefonieren wollte. Nokia hatte mit den Nutzern Mitleid und präsentierte ab 1997 Kurzweil – und diese Kurzweil hieß Snake. Preislich war Snake untrennbar mit dem Kauf eines Nokia-Handys verbunden – es war also faktisch kostenlos. Dass ein monochromes Display mit vier Richtungen und einer stetigen Bewegung der Schlange eine ganze Generation prägen würde, erwartete damals niemand. Doch das Spiel wurde auf über 350 Millionen Geräten ausgeliefert und damit zu einem der populärsten Titel der Welt, gespielt in Pausenhöfen, in U-Bahnen, in überlangen Schulstunden und in stillen Momenten, in denen das Telefon sonst nur Uhrzeit, Akku und die obligatorische SMS-Zahl anzeigte. Doch Nokia hatte das Spiel nicht erfunden.

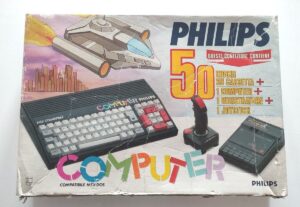

Als der Philips NMS 801 im Jahr 1989 auf dem italienischen Markt erschien, war die große MSX-Ära bereits Geschichte. Die Heimcomputerlandschaft befand sich im Wandel, und Philips versuchte, mit einem ungewöhnlichen Hybridgerät zwischen Konsole und Computer noch einmal Fuß zu fassen. Der NMS 801 war auf den ersten Blick ein vertrautes Mitglied der NMS-Familie – graues Kunststoffgehäuse, MSX-typische Formensprache – doch hinter der Fassade verbarg sich ein System, das nur vorgab, ein MSX zu sein.

Als der Philips NMS 801 im Jahr 1989 auf dem italienischen Markt erschien, war die große MSX-Ära bereits Geschichte. Die Heimcomputerlandschaft befand sich im Wandel, und Philips versuchte, mit einem ungewöhnlichen Hybridgerät zwischen Konsole und Computer noch einmal Fuß zu fassen. Der NMS 801 war auf den ersten Blick ein vertrautes Mitglied der NMS-Familie – graues Kunststoffgehäuse, MSX-typische Formensprache – doch hinter der Fassade verbarg sich ein System, das nur vorgab, ein MSX zu sein.

Wenn man in der frühen PC-Geschichte nach jenen Maschinen sucht, die nicht wegen bunter Grafik oder Arcade-Ambitionen glänzten, sondern wegen ihrer Zuverlässigkeit, dann taucht der Cromemco C-10 schnell als ein Vertreter dieser stillen Klasse auf. Ein Rechner, der 1982 den persönlichen Computer als professionelles Werkzeug definierte – in einer Zeit, als viele andere Systeme noch zwischen Heimcomputer-Spaß und ernsthaften Anwendungen schwankten.

Wenn man in der frühen PC-Geschichte nach jenen Maschinen sucht, die nicht wegen bunter Grafik oder Arcade-Ambitionen glänzten, sondern wegen ihrer Zuverlässigkeit, dann taucht der Cromemco C-10 schnell als ein Vertreter dieser stillen Klasse auf. Ein Rechner, der 1982 den persönlichen Computer als professionelles Werkzeug definierte – in einer Zeit, als viele andere Systeme noch zwischen Heimcomputer-Spaß und ernsthaften Anwendungen schwankten. In den Spielhallen von 1985 gab es nicht viele Rennspiele, die gleich beim Anschalten so deutlich sagten: „Ich bin größer als dein Fernseher zu Hause.“ Buggy Boy, entwickelt von Tatsumi Electronics, setzte genau dieses Statement — im wahrsten Sinne dreifach. Die Deluxe-Variante des Automaten nutzte drei nebeneinander angeordnete Monitore für eine Panorama-Sicht, die selbst in der Epoche prächtiger Röhren eine Seltenheit war. Der technische Unterbau: zwei Intel-8086-CPUs für Grafik & Spielablauf, ein Z80 als Sound-Prozessor, flankiert von zwei AY-3-8910-Soundchips, die für dieses prägnant fröhliche Offroad-Gezwitscher verantwortlich waren. Die Auflösung variierte je nach Kabinett, typisch rund 512×224 Pixel, und war schnell genug, um üppig scrollende Rennlandschaften darzustellen. Sprünge über Baumstämme, Banden, Tore und aufblinkende Flaggen ließen das Fahrgefühl hektisch, aber stets nachvollziehbar wirken — Arcade-Physik at its finest.

In den Spielhallen von 1985 gab es nicht viele Rennspiele, die gleich beim Anschalten so deutlich sagten: „Ich bin größer als dein Fernseher zu Hause.“ Buggy Boy, entwickelt von Tatsumi Electronics, setzte genau dieses Statement — im wahrsten Sinne dreifach. Die Deluxe-Variante des Automaten nutzte drei nebeneinander angeordnete Monitore für eine Panorama-Sicht, die selbst in der Epoche prächtiger Röhren eine Seltenheit war. Der technische Unterbau: zwei Intel-8086-CPUs für Grafik & Spielablauf, ein Z80 als Sound-Prozessor, flankiert von zwei AY-3-8910-Soundchips, die für dieses prägnant fröhliche Offroad-Gezwitscher verantwortlich waren. Die Auflösung variierte je nach Kabinett, typisch rund 512×224 Pixel, und war schnell genug, um üppig scrollende Rennlandschaften darzustellen. Sprünge über Baumstämme, Banden, Tore und aufblinkende Flaggen ließen das Fahrgefühl hektisch, aber stets nachvollziehbar wirken — Arcade-Physik at its finest.

In einer stillen Stunde des alten Japan fällt der Dämonenkönig über Meister und Schüler her; der Meister sinkt, der junge Krieger schwört Rache und jagt den Feind durch Raum und Zeit. First Samurai übersetzt diese klassische Racheballade in einen Seitenläufer, der Prügeleien, Plattform-Wege und kleine Rätselschleusen verbindet: Faust und Fuß, dann das funkelnde Katana, dazu Wurfäxte und Messer; verliert der Held zu viel Kraft, verliert er sein Schwert – eine elegante Dramaturgie, die in zeitgenössischen Tests als besonderer Spannungshebel hervorgehoben wurde. Die britische Presse war früh begeistert: “From the opening sequence to the final battle, this game drips quality.” („Von der Eröffnungssequenz bis zur letzten Schlacht trieft dieses Spiel vor Qualität.“) schrieb Amiga Power und vergab 91 %. Kurz darauf urteilte Amiga Format: “Gameplay, good coding and gloss. The total arcade package in one game.” („Gameplay, gutes Coding und Glanz. Das komplette Arcade-Paket in einem Spiel.“) – ebenfalls 91 %.

In einer stillen Stunde des alten Japan fällt der Dämonenkönig über Meister und Schüler her; der Meister sinkt, der junge Krieger schwört Rache und jagt den Feind durch Raum und Zeit. First Samurai übersetzt diese klassische Racheballade in einen Seitenläufer, der Prügeleien, Plattform-Wege und kleine Rätselschleusen verbindet: Faust und Fuß, dann das funkelnde Katana, dazu Wurfäxte und Messer; verliert der Held zu viel Kraft, verliert er sein Schwert – eine elegante Dramaturgie, die in zeitgenössischen Tests als besonderer Spannungshebel hervorgehoben wurde. Die britische Presse war früh begeistert: “From the opening sequence to the final battle, this game drips quality.” („Von der Eröffnungssequenz bis zur letzten Schlacht trieft dieses Spiel vor Qualität.“) schrieb Amiga Power und vergab 91 %. Kurz darauf urteilte Amiga Format: “Gameplay, good coding and gloss. The total arcade package in one game.” („Gameplay, gutes Coding und Glanz. Das komplette Arcade-Paket in einem Spiel.“) – ebenfalls 91 %.