Kapitel 1: der Weg in die Welt der digitalen Lamas

Foto: Vincent Diamante, CC BY-SA 2.0, via Wikimedia Commons

Manche Entwickler hinterlassen Spuren in der Geschichte der Videospiele. Andere hinterlassen Schafe, Lamas, Laserlinien und das Gefühl, dass Regeln in diesem Medium eher Vorschläge sind als Gesetze. Jeff Minter gehört zur zweiten Kategorie. Während viele Designer versuchten, ihre Spiele realistischer oder erzählerischer zu gestalten, schuf er Werke, die sich bewusst jeder Einordnung entzogen: schnell, abstrakt, farbintensiv und oft von Tieren bevölkert, die in anderen Spielen kaum vorkommen würden.

Diese Eigenart entstand nicht plötzlich. Minter wuchs in einem Umfeld auf, in dem Technik und wissenschaftliches Denken selbstverständlich waren, und las früh Science-Fiction-Autoren wie Isaac Asimov. Maschinen erschienen ihm daher weniger als Werkzeuge denn als Systeme, deren Verhalten sich verstehen und beeinflussen ließ.

Seine eigentliche Faszination entwickelte sich am College, wo ihm nur begrenzter Zugang zu einem einzigen Computer zur Verfügung stand – einem Commodore PET. Die knappe Nutzungszeit zwang dazu, Programme sorgfältig vorzubereiten und effizient umzusetzen. Für Minter wurde dieser Rechner bald interessanter als sein Studium selbst, das ihn zunehmend langweilte. Während er offiziell Mathematik und Physik belegte, verbrachte er einen Großteil seiner Zeit im Computerraum.

In dieser Phase entstand eines seiner ersten Programme, das Spiel Deflex, geschrieben für den PET. Minter beschreibt es rückblickend eher als frühes Übungsprojekt, das nie für eine Öffentlichkeit gedacht war, doch es markierte den Moment, in dem Programmieren für ihn von einer technischen Übung zu einem kreativen Medium wurde. Parallel dazu verbrachte er viel Zeit in Spielhallen, deren Rhythmus, Geschwindigkeit und Mechaniken ihn stärker prägten als deren Themen oder Geschichten.

In Highscore-Listen, die oft nur drei Zeichen zuließen, nutzte er früh den Spitznamen „Yak“. Der kurze Name passte sowohl zur technischen Begrenzung als auch zu seiner Vorliebe für ungewöhnliche Tiere und wurde später zu einem festen Bestandteil seiner öffentlichen Identität.

Als Heimcomputer Anfang der achtziger Jahre erschwinglicher wurden, begann Minter zu Hause eigene Programme zu schreiben. Mit einem Sinclair ZX80 konnte er erstmals unabhängig vom College-Computer arbeiten und entwickelte dort frühe Spiele, die er in kleinem Rahmen verkaufte. Die ungewöhnliche Tastatur des ZX80, deren Tasten jeweils ganze BASIC-Befehle ausgaben, erforderte zwar Eingewöhnung, erlaubte aber ein effizientes Programmieren, sobald man sich an die Eigenheiten des Systems gewöhnt hatte.

1982 gründete Minter schließlich Llamasoft, zunächst als kleines Familienunternehmen organisiert. Während er programmierte, übernahm seine Mutter organisatorische Aufgaben wie Versand, Bestellungen und Verwaltung. In einer Zeit, in der Software häufig noch per Post vertrieben wurde, war diese Unterstützung entscheidend dafür, dass aus einzelnen Programmen ein dauerhaftes Unternehmen entstehen konnte.

Kapitel 2: erste Veröffentlichungen, Andes Attack, Gridrunner und der Beginn seines Stils

Mit der Gründung von Llamasoft begann für Minter eine Phase, in der seine Experimente erstmals eine breitere Öffentlichkeit erreichten. Sein erstes unter diesem Namen veröffentlichtes Spiel war Andes Attack – in den USA als Aggressor vertrieben – eine lose an Defender angelehnte Produktion für den VIC-20. Schon hier zeigte sich ein Element, das später zu seinem Markenzeichen wurde: Statt Raumschiffen bevölkerten kleine Lamas den Bildschirm. Was zunächst wie ein humorvoller Einfall wirkte, entwickelte sich in den folgenden Jahren zu einem wiederkehrenden Motiv seiner Arbeit.

Mit der Gründung von Llamasoft begann für Minter eine Phase, in der seine Experimente erstmals eine breitere Öffentlichkeit erreichten. Sein erstes unter diesem Namen veröffentlichtes Spiel war Andes Attack – in den USA als Aggressor vertrieben – eine lose an Defender angelehnte Produktion für den VIC-20. Schon hier zeigte sich ein Element, das später zu seinem Markenzeichen wurde: Statt Raumschiffen bevölkerten kleine Lamas den Bildschirm. Was zunächst wie ein humorvoller Einfall wirkte, entwickelte sich in den folgenden Jahren zu einem wiederkehrenden Motiv seiner Arbeit.

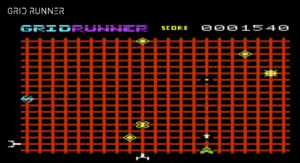

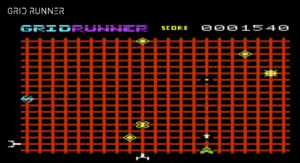

Kurz darauf entstand Gridrunner, das Minter eigenen Angaben zufolge in nur etwa einer Woche programmierte. Das Spiel zeigt bereits deutlich die Einflüsse früher Arcade-Titel, insbesondere Centipede. Minter kannte dieses zu Beginn offenbar vor allem aus Screenshots, was dazu führte, dass er das zugrunde liegende Spielprinzip eigenständig interpretierte und weiterentwickelte.

Wie bei Centipede steuert der Spieler ein Fahrzeug am unteren Bildschirmrand und schießt nach oben auf Gegner, die sich in schlangenartigen Formationen über das Spielfeld bewegen. In Gridrunner wandern diese sogenannten „Droids“ über ein festes Raster nach unten und müssen eliminiert werden, bevor sie den unteren Bildschirmrand erreichen. Zusätzlich treten seitliche Gefahren wie die sogenannten „XY-Zapper“ auf, die das Bewegungsfeld einschränken und den Druck auf den Spieler erhöhen.

Wie bei Centipede steuert der Spieler ein Fahrzeug am unteren Bildschirmrand und schießt nach oben auf Gegner, die sich in schlangenartigen Formationen über das Spielfeld bewegen. In Gridrunner wandern diese sogenannten „Droids“ über ein festes Raster nach unten und müssen eliminiert werden, bevor sie den unteren Bildschirmrand erreichen. Zusätzlich treten seitliche Gefahren wie die sogenannten „XY-Zapper“ auf, die das Bewegungsfeld einschränken und den Druck auf den Spieler erhöhen.

Im Vergleich zu seinem Vorbild ist Gridrunner deutlich schneller und hektischer angelegt. Statt der organisch wirkenden Spielfläche von Centipede nutzt es ein streng geometrisches Gitter, wodurch das Spiel weniger wie eine Simulation und stärker wie ein abstraktes Reaktionsspiel wirkt. Gerade diese Mischung aus erkennbarer Arcade-Inspiration und eigener Interpretation machte Gridrunner zu Minters erstem größeren Erfolg und zu einem frühen Beispiel für den Stil, der seine späteren Arbeiten prägen sollte.

Seine Spiele wirkten weniger wie Nachbildungen bekannter Arcade-Hits als wie persönliche Variationen auf deren Grundprinzipien. Während andere Entwickler bemüht waren, bekannte Genres möglichst exakt zu reproduzieren, schien Minter vor allem daran interessiert zu sein, ihre Regeln neu zu interpretieren.

In den folgenden Jahren erschienen weitere Produktionen, die diesen Ansatz fortführten und Minters Präsenz in der Heimcomputerszene festigten. Llamasoft blieb zwar ein kleines Unternehmen, entwickelte sich jedoch von einem improvisierten Familienbetrieb zu einem festen Bestandteil der britischen Softwarelandschaft – weiterhin geprägt vor allem von der Handschrift seines Gründers.

Mit dem Wechsel auf leistungsfähigere Heimcomputer wie den Commodore 64 erreichten Minters Ideen erstmals eine Plattform, auf der sie sich visuell und technisch deutlicher entfalten konnten. Eines der bekanntesten Ergebnisse dieser Phase war Attack of the Mutant Camels von 1983.

Mit dem Wechsel auf leistungsfähigere Heimcomputer wie den Commodore 64 erreichten Minters Ideen erstmals eine Plattform, auf der sie sich visuell und technisch deutlicher entfalten konnten. Eines der bekanntesten Ergebnisse dieser Phase war Attack of the Mutant Camels von 1983.

Das Spiel ist keine lose Genrevariation, sondern eine sehr direkte Hommage an The Empire Strikes Back von Parker Brothers für das Atari VCS. Wie dort bewegen sich große, schwer zerstörbare Gegner seitlich über den Bildschirm und müssen aufgehalten werden, bevor sie ihr Ziel erreichen. Auch das Grundprinzip – ein kleines Fluggerät des Spielers, das wiederholt auf massive Feinde feuert – entspricht dem Vorbild deutlich. Die Gegner wechseln ihre Farbe, um den erlittenen Schaden anzuzeigen, und erwidern das Feuer, wodurch ein ständiger Druck auf den Spieler entsteht.

Minters Version überträgt dieses Konzept jedoch in eine deutlich schnellere, farbintensivere und stilistisch eigenwillige Darstellung. Statt futuristischer Kriegsmaschinen erscheinen überdimensionierte Kamele, die sich über den Bildschirm bewegen. Diese Bildidee soll laut späteren Berichten darauf zurückgehen, dass Minter die AT-AT-Walker des Vorbilds zunächst für „mutierte Kamele“ hielt – eine Fehlinterpretation, die er nicht korrigierte, sondern bewusst in ein eigenes Spiel verwandelte.

Damit steht Attack of the Mutant Camels exemplarisch für Minters frühen Ansatz: Er übernahm bekannte Spielprinzipien, veränderte jedoch Tempo, Darstellung und Atmosphäre so stark, dass daraus eine eigenständige Handschrift entstand. Diese Mischung aus klarer Inspiration und persönlicher Interpretation sollte viele seiner späteren Arbeiten prägen.

Mit den folgenden Veröffentlichungen begann sich sein Stil deutlicher zu verfestigen. Besonders Revenge of the Mutant Camels führte das Konzept seines Vorgängers weiter, verschob den Schwerpunkt jedoch stärker auf Tempo, Effekte und wechselnde Spielsituationen. Dass im Hintergrund die Titelmelodie von Battlestar Galactica erklingt, während das Spiel erkennbar Anleihen bei The Empire Strikes Back nimmt, wirkt wie ein augenzwinkernder Kommentar zu seinen Inspirationsquellen.

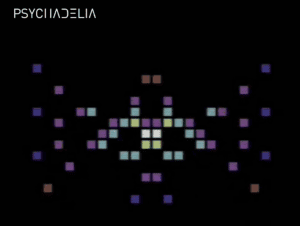

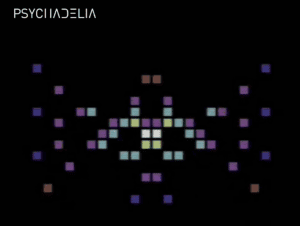

Noch deutlicher trat dieser experimentelle Ansatz in Psychedelia hervor. Das Programm war weniger ein Spiel als ein interaktives Grafikwerkzeug, mit dem Nutzer farbige Muster erzeugen konnten, die sich über den Bildschirm bewegten und miteinander reagierten. In einer Zeit, in der Heimcomputer meist als Werkzeuge oder Spielgeräte verstanden wurden, zeigte Psychedelia, dass sie auch als audiovisuelle Instrumente genutzt werden konnten.

Kapitel 3: Die 16-Bit-Ära – Neue Plattformen, neue Wahrnehmung

Mit dem Übergang zur 16-Bit-Generation veränderten sich die Rahmenbedingungen für Heimcomputerprogramme erneut. Systeme wie der Atari ST oder der Commodore Amiga boten nicht nur mehr Leistung, sondern wurden zunehmend auch in kreativen Anwendungen eingesetzt. Für Minter bedeutete diese Phase weniger einen Wechsel des Gerätetyps als eine Erweiterung seines Umfelds. Seine Spiele blieben schnell, abstrakt und auf unmittelbare Reaktion ausgelegt, konnten nun jedoch visuell deutlich komplexer umgesetzt werden.

Diese Entwicklung kulminierte Anfang der neunziger Jahre in einem Projekt, das Minters Bekanntheit weit über die Heimcomputerwelt hinaus tragen sollte. Mit Tempest 2000 erhielt er erstmals die Möglichkeit, ein bekanntes Arcade-Spiel nicht nur umzusetzen, sondern neu zu interpretieren. Der Titel erschien 1994 für den Atari Jaguar, eine Konsole, mit der Atari versuchte, im beginnenden 32-Bit-Zeitalter erneut im Markt Fuß zu fassen. Technisch ambitioniert, aber kommerziell nur begrenzt erfolgreich, bot das System Entwicklern dennoch die Chance, Spiele mit deutlich höherem audiovisuellen Anspruch umzusetzen als es in der klassischen Heimcomputerlandschaft üblich gewesen war.

Diese Entwicklung kulminierte Anfang der neunziger Jahre in einem Projekt, das Minters Bekanntheit weit über die Heimcomputerwelt hinaus tragen sollte. Mit Tempest 2000 erhielt er erstmals die Möglichkeit, ein bekanntes Arcade-Spiel nicht nur umzusetzen, sondern neu zu interpretieren. Der Titel erschien 1994 für den Atari Jaguar, eine Konsole, mit der Atari versuchte, im beginnenden 32-Bit-Zeitalter erneut im Markt Fuß zu fassen. Technisch ambitioniert, aber kommerziell nur begrenzt erfolgreich, bot das System Entwicklern dennoch die Chance, Spiele mit deutlich höherem audiovisuellen Anspruch umzusetzen als es in der klassischen Heimcomputerlandschaft üblich gewesen war.

Im Spiel bewegt sich der Spieler entlang geometrischer Spielflächen und schießt auf Gegner, die aus der Tiefe der Struktur nach oben drängen. Minter verband dieses einfache Grundprinzip mit hohem Tempo, intensiven Effekten und einer starken musikalischen Komponente, wodurch der Titel zu einem der meistbeachteten Spiele der Jaguar-Bibliothek wurde. Gleichzeitig blieb seine Handschrift unverkennbar: Statt Realismus oder erzählerischer Erweiterung setzte er auf Rhythmus, Wahrnehmung und Reaktionsfluss.

Zeitgenössische Berichte hoben vor allem das Tempo, die audiovisuelle Gestaltung und den hohen Wiederspielwert hervor. Für viele Beobachter war Tempest 2000 weniger ein Lizenzprodukt als ein persönliches Werk innerhalb einer größeren Produktionsstruktur. Damit wurde Minter erstmals nicht nur als Heimcomputerentwickler wahrgenommen, sondern als eigenständige Designerfigur innerhalb einer international beobachteten Spielelandschaft.

Kommerziell blieb der Erfolg jedoch eng an die Grenzen der Plattform gebunden. Bereits bis April 1995 wurden auf dem Atari Jaguar über 30.000 Exemplare verkauft, und das Spiel entwickelte sich zum zweitbestverkauften Titel des Systems. Da sich die Hardware selbst nur im niedrigen sechsstelligen Bereich verbreitete, lag das Marktpotenzial naturgemäß begrenzt. Einschließlich späterer Umsetzungen für andere Systeme gehen historische Schätzungen heute von einer Gesamtverbreitung im oberen fünfstelligen bis niedrigen sechsstelligen Bereich aus. Damit war Tempest 2000 kein Massenhit, wohl aber ein Titel, der innerhalb seines technischen und kommerziellen Rahmens außergewöhnlich sichtbar blieb.

Die Wirkung des Spiels zeigte sich auch jenseits der reinen Verkaufszahlen. Der Soundtrack, der die visuelle Dynamik des Spiels maßgeblich prägte, erfreute sich einer solchen Beliebtheit, dass Atari ihn zeitweise sogar separat auf CD vertrieb – ein ungewöhnlicher Schritt für ein Konsolenspiel dieser Zeit und ein Hinweis darauf, wie stark Musik, Grafik und Spielgefühl hier als Einheit wahrgenommen wurden.

Tempest 2000 markierte damit einen Höhepunkt in Minters Laufbahn: nicht als größter kommerzieller Triumph, sondern als Moment, in dem seine Handschrift erstmals ein internationales Publikum erreichte und auch außerhalb der Heimcomputerszene deutlich sichtbar wurde.

Kapitel 4: Epilog

Nach dem Erfolg von Tempest 2000 hätte Jeff Minter sich problemlos dauerhaft in größere Studios integrieren können. Stattdessen blieb er seiner Arbeitsweise treu und arbeitete weiterhin in kleinen, flexiblen Strukturen. Kooperationen mit Plattformfirmen gab es zwar, doch sie blieben punktuell. Für die Multimedia-Technologie Nuon von VM Labs, die DVD-Player mit Spielhardware verbinden sollte, entwickelte er unter anderem Tempest 3000. Die Plattform setzte sich jedoch nicht durch, weshalb diese Projekte nur ein begrenztes Publikum erreichten.

Auch Anfang der 2000er-Jahre suchte Minter eher technische Spielräume als Marktstrategien. Für Lionhead Studios arbeitete er an dem GameCube-Projekt Unity, das Licht-Synthese und Arcade-Gameplay verbinden sollte – zwei Themen, die ihn seit den frühen achtziger Jahren beschäftigten. Das Projekt wurde 2004 eingestellt, doch seine Visualisierungstechnologien fanden später Verwendung bei Microsoft, wo sie in den Musik-Visualizer der Xbox 360 einflossen. Damit erreichten Ideen, die ursprünglich aus Heimcomputer-Experimenten entstanden waren, ein Massenpublikum auf moderner Hardware.

Parallel dazu blieb Llamasoft aktiv. In den folgenden Jahren erschienen weiterhin neue Spiele, darunter Space Giraffe, TxK, Polybius und Moose Life. Inhaltlich knüpften sie deutlich an Minters frühere Arbeiten an: abstrakte Formen, intensive Farben, rhythmische Spielmechaniken und der Versuch, Spieler weniger durch Geschichten als durch Wahrnehmung zu fesseln. Selbst Projekte für mobile Plattformen, etwa die Reihe des sogenannten Minotaur Project, folgten diesem Ansatz – auch wenn Minter sich später wieder davon distanzierte, weil sich das Veröffentlichungsumfeld dort stark verändert hatte.

Heute lebt Minter in Wales und arbeitet weiterhin mit seinem Partner Ivan „Giles“ Zorzin zusammen. Tiere gehören dort ebenso zum Alltag wie Computer – Schafe, Ziegen und Lamas existieren bei ihm nicht nur als digitale Figuren.

Während viele Softwarefirmen der achtziger und neunziger Jahre aufgekauft wurden, fusionierten oder verschwanden – oft trotz deutlich größerer Budgets und internationaler Strukturen –, blieb Llamasoft bestehen. Nicht als wachsender Industriebetrieb, sondern als unabhängiges Studio mit klarer Handschrift.

Gerade dadurch konnte Llamasoft über inzwischen 44 Jahre hinweg existieren – getragen im Wesentlichen von derselben Person, denselben Ideen und demselben Blick auf Videospiele.

Vielleicht liegt genau darin Minters eigentliche Besonderheit: nicht darin, Trends gesetzt oder ihnen gefolgt zu sein, sondern darin, über Jahrzehnte hinweg konsequent seinem eigenen Kurs treu geblieben zu sein.

Mitte der 1980er-Jahre befand sich der japanische Heimcomputermarkt in einer besonders lebhaften Phase. Während in Europa Systeme wie Commodore 64, ZX Spectrum oder Amstrad CPC die Wohnzimmer prägten und sich in den USA zunehmend IBM-kompatible PCs durchsetzten, entwickelte sich in Japan eine eigenständige Computerlandschaft mit mehreren konkurrierenden Plattformen. In den Elektronikgeschäften von Tokio oder Osaka standen unterschiedliche Systeme nebeneinander: NEC bot seine populäre PC-8801-Serie an, Sharp vermarktete die X1-Reihe, und zahlreiche Hersteller unterstützten den MSX-Standard. In diesem Umfeld positionierte Fujitsu seine FM-Computer als leistungsfähige Heimrechner mit erweiterten Grafik- und Klangfähigkeiten.

Mitte der 1980er-Jahre befand sich der japanische Heimcomputermarkt in einer besonders lebhaften Phase. Während in Europa Systeme wie Commodore 64, ZX Spectrum oder Amstrad CPC die Wohnzimmer prägten und sich in den USA zunehmend IBM-kompatible PCs durchsetzten, entwickelte sich in Japan eine eigenständige Computerlandschaft mit mehreren konkurrierenden Plattformen. In den Elektronikgeschäften von Tokio oder Osaka standen unterschiedliche Systeme nebeneinander: NEC bot seine populäre PC-8801-Serie an, Sharp vermarktete die X1-Reihe, und zahlreiche Hersteller unterstützten den MSX-Standard. In diesem Umfeld positionierte Fujitsu seine FM-Computer als leistungsfähige Heimrechner mit erweiterten Grafik- und Klangfähigkeiten.

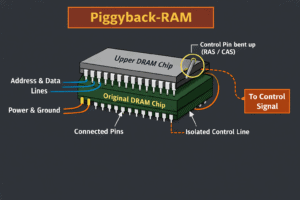

In den frühen 1980er-Jahren stieg der Bedarf an Arbeitsspeicher deutlich schneller, als es die Entwickler vieler Heim- und Mikrocomputer vorgesehen hatten. Die Hürden für Upgrades waren hoch: RAM-Bausteine waren kostspielig, passende Erweiterungskarten oft nicht lieferbar oder im Gehäuse schlicht nicht vorgesehen. In dieser Situation etablierte sich unter Bastlern und Servicetechnikern eine pragmatische Lösung, die als Piggybacking bekannt wurde: Ein zusätzlicher Speicherchip wurde direkt auf einen vorhandenen Baustein gelötet – gewissermaßen „Huckepack“.

In den frühen 1980er-Jahren stieg der Bedarf an Arbeitsspeicher deutlich schneller, als es die Entwickler vieler Heim- und Mikrocomputer vorgesehen hatten. Die Hürden für Upgrades waren hoch: RAM-Bausteine waren kostspielig, passende Erweiterungskarten oft nicht lieferbar oder im Gehäuse schlicht nicht vorgesehen. In dieser Situation etablierte sich unter Bastlern und Servicetechnikern eine pragmatische Lösung, die als Piggybacking bekannt wurde: Ein zusätzlicher Speicherchip wurde direkt auf einen vorhandenen Baustein gelötet – gewissermaßen „Huckepack“.

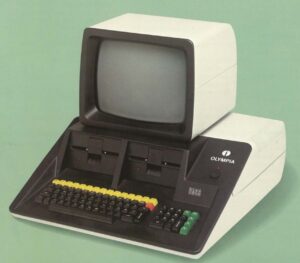

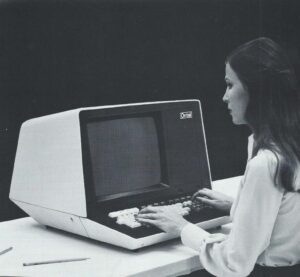

Ende der siebziger Jahre begann sich die Computerwelt spürbar zu verschieben. In Hobbykellern surrten Apple- und PET-Rechner, während in Büros noch Terminals vor Großrechnern klapperten. Der Ontel OP-1 gehörte eindeutig nicht zur ersten Kategorie. In privaten Bastelräumen war er selten anzutreffen – schon Gewicht und vor allem der Preis sprachen deutlich gegen einen Platz zwischen Lötstation und Datasette. Stattdessen war er für Schreibkräfte, Systembetreuer und Verwaltungsbüros gedacht, für Orte also, an denen ein Bildschirm nicht Spielzeug, sondern Werkzeug war. Genau in dieser Übergangsphase erschien der OP-1 als Versuch, Rechenleistung näher an den Arbeitsplatz zu bringen, ohne gleich den Großrechner abzuschaffen.

Ende der siebziger Jahre begann sich die Computerwelt spürbar zu verschieben. In Hobbykellern surrten Apple- und PET-Rechner, während in Büros noch Terminals vor Großrechnern klapperten. Der Ontel OP-1 gehörte eindeutig nicht zur ersten Kategorie. In privaten Bastelräumen war er selten anzutreffen – schon Gewicht und vor allem der Preis sprachen deutlich gegen einen Platz zwischen Lötstation und Datasette. Stattdessen war er für Schreibkräfte, Systembetreuer und Verwaltungsbüros gedacht, für Orte also, an denen ein Bildschirm nicht Spielzeug, sondern Werkzeug war. Genau in dieser Übergangsphase erschien der OP-1 als Versuch, Rechenleistung näher an den Arbeitsplatz zu bringen, ohne gleich den Großrechner abzuschaffen.

Mit der Gründung von Llamasoft begann für Minter eine Phase, in der seine Experimente erstmals eine breitere Öffentlichkeit erreichten. Sein erstes unter diesem Namen veröffentlichtes Spiel war Andes Attack – in den USA als Aggressor vertrieben – eine lose an Defender angelehnte Produktion für den VIC-20. Schon hier zeigte sich ein Element, das später zu seinem Markenzeichen wurde: Statt Raumschiffen bevölkerten kleine Lamas den Bildschirm. Was zunächst wie ein humorvoller Einfall wirkte, entwickelte sich in den folgenden Jahren zu einem wiederkehrenden Motiv seiner Arbeit.

Mit der Gründung von Llamasoft begann für Minter eine Phase, in der seine Experimente erstmals eine breitere Öffentlichkeit erreichten. Sein erstes unter diesem Namen veröffentlichtes Spiel war Andes Attack – in den USA als Aggressor vertrieben – eine lose an Defender angelehnte Produktion für den VIC-20. Schon hier zeigte sich ein Element, das später zu seinem Markenzeichen wurde: Statt Raumschiffen bevölkerten kleine Lamas den Bildschirm. Was zunächst wie ein humorvoller Einfall wirkte, entwickelte sich in den folgenden Jahren zu einem wiederkehrenden Motiv seiner Arbeit. Wie bei Centipede steuert der Spieler ein Fahrzeug am unteren Bildschirmrand und schießt nach oben auf Gegner, die sich in schlangenartigen Formationen über das Spielfeld bewegen. In Gridrunner wandern diese sogenannten „Droids“ über ein festes Raster nach unten und müssen eliminiert werden, bevor sie den unteren Bildschirmrand erreichen. Zusätzlich treten seitliche Gefahren wie die sogenannten „XY-Zapper“ auf, die das Bewegungsfeld einschränken und den Druck auf den Spieler erhöhen.

Wie bei Centipede steuert der Spieler ein Fahrzeug am unteren Bildschirmrand und schießt nach oben auf Gegner, die sich in schlangenartigen Formationen über das Spielfeld bewegen. In Gridrunner wandern diese sogenannten „Droids“ über ein festes Raster nach unten und müssen eliminiert werden, bevor sie den unteren Bildschirmrand erreichen. Zusätzlich treten seitliche Gefahren wie die sogenannten „XY-Zapper“ auf, die das Bewegungsfeld einschränken und den Druck auf den Spieler erhöhen. Mit dem Wechsel auf leistungsfähigere Heimcomputer wie den

Mit dem Wechsel auf leistungsfähigere Heimcomputer wie den

Diese Entwicklung kulminierte Anfang der neunziger Jahre in einem Projekt, das Minters Bekanntheit weit über die Heimcomputerwelt hinaus tragen sollte. Mit Tempest 2000 erhielt er erstmals die Möglichkeit, ein bekanntes Arcade-Spiel nicht nur umzusetzen, sondern neu zu interpretieren. Der Titel erschien 1994 für den Atari Jaguar, eine Konsole, mit der Atari versuchte, im beginnenden 32-Bit-Zeitalter erneut im Markt Fuß zu fassen. Technisch ambitioniert, aber kommerziell nur begrenzt erfolgreich, bot das System Entwicklern dennoch die Chance, Spiele mit deutlich höherem audiovisuellen Anspruch umzusetzen als es in der klassischen Heimcomputerlandschaft üblich gewesen war.

Diese Entwicklung kulminierte Anfang der neunziger Jahre in einem Projekt, das Minters Bekanntheit weit über die Heimcomputerwelt hinaus tragen sollte. Mit Tempest 2000 erhielt er erstmals die Möglichkeit, ein bekanntes Arcade-Spiel nicht nur umzusetzen, sondern neu zu interpretieren. Der Titel erschien 1994 für den Atari Jaguar, eine Konsole, mit der Atari versuchte, im beginnenden 32-Bit-Zeitalter erneut im Markt Fuß zu fassen. Technisch ambitioniert, aber kommerziell nur begrenzt erfolgreich, bot das System Entwicklern dennoch die Chance, Spiele mit deutlich höherem audiovisuellen Anspruch umzusetzen als es in der klassischen Heimcomputerlandschaft üblich gewesen war.