1987 war die Welt der Supersportwagen für die meisten Jugendlichen ein ferner Traum aus Hochglanzprospekten, Autoquartettkarten und gelegentlichen Fernsehberichten über Reiche, die Dinge fuhren, deren Namen allein schon exotisch klangen. Ein Ferrari Testarossa, ein Lamborghini Countach oder ein Porsche 911 Turbo waren keine Fahrzeuge, die man im Alltag sah – sie waren Statussymbole einer anderen Welt, technische Fabelwesen auf Rädern, deren Leistungsdaten man auswendig lernte, obwohl man sie vermutlich nie aus der Nähe erleben würde. Auf Schulhöfen wurden Quartettkarten verglichen, diskutiert und verteidigt wie mittelalterliche Wappen; 309 km/h schlugen 290 km/h, zwölf Zylinder galten automatisch als besser als acht, und wer einen Countach in der Hand hielt, hatte ohnehin gewonnen.

1987 war die Welt der Supersportwagen für die meisten Jugendlichen ein ferner Traum aus Hochglanzprospekten, Autoquartettkarten und gelegentlichen Fernsehberichten über Reiche, die Dinge fuhren, deren Namen allein schon exotisch klangen. Ein Ferrari Testarossa, ein Lamborghini Countach oder ein Porsche 911 Turbo waren keine Fahrzeuge, die man im Alltag sah – sie waren Statussymbole einer anderen Welt, technische Fabelwesen auf Rädern, deren Leistungsdaten man auswendig lernte, obwohl man sie vermutlich nie aus der Nähe erleben würde. Auf Schulhöfen wurden Quartettkarten verglichen, diskutiert und verteidigt wie mittelalterliche Wappen; 309 km/h schlugen 290 km/h, zwölf Zylinder galten automatisch als besser als acht, und wer einen Countach in der Hand hielt, hatte ohnehin gewonnen.

Genau in dieses Spannungsfeld platzierte Test Drive seine Prämisse. Während andere Rennspiele den Spieler in generische Fantasiewagen oder auf abstrakte Rundkurse setzten, versprach Accolades Titel etwas deutlich Reizvolleres: Nicht bloß ein Rennen, sondern die Illusion, tatsächlich hinter dem Steuer jener automobilen Traumwagen zu sitzen, die man bislang nur aus Zeitschriften und Quartettkästen kannte. Plötzlich blickte man nicht mehr von außen auf einen Sprite, sondern durch ein Cockpit auf kurvige Bergstraßen, drehte den virtuellen Zündschlüssel und hörte einen digitalen Motor aufheulen, der wenigstens ein kleines bisschen nach Reichtum klang.

Als das Spiel 1987 für C64, den Apple II, MS-DOS, Atari ST und Amiga erschien, traf es damit einen Nerv. Denn Test Drive war nicht einfach nur ein weiteres Rennspiel – es war für viele Spieler die erste digitale Probefahrt in einer Welt, die bis dahin ausschließlich aus Fantasie bestanden hatte.

Entwickelt wurde Test Drive vom kanadischen Studio Distinctive Software, das Mitte der 1980er-Jahre zu den wichtigsten externen Partnern des US-Publishers Accolade zählte. Das von Donald A. Mattrick mitgegründete Studio hatte sich zunächst mit Portierungen und kleineren Auftragsarbeiten einen Namen gemacht, erhielt von Accolade jedoch zunehmend Freiheiten für eigene Projekte. Test Drive wurde zu jenem Titel, der Distinctive endgültig als kreativen Prestige-Entwickler etablierte und den Grundstein für weitere Rennspielproduktionen wie Grand Prix Circuit und Test Drive II legte.

Anstatt sich am üblichen Arcade-Muster zu orientieren und den Spieler über geschlossene Rundkurse zu schicken, verfolgte Distinctive einen deutlich atmosphärischeren Ansatz: Test Drive sollte das Gefühl vermitteln, einen exotischen Sportwagen tatsächlich im öffentlichen Straßenverkehr zu bewegen – schnell, riskant und mit dem latent schlechten Gewissen, dass die nächste Radarfalle bereits hinter der nächsten Kurve lauern könnte. Die Idee verschob den Fokus weg vom sportlichen Wettbewerb und hin zur Inszenierung des Fahrgefühls selbst.

Dass hinter dieser Herangehensweise echte Automobilbegeisterung stand, erscheint naheliegend. Donald Mattrick galt bereits in jungen Jahren als ausgesprochener Sportwagen-Enthusiast, und die Liebe zum Detail, mit der Test Drive seine Fahrzeuge inszenierte, spricht Bände. Jeder Wagen erhielt ein eigenes Cockpit mit individuell angeordneten Instrumenten, spezifischer Leistungsentfaltung und eigener Charakteristik. Die im Spiel dargestellten Beschleunigungs- und Höchstgeschwindigkeitswerte orientierten sich sichtbar an realen Vorbildern und verliehen jedem Fahrzeug ein eigenes Fahrprofil – soweit dies die damalige Hardware überhaupt zuließ.

Schon das Handbuch unterstrich diese Ausrichtung und inszenierte das Szenario als automobile Wunschfantasie: Der Spieler habe soeben seine erste Million verdient, betrete ein Luxus-Autohaus und dürfe nun endlich einen der „exotischsten Sportwagen der Welt“ Probefahren. Bereits die Fahrzeugwahl wurde somit als Erfüllung eines automobilen Lebenstraums dargestellt – ganz im Ton eines Spiels, das weniger Rennsimulation als interaktive Fantasie sein wollte.

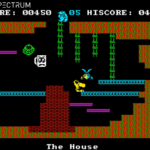

Die anschließende Probefahrt führte über eine kurvige Bergstraße namens „The Rock“, auf der nicht nur Gegenverkehr und tückische Fahrbahnverhältnisse warteten, sondern auch Radarfallen und Highway Patrol. Wer Warnungen ignorierte oder einen Polizeiwagen rammte, wurde nicht bloß disqualifiziert, sondern – ganz im augenzwinkernden Ton des Spiels – direkt „ins Gefängnis geschickt“. Diese ungewöhnliche Mischung aus Fahrspiel, Lifestyle-Fantasie und leichter Gesetzesübertretung verlieh Test Drive bereits 1987 einen rebellischeren Charakter als den meisten Konkurrenten.

Spielerisch war Test Drive dabei weit mehr als bloß ein hübsch verpackter Grafikblender. Hinter der glamourösen Präsentation verbarg sich für 1987 ein erstaunlich anspruchsvolles Fahrspiel, das seine Fahrzeuge nicht nur optisch, sondern auch spielmechanisch differenzieren wollte. Jeder der fünf Wagen verfügte über eigene Beschleunigungswerte, unterschiedliche Endgeschwindigkeiten und ein individuelles Fahrverhalten, das zumindest innerhalb der technischen Grenzen der Zeit nachvollziehbar variierte. Der schwere Chevrolet Corvette wirkte träger und weniger agil, während Lamborghini Countach und Ferrari Testarossa aggressiver beschleunigten und nervöser reagierten – Unterschiede, die bereits zeitgenössische Tester hervorhoben.

Ungewöhnlich für das Genre war zudem der semi-simulative Ansatz bei der Fahrzeugbedienung. Test Drive verlangte vom Spieler manuelles Schalten, wobei falsches Hochschalten oder dauerhaftes Überdrehen des Motors mit Leistungsverlust oder Defekt quittiert werden konnte. Schlaglöcher, Ölflecken und Wasser auf der Fahrbahn beeinflussten zusätzlich das Fahrverhalten, während Gegenverkehr und enge Kurven präzise Lenkarbeit erforderten. Geschwindigkeit allein genügte dabei nicht: Ein auf der Sonnenblende montierter Radarwarner meldete Polizeikontrollen, und wer dauerhaft Vollgas gab, riskierte eine Verfolgung durch die Highway Patrol. Diese zusätzliche Spannungsebene hob das Spiel deutlich von Rundkurs-Racern wie Pole Position oder Arcade-Rasern wie Out Run ab.

Technisch beeindruckte insbesondere die Cockpitdarstellung. Statt den Wagen von außen zu zeigen, platzierte Test Drive den Spieler konsequent hinter das Lenkrad und spendierte jedem Fahrzeug ein eigenes, individuell gestaltetes Dashboard. Tachometer, Drehzahlmesser und Instrumente unterschieden sich sichtbar von Modell zu Modell und orientierten sich an realen Vorbildern – ein Detailgrad, der 1987 alles andere als selbstverständlich war. Zusammen mit den vorgelagerten Fahrzeugprofilen samt technischen Datenblättern wirkte das Spiel dadurch fast wie ein interaktiver digitaler Autokatalog für Spieler, die sich an solchen Informationen kaum sattsehen konnten.

Trotz aller technischen Ambitionen blieb der Umfang allerdings überschaubar. Gefahren wurde ausschließlich auf einer einzigen Strecke, deren fünf Abschnitte sich zwar durch steigende Schwierigkeit unterschieden, visuell jedoch kaum variierten.

Die zeitgenössische Presse reagierte entsprechend fasziniert, wenn auch nicht uneingeschränkt euphorisch. Nahezu alle Magazine waren sich einig, dass Test Drive 1987 etwas bot, das man in dieser Form kaum zuvor gesehen hatte: die glaubhafte Inszenierung einer automobilen Wunschfantasie. Besonders gelobt wurden die Cockpitperspektive, die detaillierten Fahrzeugdarstellungen und das allgemeine Fahrgefühl. Das britische Magazin ACE sprach von „sheer driveability“ und empfahl, sich schlicht „in das Leder sinken zu lassen“ und die Fahrbarkeit des Spiels zu genießen – ein Satz, der hervorragend illustriert, wie sehr Test Drive als luxuriöses Fahrerlebnis und nicht bloß als Rennspiel wahrgenommen wurde.

Auch internationale Magazine zeigten sich beeindruckt. Computer Gaming World lobte die „outstanding graphics“ und bescheinigte dem Titel das Potenzial, jeden Pole-Position-Fan zu begeistern, während Dragon Magazine stolze viereinhalb von fünf Sternen vergab. In Frankreich erreichte das Spiel bei Génération 4 sogar eine Wertung von 91 Prozent – ein ausgesprochen starker Wert für ein Rennspiel jener Zeit.

Gleichzeitig benannten viele Tester jedoch auch die Grenzen des Konzepts. The Games Machine kritisierte die geringe Langzeitmotivation und monierte, dass schlicht „nicht genug zu tun“ sei, sobald der erste technische Wow-Effekt verflogen war. Noch schärfer fiel die Analyse des britischen Motorjournalisten David Vivian in Amiga Computing aus, der das Spiel in einem ungewöhnlich ausführlichen Vergleich mit realen Supersportwagen prüfte. Zwar lobte er die sorgfältige Recherche und attestierte dem Spiel eine glaubhafte automobile Atmosphäre, urteilte letztlich jedoch: „A great idea, well researched. But lacks programming sparkle and substance.“

Gerade diese Kritik erwies sich rückblickend als bemerkenswert treffend. Denn so visionär Test Drive als Konzept war, so überschaubar blieb sein tatsächlicher Umfang. Die einzige Bergstrecke, die geringe Zahl spielerischer Variationen und das Fehlen weiterer Modi oder Gegner sorgten dafür, dass der Titel für viele Spieler eher eine intensive Kurzzeitfaszination als ein langfristiger Dauerbrenner war.

Dem kommerziellen Erfolg schadete dies allerdings kaum. Test Drive überschritt zunächst die Marke von 100.000 verkauften Exemplaren und erhielt dafür den Gold Award der American Software Publishers Association; spätere Branchenberichte sprachen bis Ende 1989 von mindestens 250.000 bis über 400.000 verkauften Einheiten. Damit avancierte das Spiel zu einem der erfolgreichsten Computer-Racer seiner Ära und etablierte sich endgültig als Accolades neue Prestige-Marke.

Auch preislich positionierte sich Test Drive klar als Premiumprodukt seiner Zeit. In den USA lag der Einführungspreis je nach Plattform meist bei rund 39,95 bis 49,95 US-Dollar, während die Heimcomputerfassungen im deutschsprachigen Raum häufig zwischen 79 und 99 DM gehandelt wurden – ein Betrag, der inflationsbereinigt heute grob einer Größenordnung von etwa 70 bis 100 Euro entspricht. Damit bewegte sich der Titel im oberen Segment des damaligen Softwaremarktes und unterstrich bereits über seinen Preis den Anspruch, kein gewöhnliches Budget-Rennspiel, sondern ein Prestigeprodukt für technikbegeisterte Autofans zu sein.

Auf dem Markt traf Test Drive dabei auf durchaus namhafte Konkurrenz, unterschied sich von dieser jedoch erheblich in seiner Ausrichtung. Segas Out Run dominierte 1986/87 weiterhin die Arcade-Hallen und setzte auf spektakuläre Geschwindigkeit, farbenfrohe Grafik und unmittelbaren Spielspaß, blieb spielerisch jedoch klar im Arcade-Lager. Titel wie Pole Position II oder diverse Formel-1-Umsetzungen wiederum orientierten sich stärker am klassischen Motorsportgedanken und boten Rundkurse statt Straßenverkehr. Test Drive besetzte damit eine Nische, die zu diesem Zeitpunkt kaum ein anderer Titel bediente: Es verkaufte keine Rennserie, keine Meisterschaft und kein Arcade-Spektakel, sondern den Traum einer illegal schnellen Spritztour im eigenen Supersportwagen.

Gerade diese Positionierung erwies sich als entscheidender Erfolgsfaktor. Wo andere Rennspiele den Wettbewerb in den Mittelpunkt stellten, verkaufte Test Drive ein Lebensgefühl – und traf damit exakt den Nerv einer Zielgruppe, die sich zwar keinen Ferrari leisten konnte, wohl aber einen Heimcomputer.

Rückblickend definierte Test Drive mehrere Grundelemente, die später zum Standard moderner Straßenrennspiele werden sollten: exotische Serienfahrzeuge, Cockpitperspektive, offene Straßen statt Rundkurse, Polizeidruck und eine stärker emotionale als motorsportliche Inszenierung. Als Distinctive Software 1991 von Electronic Arts übernommen wurde und Jahre später an The Need for Speed arbeitete, fanden sich viele dieser Ideen in technisch und spielerisch weiterentwickelter Form erneut wieder.

Auch innerhalb seiner eigenen Reihe legte der Titel den Grundstein für eines der langlebigsten Rennspiel-Franchises der Branche. Bereits 1989 folgte mit Test Drive II: The Duel ein deutlich ausgebauter Nachfolger, der das Grundkonzept um Gegnerfahrzeuge, mehrere Strecken und spätere Datadisks erweiterte. Über zahlreiche Iterationen hinweg sollte sich die Marke bis weit in die 2000er und darüber hinaus halten – ein bemerkenswerter Nachhall für ein Spiel, das ursprünglich lediglich die digitale Fantasie einer Spritztour im Supersportwagen erfüllen wollte.

So bleibt Test Drive heute vor allem als Meilenstein einer Übergangsphase in Erinnerung: als Titel, der Rennspiele aus der reinen Arcade-Ecke herausführte, ohne bereits echte Simulation zu sein; als Spiel, das mehr Atmosphäre als Umfang bot, aber damit einen Nerv traf; und als digitales Versprechen an eine Generation von Spielern, die Ferrari, Lamborghini und Porsche bis dahin meist nur aus Autoquartettkarten, Kinderzimmerpostern und den Träumen ihrer Jugend kannten.

1987 war die Welt der Supersportwagen für die meisten Jugendlichen ein ferner Traum aus Hochglanzprospekten, Autoquartettkarten und gelegentlichen Fernsehberichten über Reiche, die Dinge fuhren, deren Namen allein schon exotisch klangen. Ein Ferrari Testarossa, ein Lamborghini Countach oder ein Porsche 911 Turbo waren keine Fahrzeuge, die man im Alltag sah – sie waren Statussymbole einer anderen Welt, technische Fabelwesen auf Rädern, deren Leistungsdaten man auswendig lernte, obwohl man sie vermutlich nie aus der Nähe erleben würde. Auf Schulhöfen wurden Quartettkarten verglichen, diskutiert und verteidigt wie mittelalterliche Wappen; 309 km/h schlugen 290 km/h, zwölf Zylinder galten automatisch als besser als acht, und wer einen Countach in der Hand hielt, hatte ohnehin gewonnen.

1987 war die Welt der Supersportwagen für die meisten Jugendlichen ein ferner Traum aus Hochglanzprospekten, Autoquartettkarten und gelegentlichen Fernsehberichten über Reiche, die Dinge fuhren, deren Namen allein schon exotisch klangen. Ein Ferrari Testarossa, ein Lamborghini Countach oder ein Porsche 911 Turbo waren keine Fahrzeuge, die man im Alltag sah – sie waren Statussymbole einer anderen Welt, technische Fabelwesen auf Rädern, deren Leistungsdaten man auswendig lernte, obwohl man sie vermutlich nie aus der Nähe erleben würde. Auf Schulhöfen wurden Quartettkarten verglichen, diskutiert und verteidigt wie mittelalterliche Wappen; 309 km/h schlugen 290 km/h, zwölf Zylinder galten automatisch als besser als acht, und wer einen Countach in der Hand hielt, hatte ohnehin gewonnen.

Es gab eine Zeit, in der britische Heimcomputer-Spieler glaubten, die besten Spiele kämen zwangsläufig aus Sheffield, Liverpool oder London. Studios wie

Es gab eine Zeit, in der britische Heimcomputer-Spieler glaubten, die besten Spiele kämen zwangsläufig aus Sheffield, Liverpool oder London. Studios wie

Es war das Jahr 1985, als Großbritanniens Heimcomputerlandschaft endgültig ihre erste Reifephase erreichte. Die wilden Frühjahre der simplen Arcade-Klone und hastig zusammengeschusterten Kassettenprogramme lagen zwar erst kurze Zeit zurück, doch die Ansprüche des Publikums waren inzwischen deutlich gestiegen. Spieler wollten mehr als ein paar springende Pixel auf monochromem Hintergrund – sie verlangten Charaktere, Wiedererkennungswert, technische Raffinesse und Spiele, die sich wie echte Ereignisse anfühlten. Genau in diese Phase platzte Monty on the Run, der dritte große Auftritt des mittlerweile etablierten Maulwurfs Monty Mole, und erhob eine bereits erfolgreiche britische Plattformserie endgültig in den Rang eines Heimcomputer-Klassikers.

Es war das Jahr 1985, als Großbritanniens Heimcomputerlandschaft endgültig ihre erste Reifephase erreichte. Die wilden Frühjahre der simplen Arcade-Klone und hastig zusammengeschusterten Kassettenprogramme lagen zwar erst kurze Zeit zurück, doch die Ansprüche des Publikums waren inzwischen deutlich gestiegen. Spieler wollten mehr als ein paar springende Pixel auf monochromem Hintergrund – sie verlangten Charaktere, Wiedererkennungswert, technische Raffinesse und Spiele, die sich wie echte Ereignisse anfühlten. Genau in diese Phase platzte Monty on the Run, der dritte große Auftritt des mittlerweile etablierten Maulwurfs Monty Mole, und erhob eine bereits erfolgreiche britische Plattformserie endgültig in den Rang eines Heimcomputer-Klassikers.

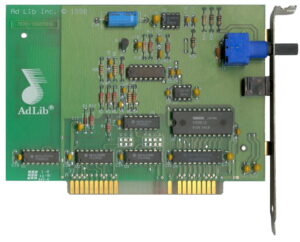

Als die AdLib Music Synthesizer Card 1987 erschien, war der IBM-PC zwar längst als Arbeitsrechner etabliert, klanglich jedoch noch immer ein technisches Hinterland. Während Besitzer eines

Als die AdLib Music Synthesizer Card 1987 erschien, war der IBM-PC zwar längst als Arbeitsrechner etabliert, klanglich jedoch noch immer ein technisches Hinterland. Während Besitzer eines

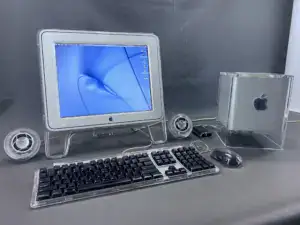

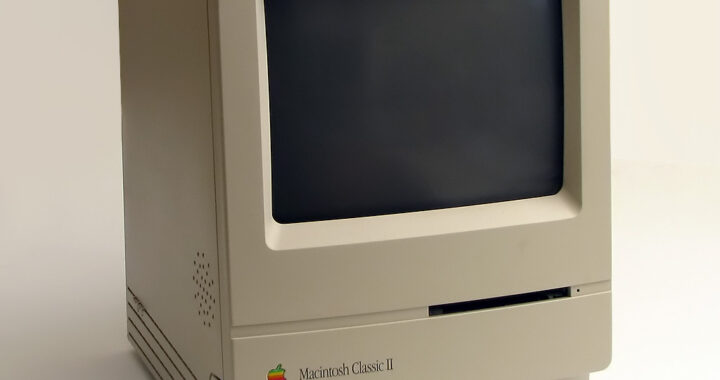

Es ist das Jahr 1987, und die Erwartungen an Heimcomputer haben sich spürbar verschoben. Systeme wie der Atari ST und der

Es ist das Jahr 1987, und die Erwartungen an Heimcomputer haben sich spürbar verschoben. Systeme wie der Atari ST und der

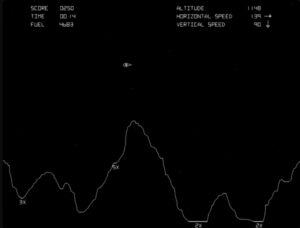

Es war eine Zeit, in der der Blick zum Mond nicht nur von Fernsehkameras geprägt war, sondern von Rechenzentren, Terminals und der stillen Faszination für Zahlen. Als die Apollo-Missionen Ende der 1960er Jahre ihren Höhepunkt erreichten, begann sich parallel ein Gedanke in Universitäten und Forschungseinrichtungen zu verfestigen: Wenn sich eine Mondlandung berechnen lässt, lässt sie sich auch simulieren. Aus dieser Überlegung entstand eines der frühesten Beispiele interaktiver Software, das später unter dem Namen „Lunar Lander“ bekannt wurde – weniger als einzelnes Spiel, sondern als eine fortlaufende Reihe von Programmen, die sich über ein Jahrzehnt hinweg entwickelten.

Es war eine Zeit, in der der Blick zum Mond nicht nur von Fernsehkameras geprägt war, sondern von Rechenzentren, Terminals und der stillen Faszination für Zahlen. Als die Apollo-Missionen Ende der 1960er Jahre ihren Höhepunkt erreichten, begann sich parallel ein Gedanke in Universitäten und Forschungseinrichtungen zu verfestigen: Wenn sich eine Mondlandung berechnen lässt, lässt sie sich auch simulieren. Aus dieser Überlegung entstand eines der frühesten Beispiele interaktiver Software, das später unter dem Namen „Lunar Lander“ bekannt wurde – weniger als einzelnes Spiel, sondern als eine fortlaufende Reihe von Programmen, die sich über ein Jahrzehnt hinweg entwickelten. Als NEC Anfang der 1980er Jahre mit dem

Als NEC Anfang der 1980er Jahre mit dem