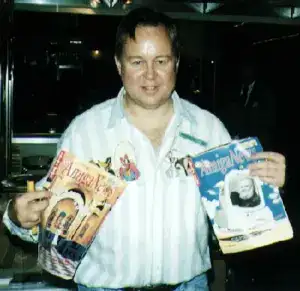

Ein Fisch im Aquarium erfüllt einen klaren Zweck. Er bringt Leben hinein, sorgt für Bewegung, manchmal auch für ein gewisses Gleichgewicht. Ohne ihn wirkt alles schnell leer, fast schon steril. Beim Amiga war es nicht viel anders – auch hier gab es jemanden, der die Szene nicht nur mit Inhalten versorgte, sondern sie überhaupt erst in Bewegung hielt: Fred Fish.

Ein Fisch im Aquarium erfüllt einen klaren Zweck. Er bringt Leben hinein, sorgt für Bewegung, manchmal auch für ein gewisses Gleichgewicht. Ohne ihn wirkt alles schnell leer, fast schon steril. Beim Amiga war es nicht viel anders – auch hier gab es jemanden, der die Szene nicht nur mit Inhalten versorgte, sondern sie überhaupt erst in Bewegung hielt: Fred Fish.

Während sich in den 1980er-Jahren ein erheblicher Teil der Diskussionen um Kopierschutz, Raubkopien und technische Gegenmaßnahmen drehte, verfolgte Fish längst einen anderen Ansatz. Für ihn stand nicht die Frage im Vordergrund, wie man Software schützt, sondern wie man sie zugänglich macht.

Das Umfeld, in dem er sich bewegte, war dabei alles andere als eindeutig. Software war teuer, oft schwer erhältlich und nicht selten mit Schutzmechanismen versehen, die mehr Frust als Nutzen erzeugten. Gleichzeitig entwickelte sich eine Szene, die genau diese Hürden systematisch aushebelte. In zeitgenössischen Interviews wurde offen darüber gesprochen, dass diejenigen, die Kopierschutz umgingen, häufig technisch versierter waren als jene, die ihn entwickelten.

Fish entzog sich dieser Logik.

Während andere versuchten, Software zu schützen oder Schutzmechanismen zu überwinden, arbeitete er an einem System, das diese Frage schlicht überflüssig machte. Wenn Programme frei verfügbar sind, verliert die Diskussion um illegale Kopien ihren Kern.

Gleichzeitig wurde in späteren Rückblicken immer wieder betont, wie ungewöhnlich dieser Ansatz in seiner Zeit war:

„Fred Fish made software freely available at a time when that was far from common practice.“ („Fred Fish machte Software frei verfügbar zu einer Zeit, in der das alles andere als selbstverständlich war.“)

Was heute als Grundgedanke freier Software erscheint, war Mitte der 1980er-Jahre noch keineswegs etabliert – vielmehr setzte Fish hier bewusst einen Gegenpol zur damals dominierenden Praxis.

Dabei war die Idee selbst keineswegs neu. Public-Domain-Software existierte bereits zuvor in verschiedenen Heimcomputer-Communities – oft lose organisiert, über Usergroups verteilt oder in Form unstrukturierter Diskettensammlungen weitergegeben.

Fred Fish erfand dieses Modell nicht – aber er war einer der ersten, die ihm auf dem Amiga eine klare Form und vor allem eine verlässliche Struktur gaben.

Mit seinen sogenannten „Amiga Library Disks“, die später unter dem Namen „Fish Disks“ bekannt wurden, etablierte er ein System, das weit über eine bloße Sammlung hinausging. Interessanterweise war diese Bezeichnung ursprünglich gar nicht offiziell. Sie entstand vielmehr innerhalb der Community selbst und setzte sich mit der Zeit durch.

Häufig wird berichtet, dass der Begriff bei einem Treffen der Jersey Amiga User Group geprägt wurde, unter anderem im Umfeld von Perry Kivolowitz. Ob dieser Moment tatsächlich der Ursprung war oder sich der Name eher schleichend etablierte, lässt sich heute nicht mehr eindeutig klären – doch genau diese Art von inoffizieller Namensgebung passt zur Entstehungsgeschichte der Diskettenreihe.

Denn sie war nie als Marke gedacht, sondern als etwas, das sich aus der Nutzung heraus entwickelte – getragen von den Menschen, die sie weitergaben.

Verbreitet wurden diese Disketten über ein Netzwerk, das heute fast archaisch wirkt, damals jedoch erstaunlich effizient war. Usergroups spielten dabei eine zentrale Rolle, ebenso spezialisierte Händler und nicht zuletzt der Postversand. Wer Zugang zu einer aktuellen Disk hatte, konnte sie legal kopieren und weitergeben – oft gegen eine geringe Gebühr, die lediglich die Kosten für Rohlinge und Versand deckte. Auf diese Weise entstand ein Kreislauf, der ohne zentrale Kontrolle funktionierte und dennoch eine erstaunliche Reichweite entwickelte.

Was seine Disketten von vielen früheren Sammlungen unterschied, war die Konsequenz, mit der sie zusammengestellt wurden. Jede Ausgabe war nummeriert, dokumentiert und redaktionell betreut. Programme wurden nicht einfach kopiert, sondern ausgewählt, beschrieben und in einen nachvollziehbaren Zusammenhang gebracht.

Damit entstand etwas, das es in dieser Konsequenz zuvor kaum gegeben hatte: eine vertrauenswürdige Quelle frei verfügbarer Software.

Gerade in einer Zeit, in der Diskettenkopien häufig mit fehlerhaften Versionen, unklarer Herkunft oder manipulierten Programmen verbunden waren, schuf Fish damit einen Gegenpol. Was auf seinen Disketten landete, war nicht zufällig – es war geprüft, eingeordnet und bewusst zur Weitergabe gedacht.

Ein Blick in eine seiner frühen Veröffentlichungen aus dem Jahr 1986 zeigt, wie sehr seine Auswahl von Anfang an geprägt war. Statt vor allem Spiele zu verbreiten, listete er Programme wie ein „Unix-like frontend for Lattice C compiler“, Debugging-Werkzeuge oder Varianten des „make“-Systems auf.

Damit setzte er einen Akzent, der nicht dem gängigen Bild des Amiga entsprach. Während das System öffentlich vor allem als Grafik- und Spieleplattform wahrgenommen wurde, zeigte Fish eine andere Seite: den Amiga als Entwicklungsumgebung.

Diese Nähe zur Unix-Welt war kein Zufall, sondern Ausdruck seiner eigenen Arbeitsweise. Konzepte wie Modularität, Wiederverwendbarkeit und offene Strukturen durchzogen sowohl die Inhalte seiner Disketten als auch seine späteren Projekte.

Und genau hier wird deutlich, dass die Fish Disks nur ein Teil seines Wirkens waren.

Fred Fish, geboren am 4. November 1952, blieb zeitlebens eine vergleichsweise zurückhaltende Figur. Während seine Arbeit innerhalb der Amiga-Szene eine enorme Verbreitung fand, trat er selbst nur selten in den Vordergrund. Interviews sind vergleichsweise rar, und wenn er sich äußerte, dann meist zu technischen Themen, weniger zu seiner eigenen Person.

Parallel dazu bewegte sich Fish längst in der professionellen Softwareentwicklung. Im Umfeld des GNU Debugger wurde seine Rolle dabei ungewöhnlich konkret beschrieben: „Fred contributed enormously to GDB, especially in the area of command completion and System V support.“ („Fred hat enorm viel zu GDB beigetragen, insbesondere im Bereich der Befehlsvervollständigung und der System-V-Unterstützung.“) Solche Aussagen stammen nicht aus der Rückschau von außen, sondern aus Entwicklerkreisen selbst – und sie zeigen, dass Fish auch jenseits der Amiga-Welt als prägender Mitwirkender wahrgenommen wurde.

Diese technische Arbeit war dabei kein Widerspruch zu seiner früheren Tätigkeit, sondern vielmehr deren logische Fortsetzung. Seine Haltung blieb über die Jahre konsistent, wie es in Nachrufen treffend formuliert wurde:

„He believed strongly in sharing software and knowledge.“ („Er war zutiefst davon überzeugt, dass Software und Wissen geteilt werden sollten.“)

In den 1990er-Jahren arbeitete Fish zudem für Cygnus Solutions, ein Unternehmen, das sich auf den Support freier Software spezialisiert hatte und damit eine Schlüsselrolle in der frühen Open-Source-Bewegung einnahm. Auch hier zeigt sich die gleiche Linie: Software nicht nur bereitzustellen, sondern sie in funktionierende, stabile Systeme zu überführen.

Später wandte er sich mit BeOS einer Plattform zu, die in vielerlei Hinsicht an die ursprünglichen Ideale des Amiga erinnerte. Mit dem Projekt GeekGadgets entwickelte er eine GNU-basierte Entwicklungsumgebung für Systeme wie AmigaOS und BeOS – eine Brücke zwischen unterschiedlichen Softwarewelten.

Auf dem Amiga spielte dabei insbesondere die ixemul-Bibliothek eine zentrale Rolle, die Unix-Systemaufrufe in die Logik von AmigaOS übersetzte. Auch hier zeigt sich erneut das gleiche Prinzip: vorhandene Systeme nicht zu ersetzen, sondern sie zu erweitern und zugänglich zu machen.

Organisatorisch blieb Fish sich ebenfalls treu. Er betrieb eigene Infrastruktur, stellte regelmäßig aktualisierte Software-Sammlungen bereit und nutzte sogar Abonnementmodelle für CD-Snapshots, um die Verbreitung seiner Arbeit zu sichern. Struktur, Kontinuität und Verlässlichkeit waren dabei keine Nebenprodukte, sondern bewusst gewählte Prinzipien.

Als Fred Fish im April 2007 verstarb, verlor die Szene nicht nur einen Entwickler, sondern eine ihrer prägenden Figuren. Weggefährten erinnerten sich an ihn als jemanden, der Wissen nicht zurückhielt, sondern bewusst weitergab.

Rückblickend wird deutlich, dass die Fish Disks nur der sichtbarste Ausdruck dieser Haltung waren.

Sie stehen für eine Idee, die sich durch sein gesamtes Schaffen zog: Software sollte zugänglich sein, verstanden werden können und die Möglichkeit bieten, darauf aufzubauen.

Und genau darin liegt vielleicht sein eigentlicher Beitrag.

Während andere versuchten, Software zu schützen oder zu kontrollieren, schuf Fred Fish ein System, das auf Offenheit beruhte – und damit die ursprüngliche Frage nach Kopierschutz auf eine Weise beantwortete, die kaum direkter hätte sein können.

Oder, um bei dem Bild vom Anfang zu bleiben:

Ein Aquarium kann technisch noch so ausgefeilt sein – ohne das Leben darin bleibt es leer.

Der Amiga hatte dieses Leben.

Und Fred Fish war einer derjenigen, die dafür sorgten, dass es überhaupt entstehen konnte.

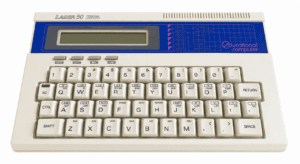

Es ist Mitte der 1980er Jahre, und während Systeme wie der Commodore 64 oder der ZX Spectrum den heimischen Schreibtisch erobern, verfolgt ein Hersteller aus Hongkong einen anderen Ansatz: Computer sollen nicht nur zu Hause stehen, sondern überallhin mitgenommen werden können – und vor allem eines tun: Programmieren lehren. In genau diesem Spannungsfeld entsteht der Video Technology Laser 50, ein Gerät, das sich selbstbewusst als „BASIC learning tool that teaches you BASIC“ bezeichnete.

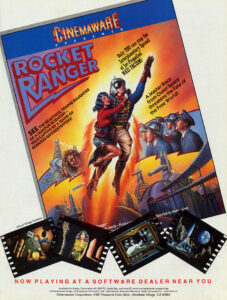

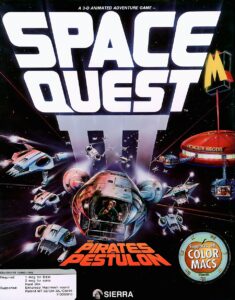

Es ist Mitte der 1980er Jahre, und während Systeme wie der Commodore 64 oder der ZX Spectrum den heimischen Schreibtisch erobern, verfolgt ein Hersteller aus Hongkong einen anderen Ansatz: Computer sollen nicht nur zu Hause stehen, sondern überallhin mitgenommen werden können – und vor allem eines tun: Programmieren lehren. In genau diesem Spannungsfeld entsteht der Video Technology Laser 50, ein Gerät, das sich selbstbewusst als „BASIC learning tool that teaches you BASIC“ bezeichnete. Was wäre, wenn der Zweite Weltkrieg nicht so ausgegangen wäre, wie wir ihn kennen? Wenn nicht Befreiung und Wiederaufbau folgten, sondern eine Welt, in der ein technologisch überlegener Gegner den Verlauf der Geschichte dauerhaft verändert hätte? Solche „What if“-Szenarien sind heute fest im kulturellen Gedächtnis verankert, doch bereits Ende der 1980er Jahre griff ein Studio diese Idee auf, das für seine besondere Verbindung aus Spiel und Inszenierung bekannt war: Cinemaware. Mit Rocket Ranger entstand 1988 ein Titel, der weniger wie ein klassisches Spiel wirkte, sondern eher wie ein interaktiver Abenteuerfilm – mit all seinen Stärken und Eigenheiten.

Was wäre, wenn der Zweite Weltkrieg nicht so ausgegangen wäre, wie wir ihn kennen? Wenn nicht Befreiung und Wiederaufbau folgten, sondern eine Welt, in der ein technologisch überlegener Gegner den Verlauf der Geschichte dauerhaft verändert hätte? Solche „What if“-Szenarien sind heute fest im kulturellen Gedächtnis verankert, doch bereits Ende der 1980er Jahre griff ein Studio diese Idee auf, das für seine besondere Verbindung aus Spiel und Inszenierung bekannt war: Cinemaware. Mit Rocket Ranger entstand 1988 ein Titel, der weniger wie ein klassisches Spiel wirkte, sondern eher wie ein interaktiver Abenteuerfilm – mit all seinen Stärken und Eigenheiten.

Der TRS-80 Model II erschien zu einem Zeitpunkt, als sich der Computermarkt bereits in zwei klar unterscheidbare Richtungen entwickelte. Systeme wie der

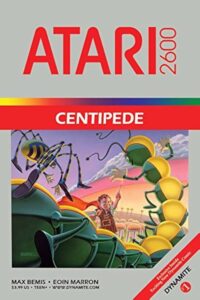

Der TRS-80 Model II erschien zu einem Zeitpunkt, als sich der Computermarkt bereits in zwei klar unterscheidbare Richtungen entwickelte. Systeme wie der  Ein leises Summen liegt in der Luft, irgendwo zwischen Neonlicht und dem metallischen Klang fallender Münzen. Anfang der 1980er Jahre war die Spielhalle kein Ort der Erklärungen, sondern der Erfahrung. Als Dona Bailey zum ersten Mal vor einem Automaten von Space Invaders stand, wusste sie nicht einmal, was ein Videospiel war. „I said what is a video game…“, erinnerte sie sich später, nur um wenige Augenblicke danach eine Entscheidung zu treffen, die rückblickend wie ein Wendepunkt wirkt: „I don’t want to program for GM anymore, I want to program for Atari.“ („Ich will nicht mehr für GM programmieren, ich will für Atari programmieren.“) Was als neugieriger Blick auf flackernde Pixel begann, führte direkt zur Mitarbeit an einem der einflussreichsten Titel der Arcade-Geschichte: Centipede.

Ein leises Summen liegt in der Luft, irgendwo zwischen Neonlicht und dem metallischen Klang fallender Münzen. Anfang der 1980er Jahre war die Spielhalle kein Ort der Erklärungen, sondern der Erfahrung. Als Dona Bailey zum ersten Mal vor einem Automaten von Space Invaders stand, wusste sie nicht einmal, was ein Videospiel war. „I said what is a video game…“, erinnerte sie sich später, nur um wenige Augenblicke danach eine Entscheidung zu treffen, die rückblickend wie ein Wendepunkt wirkt: „I don’t want to program for GM anymore, I want to program for Atari.“ („Ich will nicht mehr für GM programmieren, ich will für Atari programmieren.“) Was als neugieriger Blick auf flackernde Pixel begann, führte direkt zur Mitarbeit an einem der einflussreichsten Titel der Arcade-Geschichte: Centipede. Auch der Arbeitsalltag im Atari-Arcade-Team wirkt aus heutiger Sicht fast fremd. Code wurde handschriftlich verfasst, in einen Korb gelegt, von spezialisierten Mitarbeiterinnen abgetippt, kompiliert und auf ein PROM gebrannt. Erst Stunden später ließ sich das Ergebnis im Entwicklungskabinett testen. „Here’s your cubicle, now make a game“, lautete die nüchterne Einweisung. („Hier ist deine Kabine, jetzt mach ein Spiel.“) Eine Struktur, die kaum Planung erlaubte, dafür aber Experiment begünstigte. „We had no idea what we were doing. We were just doing stuff.“ („Wir hatten keine Ahnung, was wir da taten. Wir haben einfach Dinge gemacht.“)

Auch der Arbeitsalltag im Atari-Arcade-Team wirkt aus heutiger Sicht fast fremd. Code wurde handschriftlich verfasst, in einen Korb gelegt, von spezialisierten Mitarbeiterinnen abgetippt, kompiliert und auf ein PROM gebrannt. Erst Stunden später ließ sich das Ergebnis im Entwicklungskabinett testen. „Here’s your cubicle, now make a game“, lautete die nüchterne Einweisung. („Hier ist deine Kabine, jetzt mach ein Spiel.“) Eine Struktur, die kaum Planung erlaubte, dafür aber Experiment begünstigte. „We had no idea what we were doing. We were just doing stuff.“ („Wir hatten keine Ahnung, was wir da taten. Wir haben einfach Dinge gemacht.“)

Als der Sinclair ZX Spectrum+ im Oktober 1984 erschien, war die eigentliche Sensation längst geschehen. Der ursprüngliche

Als der Sinclair ZX Spectrum+ im Oktober 1984 erschien, war die eigentliche Sensation längst geschehen. Der ursprüngliche

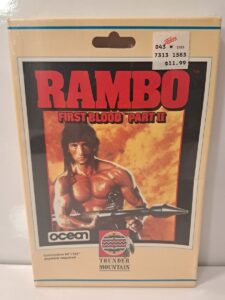

Als Rambo: First Blood Part II 1985 in die Kinos kam, war Sylvester Stallones Vietnam-Veteran längst zu einem globalen Popkultur-Phänomen geworden. Kaum ein anderer Actionheld verkörperte den martialischen Zeitgeist der Reagan-Ära so kompromisslos wie John Rambo, und für Ocean Software war rasch klar, dass eine Heimcomputer-Umsetzung dieser Lizenz nahezu Pflicht war. Das britische Studio hatte sich zu diesem Zeitpunkt bereits als Spezialist für Film- und Markenadaptionen etabliert und brachte mit beeindruckender Regelmäßigkeit Umsetzungen großer Kino- und Arcade-Lizenzen auf den Markt. Mit Rambo sicherte sich Ocean eine der prominentesten Action-Marken der Mitte der achtziger Jahre – und behandelte das Projekt entsprechend nicht als bloße Schnellproduktion, sondern als technisch prestigeträchtigen Vorzeigetitel.

Als Rambo: First Blood Part II 1985 in die Kinos kam, war Sylvester Stallones Vietnam-Veteran längst zu einem globalen Popkultur-Phänomen geworden. Kaum ein anderer Actionheld verkörperte den martialischen Zeitgeist der Reagan-Ära so kompromisslos wie John Rambo, und für Ocean Software war rasch klar, dass eine Heimcomputer-Umsetzung dieser Lizenz nahezu Pflicht war. Das britische Studio hatte sich zu diesem Zeitpunkt bereits als Spezialist für Film- und Markenadaptionen etabliert und brachte mit beeindruckender Regelmäßigkeit Umsetzungen großer Kino- und Arcade-Lizenzen auf den Markt. Mit Rambo sicherte sich Ocean eine der prominentesten Action-Marken der Mitte der achtziger Jahre – und behandelte das Projekt entsprechend nicht als bloße Schnellproduktion, sondern als technisch prestigeträchtigen Vorzeigetitel.