128 Kilobyte Hoffnung – Wie Sinclair mit dem Spectrum 128 sein Erbe retten wollte

Picture by: http://www.retro8bitcomputers.co.uk/Sinclair/ZXSpectrum128

Als der 128-Kilobyte-Spectrum in Barcelona zum ersten Mal unter den Scheinwerfern stand, wirkte es ein wenig so, als würde Sinclair Research noch einmal mit Nachdruck verkünden wollen, dass die Ingenieure in Cambridge nicht bereit waren, die Bühne zu räumen. Spanien war ein seltsamer Ort für dieses Comeback, doch ausgerechnet dort entschied die Finanzpolitik über Sinclairs Zukunft: Eine Steuergrenze, die Computer mit weniger als 64 KB als Luxus behandelte, zwang die Briten dazu, kurzfristig ein Modell mit doppeltem Speicher zu entwickeln. Und so wurde Investrónica, der mächtige Vertriebspartner von Sinclair auf der Iberischen Halbinsel, plötzlich zum Mitgestalter eines der ungewöhnlichsten 8-Bit-Rechner seiner Zeit.

Im Kern schlug nach wie vor der vertraute Takt des Z80A, jenes unverwüstlichen 8-Bit-Prozessors, der seit 1982 eine ganze Generation an Software getragen hatte. Doch jetzt durfte er auf 128 KB zugreifen, und das neu gestaltete ROM brachte nicht nur zusätzliche BASIC-Befehle mit, sondern auch das Gefühl, der Spectrum könne plötzlich Dinge sagen und tun, zu denen er vorher schlicht nicht in der Lage war. Der AY-3-8912-Soundchip verwandelte das Gerät von einem piepsenden Minimalisten in ein kleines elektronisches Orchester. Es war ein Moment, der für viele Benutzer wie ein Befreiungsschlag wirkte – als hätte der Spectrum gelernt, musikalisch zu atmen.

Äußerlich blieb vieles beim Alten, bis man auf die rechte Seite blickte. Dort ragte der Aluminiumkühlkörper hervor, groß, kantig, ein bisschen übertrieben – und doch so ikonisch, dass ihm der Spitzname „Toast Rack“ bis heute anhaftet. Guillermo Capdevila, der für das spanische Design verantwortlich war, respektierte zwar die Linien des Spectrum+, gab dem 128er aber eine Art technisches Seitenprofil, das man nicht übersehen konnte. In Spanien präsentierte Investrónica sogar einen externen Ziffernblock, ein Accessoire, das den Spectrum 128 ein Stück weit in Richtung Bürocomputer rückte.

Doch seine eigentliche Transformation fand unter der Haube statt. Die neue Speicherorganisation, die erweiterten BASIC-Puffer und die Rasterung der Bank-Switching-Logik verliehen dem Rechner eine Flexibilität, die man dem Spectrum früher nie zugetraut hätte. Und mit den neuen Anschlüssen – RGB, RS-232 und der integrierten MIDI-Schnittstelle – betrat Sinclair technisches Terrain, das bis dahin kaum ein Heimcomputer beschritten hatte. Spanische Magazine zeigten einprägsame Bilder: ein Spectrum 128, der über MIDI mit einem Keyboard kommunizierte. Ein 8-Bit-Heimcomputer, der sich mit der Gelassenheit eines Synthesizers verhielt – das blieb haften, gerade bei der jüngeren Generation.

Die Elektronik des 128ers war das Werk von Martin Brennan, John Mathieson und Ben Cheese, drei Ingenieuren, die später Flare Technology gründeten. Ihre Konzepte beeinflussten Jahre danach die Architektur des Atari Jaguar – eine dieser leisen, aber faszinierenden Querverbindungen in der Computergeschichte. Dass dieselben Köpfe zuvor an diesem Spectrum saßen, ist einer jener Momente, in denen die Chronologie der Technik ihren ganz eigenen Rhythmus zeigt.

Der Preis war ehrlich, wenn auch nicht spektakulär: £ 179 in Großbritannien, ein Wert, der den 128er klar als Weiterentwicklung, nicht aber als Neubelebung des Marktes positionierte. In Spanien hingegen wurde er ein Massenphänomen. Über 100 000 Geräte wanderten über die Ladentheken des riesigen Vertriebsnetzes von El Corte Inglés, und Magazine wie MicroHobby berichteten Monat für Monat über neue Spiele, neue Tricks, neue Anwendungen – oft spezifisch für den 128K-Modus.

Natürlich war der neue Spectrum nur bedingt ein Rettungsanker. Sinclair Research hatte sich bereits mit dem QL und dem C5 in eine schwierige Lage gebracht, und der 128er kam vielleicht ein Jahr später, als man es sich hätte wünschen sollen. Doch seine Bedeutung misst sich nicht allein an Geschäftsberichten. Er war der Beweis, dass ein vertrauter 8-Bit-Computer erwachsen werden konnte, ohne seine Herkunft zu verraten. Ein Gerät, das zugleich Tradition und Ambition verkörperte.

Und wenn man ihn heute einschaltet, hört man zuerst das leise Klicken des Relais, sieht die vertrauten Farben aufleuchten und spürt diesen feinen Übergang zwischen zwei Epochen. Der ZX Spectrum 128 war nie nur ein technisches Artefakt. Er war der letzte große Funke aus Cambridge, bevor der Staffelstab an Amstrad überging – ein Rechner, der zeigte, wie weit man mit einer guten Idee, einem alten Prozessor und 128 KB Hoffnung kommen konnte.

Wenn man den Herzschlag eines Atari-Heimcomputers suchte, fand man ihn nicht in der CPU, sondern in einem unscheinbaren, aber genialen Baustein: dem ANTIC, kurz für Alphanumeric Television Interface Controller. Was auf den ersten Blick wie ein nüchterner Schaltkreisname aus der Laborwelt klang, war in Wahrheit der kreative Motor, der die Atari-8-Bit-Rechner zu den grafisch eindrucksvollsten Heimcomputern ihrer Zeit machte. ANTIC war kein gewöhnlicher Videochip – er war ein kleiner, eigenständiger Mikroprozessor, der das Bildschirmgeschehen selbstständig berechnete, während die Haupt-CPU sich um Logik, Sound und Eingaben kümmern konnte.

Wenn man den Herzschlag eines Atari-Heimcomputers suchte, fand man ihn nicht in der CPU, sondern in einem unscheinbaren, aber genialen Baustein: dem ANTIC, kurz für Alphanumeric Television Interface Controller. Was auf den ersten Blick wie ein nüchterner Schaltkreisname aus der Laborwelt klang, war in Wahrheit der kreative Motor, der die Atari-8-Bit-Rechner zu den grafisch eindrucksvollsten Heimcomputern ihrer Zeit machte. ANTIC war kein gewöhnlicher Videochip – er war ein kleiner, eigenständiger Mikroprozessor, der das Bildschirmgeschehen selbstständig berechnete, während die Haupt-CPU sich um Logik, Sound und Eingaben kümmern konnte.

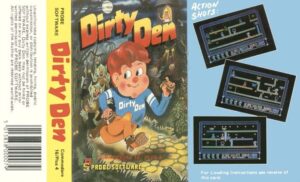

Als 1986 das Spiel Dirty Den für den Commodore 16 und den Plus/4 erschien, ahnte wohl kaum jemand, dass hier eines der letzten großen Action-Signale für die kleine Commodore-Reihe gesetzt wurde. Das Spiel, entwickelt von Vakis Paraskeva für Probe Software, wurde in 16 Kilobyte Maschinencode gepresst – eine technische Leistung, wenn man bedenkt, dass allein der Titelbildschirm und die Spiellogik schon einen beachtlichen Teil des Speichers verschlangen. Probe Software, 1984 von Paraskeva und Fergus McGovern gegründet, war damals ein Zwei-Mann-Betrieb, der buchstäblich alles selbst machte: „At this stage everything from packaging to marketing was still done by Fergus and Vakis … it was turning into a 24 hours a day job.“ Übersetzt: „In dieser Phase wurden Verpackung und Marketing noch ganz von Fergus und Vakis gemacht … es entwickelte sich zu einem 24-Stunden-Job.“

Als 1986 das Spiel Dirty Den für den Commodore 16 und den Plus/4 erschien, ahnte wohl kaum jemand, dass hier eines der letzten großen Action-Signale für die kleine Commodore-Reihe gesetzt wurde. Das Spiel, entwickelt von Vakis Paraskeva für Probe Software, wurde in 16 Kilobyte Maschinencode gepresst – eine technische Leistung, wenn man bedenkt, dass allein der Titelbildschirm und die Spiellogik schon einen beachtlichen Teil des Speichers verschlangen. Probe Software, 1984 von Paraskeva und Fergus McGovern gegründet, war damals ein Zwei-Mann-Betrieb, der buchstäblich alles selbst machte: „At this stage everything from packaging to marketing was still done by Fergus and Vakis … it was turning into a 24 hours a day job.“ Übersetzt: „In dieser Phase wurden Verpackung und Marketing noch ganz von Fergus und Vakis gemacht … es entwickelte sich zu einem 24-Stunden-Job.“ Das Spiel verläuft in klassischer Bildschirm-zu-Bildschirm-Manier: Jeder Raum ist ein Puzzle aus Leitern, Plattformen und beweglichen Objekten. Feindliche Kreaturen – meist fliegende Wesen, animierte Bälle oder kleine Roboter – bewegen sich nach festen Mustern, und die Herausforderung liegt darin, das Timing ihrer Bahnen zu studieren. Den springt mit erstaunlicher Präzision, was dem Spiel trotz seiner Einfachheit eine gewisse Geschmeidigkeit verleiht. Fallen wie Dornen, rollende Geschosse oder Laserbarrieren zwingen den Spieler zu vorausschauender Bewegung – ein Fehler, und man beginnt den Raum von vorn. Manche Räume haben zusätzlich trickreiche Mechanismen: Plattformen, die unter den Füßen verschwinden, oder Aufzüge, die nur bei Kontakt mit bestimmten Objekten reagieren. Ein kleines, aber feines Detail sind die Schokoladenstücke selbst – sie sind oft so platziert, dass man riskante Sprünge wagen muss, anstatt den sicheren Weg zu nehmen. Dieses Element verleiht Dirty Den einen gewissen Suchtfaktor: „Nur noch einen Versuch, diesmal schaffe ich’s ohne Absturz!“ – ein Satz, den man 1986 in so manchem Kinderzimmer gehört haben dürfte.

Das Spiel verläuft in klassischer Bildschirm-zu-Bildschirm-Manier: Jeder Raum ist ein Puzzle aus Leitern, Plattformen und beweglichen Objekten. Feindliche Kreaturen – meist fliegende Wesen, animierte Bälle oder kleine Roboter – bewegen sich nach festen Mustern, und die Herausforderung liegt darin, das Timing ihrer Bahnen zu studieren. Den springt mit erstaunlicher Präzision, was dem Spiel trotz seiner Einfachheit eine gewisse Geschmeidigkeit verleiht. Fallen wie Dornen, rollende Geschosse oder Laserbarrieren zwingen den Spieler zu vorausschauender Bewegung – ein Fehler, und man beginnt den Raum von vorn. Manche Räume haben zusätzlich trickreiche Mechanismen: Plattformen, die unter den Füßen verschwinden, oder Aufzüge, die nur bei Kontakt mit bestimmten Objekten reagieren. Ein kleines, aber feines Detail sind die Schokoladenstücke selbst – sie sind oft so platziert, dass man riskante Sprünge wagen muss, anstatt den sicheren Weg zu nehmen. Dieses Element verleiht Dirty Den einen gewissen Suchtfaktor: „Nur noch einen Versuch, diesmal schaffe ich’s ohne Absturz!“ – ein Satz, den man 1986 in so manchem Kinderzimmer gehört haben dürfte. Als Philips im Juli 1985 das externe CM 100 vorstellte, war der Gedanke ebenso schlicht wie revolutionär: die Lasertechnik der Audio-CDs für massenhaft digitale Daten zu nutzen und damit aus dem PC ein Recherchewerkzeug zu machen. Das komplette Paket – Laufwerk, ISA-Interface und eine silbergraue Kiste von etwa 36 × 15 × 25 cm – kam in den Handel und wurde oft zusammen mit Grolier’s Electronic Encyclopedia gezeigt; die Compute! rezensierte 1986 genau dieses Set und notierte trocken, dass der Player „übrigens keine Audio-CDs abspielen kann“ – eine frühe Klarstellung gegen falsche Erwartungen aus der Hi-Fi-Welt. Preislich lag das System bei 1.495 US-Dollar. Inflationsbereinigt entspricht das heute grob 4.500 US-Dollar bzw. rund 4.200 Euro – kein Schnäppchen, aber für Institutionen und Pioniere ein Türöffner in die „Silberling-Zukunft“.

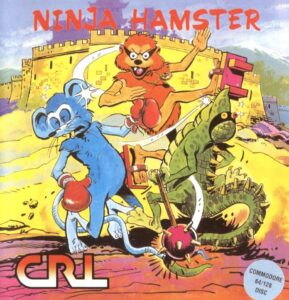

Als Philips im Juli 1985 das externe CM 100 vorstellte, war der Gedanke ebenso schlicht wie revolutionär: die Lasertechnik der Audio-CDs für massenhaft digitale Daten zu nutzen und damit aus dem PC ein Recherchewerkzeug zu machen. Das komplette Paket – Laufwerk, ISA-Interface und eine silbergraue Kiste von etwa 36 × 15 × 25 cm – kam in den Handel und wurde oft zusammen mit Grolier’s Electronic Encyclopedia gezeigt; die Compute! rezensierte 1986 genau dieses Set und notierte trocken, dass der Player „übrigens keine Audio-CDs abspielen kann“ – eine frühe Klarstellung gegen falsche Erwartungen aus der Hi-Fi-Welt. Preislich lag das System bei 1.495 US-Dollar. Inflationsbereinigt entspricht das heute grob 4.500 US-Dollar bzw. rund 4.200 Euro – kein Schnäppchen, aber für Institutionen und Pioniere ein Türöffner in die „Silberling-Zukunft“. Ninja Schildkröten, eine Ratte als Meister, ein Pferd mit einem mächtigen Schießprügel (Brave Starr) oder zwei Streifenhörnchen als Ritter des Rechts (Chip 'n Dale, in Deutschland eher als Chip und Chap - Ritter des Rechts bekannt): wieso also nicht auch ein Nahkampf-Hamster?

Ninja Schildkröten, eine Ratte als Meister, ein Pferd mit einem mächtigen Schießprügel (Brave Starr) oder zwei Streifenhörnchen als Ritter des Rechts (Chip 'n Dale, in Deutschland eher als Chip und Chap - Ritter des Rechts bekannt): wieso also nicht auch ein Nahkampf-Hamster?

Als Hercules – The Twelve Labours 1984 bei Alpha Omega Software erschien, ahnte kaum jemand, dass dieses Plattformspiel zu einem jener kuriosen Phänomene werden würde, die gleichermaßen belächelt, verflucht und geliebt wurden. Der junge Programmierer Steve Bak, zuvor Grafiker bei Bug-Byte, hatte sich vorgenommen, die griechische Mythologie mit der Logik von 8-Bit-Mechaniken zu verschmelzen. Die Idee klang zunächst ambitioniert: zwölf Aufgaben, inspiriert von den klassischen Heldentaten des Zeus-Sohnes, verteilt über dutzende Bildschirme, zufällig auswählbar, jedes mit eigener Animation, Gegnern und Hindernissen. Bak selbst nannte das Konzept später „zu groß für den Speicher, aber zu schön, um es nicht zu versuchen.“

Als Hercules – The Twelve Labours 1984 bei Alpha Omega Software erschien, ahnte kaum jemand, dass dieses Plattformspiel zu einem jener kuriosen Phänomene werden würde, die gleichermaßen belächelt, verflucht und geliebt wurden. Der junge Programmierer Steve Bak, zuvor Grafiker bei Bug-Byte, hatte sich vorgenommen, die griechische Mythologie mit der Logik von 8-Bit-Mechaniken zu verschmelzen. Die Idee klang zunächst ambitioniert: zwölf Aufgaben, inspiriert von den klassischen Heldentaten des Zeus-Sohnes, verteilt über dutzende Bildschirme, zufällig auswählbar, jedes mit eigener Animation, Gegnern und Hindernissen. Bak selbst nannte das Konzept später „zu groß für den Speicher, aber zu schön, um es nicht zu versuchen.“

Die Entstehungsgeschichte lebt von einem Namen, der in der Unternehmenschronik mehrfach auftaucht: Kunio Nakanishi. Er führte in Sharps Bauteile-Sparte das Team, das vom 4-Bit-Bausatz MZ-40K (Frühjahr 1978) zum „assemble-it-yourself“-MZ-80K (Dezember 1978) marschierte – erst als Bausatz in Japan, ab 1979 dann als fertig montiertes Gerät für Europa. Dieses organisatorische „Von unten nach oben“ prägte die Serie; erst 1981 bündelte Sharp die verstreuten Aktivitäten in einer eigenen PC-Division. Nakanishi steht damit als Ingenieur-Figur für ein sehr japanisches Vorgehen: erst solide Technik in kleinen, beherrschbaren Schritten, dann größere Serien und Varianten.

Die Entstehungsgeschichte lebt von einem Namen, der in der Unternehmenschronik mehrfach auftaucht: Kunio Nakanishi. Er führte in Sharps Bauteile-Sparte das Team, das vom 4-Bit-Bausatz MZ-40K (Frühjahr 1978) zum „assemble-it-yourself“-MZ-80K (Dezember 1978) marschierte – erst als Bausatz in Japan, ab 1979 dann als fertig montiertes Gerät für Europa. Dieses organisatorische „Von unten nach oben“ prägte die Serie; erst 1981 bündelte Sharp die verstreuten Aktivitäten in einer eigenen PC-Division. Nakanishi steht damit als Ingenieur-Figur für ein sehr japanisches Vorgehen: erst solide Technik in kleinen, beherrschbaren Schritten, dann größere Serien und Varianten.

Der Agat-7 erhielt außerdem ein robusteres Metallgehäuse, eine neue Tastatur mit kyrillischer und lateinischer Beschriftung, sowie ein Netzteil, das nicht mehr regelmäßig überhitzte. Für die Massenfertigung sorgte das Werk „МЭЗ“ in Murom, das im Auftrag des Bildungsministeriums jährlich Tausende Geräte produzierte. Bis 1988 waren über 12 000 Agat-Rechner ausgeliefert, die meisten davon in Schulen und wissenschaftlichen Einrichtungen.

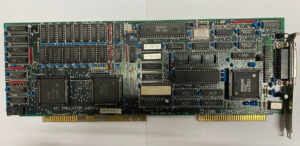

Der Agat-7 erhielt außerdem ein robusteres Metallgehäuse, eine neue Tastatur mit kyrillischer und lateinischer Beschriftung, sowie ein Netzteil, das nicht mehr regelmäßig überhitzte. Für die Massenfertigung sorgte das Werk „МЭЗ“ in Murom, das im Auftrag des Bildungsministeriums jährlich Tausende Geräte produzierte. Bis 1988 waren über 12 000 Agat-Rechner ausgeliefert, die meisten davon in Schulen und wissenschaftlichen Einrichtungen. Man stelle sich vor, man besitzt Ende der 1980er einen Commodore Amiga und will trotzdem MS-DOS-Programme laufen lassen – die Steckkarte A2088 machte genau das möglich. Diese vollformatige Zorro-II-Erweiterung verwandelte den Amiga 2000 in einen waschechten IBM-PC XT. Commodore stellte die A2088 Bridgeboard-Karte 1987 offiziell vor, und sie enthielt einen Intel 8088 mit 4,77 MHz, 512 KB RAM und ein XT-kompatibles BIOS – kurz: ein kompletter PC zum Einstecken. Der Einführungspreis lag bei rund 699 US-Dollar, was inflationsbereinigt etwa 1.800 Euro entspricht. Für fast denselben Betrag bekam man damals schon einen kompletten PC-Clone, was erklärt, warum die Karte eher ein Werkzeug für Profis und Technikverliebte blieb als ein Massenprodukt.

Man stelle sich vor, man besitzt Ende der 1980er einen Commodore Amiga und will trotzdem MS-DOS-Programme laufen lassen – die Steckkarte A2088 machte genau das möglich. Diese vollformatige Zorro-II-Erweiterung verwandelte den Amiga 2000 in einen waschechten IBM-PC XT. Commodore stellte die A2088 Bridgeboard-Karte 1987 offiziell vor, und sie enthielt einen Intel 8088 mit 4,77 MHz, 512 KB RAM und ein XT-kompatibles BIOS – kurz: ein kompletter PC zum Einstecken. Der Einführungspreis lag bei rund 699 US-Dollar, was inflationsbereinigt etwa 1.800 Euro entspricht. Für fast denselben Betrag bekam man damals schon einen kompletten PC-Clone, was erklärt, warum die Karte eher ein Werkzeug für Profis und Technikverliebte blieb als ein Massenprodukt.