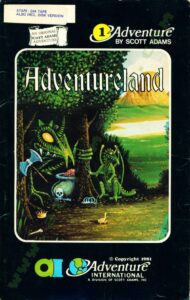

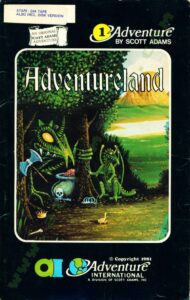

Es war eine Zeit, in der Computer noch keine Selbstverständlichkeit waren, sondern Versprechen. Während sich Großrechner in Universitäten und Forschungseinrichtungen bereits als Werkzeuge etabliert hatten, begann sich im Jahr 1978 langsam ein neuer Gedanke durchzusetzen: dass diese Maschinen auch in den eigenen vier Wänden stehen könnten. In genau diesem Moment erschien ein Spiel, das auf den ersten Blick unscheinbar wirkte, sich rückblickend jedoch als einer der entscheidenden Übergangspunkte herausstellen sollte – Adventureland.

Es war eine Zeit, in der Computer noch keine Selbstverständlichkeit waren, sondern Versprechen. Während sich Großrechner in Universitäten und Forschungseinrichtungen bereits als Werkzeuge etabliert hatten, begann sich im Jahr 1978 langsam ein neuer Gedanke durchzusetzen: dass diese Maschinen auch in den eigenen vier Wänden stehen könnten. In genau diesem Moment erschien ein Spiel, das auf den ersten Blick unscheinbar wirkte, sich rückblickend jedoch als einer der entscheidenden Übergangspunkte herausstellen sollte – Adventureland.

Hinter diesem Titel stand Scott Adams, ein Programmierer, der von einem der frühesten Computerabenteuer überhaupt fasziniert war: Colossal Cave Adventure. Doch während dieses noch auf Großrechnern lief und damit nur einem kleinen Kreis zugänglich war, verfolgte Adams ein anderes Ziel. Er wollte ein vergleichbares Erlebnis auf einem Heimcomputer ermöglichen – konkret auf dem TRS-80 Model I, einer Maschine, die in ihrer Grundausstattung mit gerade einmal 16 Kilobyte Arbeitsspeicher auskommen musste. Was zunächst wie ein unüberwindbares Hindernis klingt, wurde letztlich zum Ausgangspunkt einer der ersten echten Designentscheidungen der Spielegeschichte.

Anstatt ein Spiel im klassischen Sinne zu programmieren, entwickelte Adams ein System. Adventureland besteht nicht aus fest codierten Abläufen, sondern aus einer strukturierten Sammlung von Daten, die von einem Interpreter verarbeitet werden. Räume, Gegenstände und Zustände sind keine fest verdrahteten Elemente, sondern Einträge in einer Tabelle, die vom Programm gelesen werden. Damit entstand – wenn auch unter anderen Vorzeichen – eine der frühesten Formen dessen, was man heute als Game Engine bezeichnen würde. Der eigentliche Vorteil dieses Ansatzes zeigte sich unmittelbar: Neue Spiele konnten entstehen, ohne die technische Grundlage neu entwickeln zu müssen. Tatsächlich folgten innerhalb kurzer Zeit weitere Titel wie Pirate Adventure oder Voodoo Castle, die auf genau diesem Fundament aufbauten und über Adams’ Firma Adventure International vertrieben wurden.

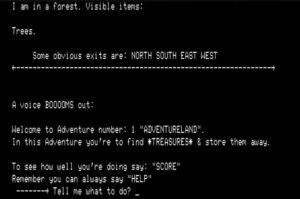

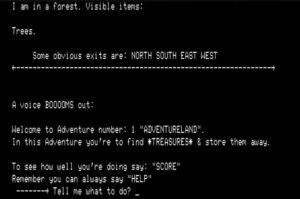

Inhaltlich präsentiert sich Adventureland hingegen bemerkenswert nüchtern. Eine ausgearbeitete Geschichte existiert praktisch nicht. Stattdessen besteht das Ziel darin, dreizehn verstreute Schätze zu finden und an einem bestimmten Ort abzulegen. Wälder, Höhlen und vereinzelte fantastische Elemente bilden den Rahmen, doch sie dienen weniger der Atmosphäre als der Funktion. Aus heutiger Sicht mag das beinahe enttäuschend wirken, doch diese Reduktion war kein Mangel, sondern eine Konsequenz der technischen Rahmenbedingungen. Jeder zusätzliche Satz, jede komplexere Beschreibung hätte wertvollen Speicher verbraucht. Die Entscheidung für Kürze war also keine stilistische, sondern eine zwingende.

Diese Beschränkung zeigt sich besonders deutlich im Eingabesystem. Der Parser von Adventureland arbeitet mit einem Zwei-Wort-Schema, bestehend aus Verb und Objekt. Befehle wie „GET LAMP“ oder „GO NORTH“ bilden das Fundament der Interaktion. Dabei reicht es sogar aus, die ersten drei Buchstaben eines Wortes einzugeben – ein weiterer Hinweis darauf, wie konsequent Adams auf Effizienz bedacht war. Im Vergleich zu späteren Adventures, die vollständige Sätze verstehen konnten, wirkt dieses System stark reduziert, doch es erfüllte seinen Zweck: Es machte das Spiel auf einem Heimcomputer überhaupt erst möglich.

Was Adventureland dabei besonders deutlich zeigt, ist die Denkweise seiner Zeit – und die offenbart sich vor allem in den Momenten, in denen das Spiel scheinbar „unfair“ wirkt. Wer die Höhle ohne Licht betritt, wird ohne Vorwarnung bestraft. Wer einen wichtigen Gegenstand zurücklässt oder an der falschen Stelle einsetzt, kann sich unbemerkt in eine Situation manövrieren, aus der es kein Zurück mehr gibt. Das Spiel erklärt nichts, es kommentiert nichts – es registriert lediglich. Diese Konsequenz ist kein Versehen, sondern Teil des Systems.

Gerade darin liegt ein wesentlicher Unterschied zu späteren Adventures. Während Titel wie Zork begannen, ihre Welten logisch aufzubauen und den Spieler subtil zu führen, bleibt Adventureland kompromisslos funktional. Räume existieren nicht, weil sie eine glaubwürdige Umgebung formen, sondern weil sie eine Aufgabe erfüllen. Gegenstände sind keine Requisiten einer Geschichte, sondern Schlüssel in einem System aus Bedingungen und Zuständen.

Das wird besonders im Umgang mit dem Inventar deutlich. Die begrenzte Tragfähigkeit zwingt den Spieler dazu, früh eine Art „Basislager“ zu etablieren, an dem gefundene Schätze gesammelt werden. Wer diesen Zusammenhang nicht erkennt, läuft Gefahr, sich selbst den Fortschritt zu blockieren. Ebenso typisch ist die Notwendigkeit, scheinbar bedeutungslose Orte mehrfach zu besuchen – nicht, weil sich die Welt verändert hätte, sondern weil der Spieler es inzwischen getan hat.

Aus heutiger Sicht wirken viele dieser Situationen spröde oder gar ungerecht. Doch sie spiegeln eine Zeit wider, in der Spiele weniger als geführte Erfahrung verstanden wurden, sondern als Herausforderung, die es zu entschlüsseln galt. Adventureland verlangt kein Reaktionsvermögen und keine Geschicklichkeit – es verlangt Aufmerksamkeit, Geduld und die Bereitschaft, aus Fehlern zu lernen.

Der zeitgenössische Blick fiel entsprechend aus. In People’s Computers / Recreational Computing wurde das Spiel als „a true tour-de-force … on only a 16k TRS-80“ bezeichnet – eine Einschätzung, die weniger das eigentliche Spiel als vielmehr die technische Leistung würdigte. Auch 80-U.S. / Basic Computing empfahl den Titel ausdrücklich jenen Spielern, die bereit waren, sich auf eine Herausforderung einzulassen, und betonte gleichzeitig die ungewöhnlichen und teils humorvollen Situationen, die sich daraus ergaben. Diese Stimmen machen deutlich, dass Adventureland bereits damals nicht als perfektes Spiel verstanden wurde, sondern als bemerkenswerter Schritt.

Im direkten Vergleich mit Zork, das ursprünglich auf Großrechnern am MIT entwickelt wurde, treten die Unterschiede klar zutage. Während Zork mit komplexeren Sprachstrukturen, einer zusammenhängenden Welt und einem deutlich stärkeren Fokus auf Atmosphäre arbeitet, bleibt Adventureland bei seiner reduzierten, systematischen Herangehensweise. Doch dieser Vergleich greift nur bedingt, denn beide Spiele entstammen unterschiedlichen Voraussetzungen. Zork konnte auf deutlich leistungsfähigere Hardware zurückgreifen und profitierte von einem größeren Entwicklungsteam, während Adventureland aus der Notwendigkeit heraus entstand, mit minimalen Ressourcen auszukommen. Entscheidend ist daher weniger, welches Spiel „besser“ ist, sondern welches den entscheidenden Schritt gemacht hat.

Und dieser Schritt liegt eindeutig bei Adventureland. Es brachte das Konzept des interaktiven Abenteuers aus den Universitäten in die Wohnzimmer. Es zeigte, dass Spiele nicht nur möglich, sondern auch vermarktbar waren. Der ursprüngliche Verkaufspreis von rund 24,95 US-Dollar – inflationsbereinigt heute etwa 90 bis 100 Euro – unterstreicht dabei, dass es sich nicht um ein beiläufiges Experiment handelte, sondern um ein ernstzunehmendes Produkt.

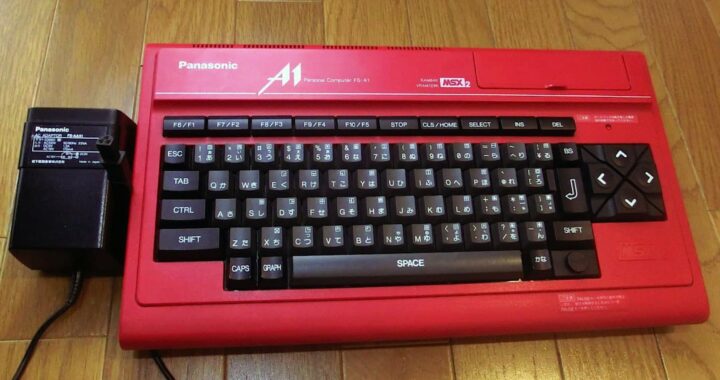

Auffällig ist dabei, wie schnell sich Adventureland über seine Ursprungsplattform hinaus verbreitete. Innerhalb weniger Jahre erschien das Spiel auf einer Vielzahl von Systemen – vom Apple II über den Commodore 64 und den ZX Spectrum bis hin zu eher spezialisierten Geräten wie dem TI-99/4A oder dem Exidy Sorcerer. Auch Systeme wie der Commodore PET 2001, der Commodore VIC-20, die britischen Mikrocomputer BBC Micro und Acorn Electron sowie der Dragon 32/64 und frühe IBM-kompatible PCs gehörten zu den Plattformen, auf denen Adams’ Adventure-Interpreter zum Einsatz kam. Diese breite Streuung war kein Zufall, sondern direkte Folge des zugrunde liegenden Systems: Da die Spielwelt als Daten organisiert war, musste im Grunde nur der Interpreter an die jeweilige Hardware angepasst werden.

Gerade diese Portierungen zeigen jedoch, wie unterschiedlich sich ein scheinbar identisches Spiel anfühlen konnte. Die ursprüngliche TRS-80-Version blieb die technisch roheste Form. Ihre Texte sind knapp, die Reaktionszeiten durch die Kassettenspeicherung spürbar, und der Parser reagiert strikt auf die bekannten Zwei-Wort-Befehle. Hier zeigt sich das Spiel am unmittelbarsten als Produkt seiner Entstehungsbedingungen – reduziert, funktional, kompromisslos.

Auf Systemen wie dem Apple II oder dem Commodore PET änderte sich zunächst weniger am Inhalt als an der Geschwindigkeit und Stabilität. Diskettenlaufwerke verkürzten Ladezeiten erheblich, und die Darstellung wirkte durch klarere Monitorausgaben oft angenehmer lesbar. Der Kern blieb jedoch unverändert, was diese Versionen zu den „authentischsten“ Alternativen zur TRS-80-Fassung macht.

Mit dem Aufkommen farbfähiger Heimcomputer verschob sich der Schwerpunkt leicht. Versionen für den Commodore 64, den Atari 8-bit oder den ZX Spectrum erhielten teilweise grafische Ergänzungen – einfache Illustrationen, die einzelne Szenen begleiteten. Diese Bilder waren kein integraler Bestandteil des Spiels, sondern eher eine visuelle Rahmung, die dem Titel eine modernere Anmutung verlieh. Gleichzeitig blieb die eigentliche Interaktion strikt textbasiert. Interessanterweise veränderte diese Ergänzung die Wahrnehmung stärker als das Spiel selbst: Während die ursprüngliche Version die Fantasie vollständig dem Spieler überließ, boten die Grafikversionen erste visuelle Interpretationen der Spielwelt.

Auf kleineren Systemen wie dem Commodore VC-20 oder dem Acorn Electron zeigten sich dagegen erneut die Grenzen der Hardware. Hier mussten Texte teilweise weiter gekürzt oder Speicher effizienter genutzt werden, was den ohnehin minimalistischen Stil noch stärker verdichtete. Diese Fassungen wirken bisweilen fast wie Essenzen des Originals – noch direkter, noch reduzierter.

Die IBM-PC-Versionen schließlich markieren bereits den Übergang in eine neue Ära. Mit mehr Speicher und verbesserten Ein- und Ausgabemöglichkeiten ließen sich komfortablere Varianten umsetzen, ohne jedoch die grundlegende Struktur zu verändern. Gerade hier wird deutlich, wie langlebig das ursprüngliche Konzept war: Selbst auf deutlich leistungsfähigeren Systemen blieb das Spiel im Kern identisch.

Bemerkenswert ist dabei, dass keine dieser Versionen das ursprüngliche Design grundlegend verändert. Es gibt keine erweiterten Handlungsstränge, keine neuen Mechaniken, keine „verbesserten“ Rätsel im modernen Sinne. Stattdessen zeigt jede Portierung vor allem eines: die Anpassungsfähigkeit eines Konzepts, das von Anfang an nicht an eine bestimmte Maschine gebunden war. Während viele andere frühe Spiele eng mit ihrer Hardware verwoben blieben, ließ sich Adventureland nahezu unverändert übertragen – ein Umstand, der seine Rolle als eines der ersten wirklich plattformübergreifenden Spiele unterstreicht.

Gerade im direkten Vergleich dieser Versionen wird deutlich, dass sich nicht nur die Technik entwickelte, sondern auch die Erwartungshaltung der Spieler. Was auf dem TRS-80 noch als bemerkenswerte Leistung galt, wirkte wenige Jahre später bereits schlicht. Doch anstatt zu verschwinden, passte sich Adventureland an – leise, unspektakulär und gerade deshalb bemerkenswert konsequent.

Rückblickend betrachtet wirkt vieles an Adventureland roh, reduziert und bisweilen widerspenstig. Doch genau darin liegt seine Bedeutung. Es ist kein Spiel, das den Spieler an die Hand nimmt, sondern eines, das ihn zwingt, selbst zu verstehen, wie es funktioniert. Und vielleicht ist das der entscheidende Punkt: Die eigentliche Aufgabe besteht nicht darin, die Schätze zu finden – sondern die Logik hinter dem Spiel zu begreifen.

Als NEC Anfang der 1980er Jahre mit dem NEC PC-6001 in Japan einen vergleichsweise günstigen und bewusst einfach zugänglichen Heimcomputer etablierte, lag ein Schritt nahe, der aus heutiger Sicht fast selbstverständlich wirkt: der Blick über den eigenen Markt hinaus. Der daraus entstandene NEC PC-6001A, in den USA unter dem Namen NEC TREK vertrieben, war dabei weniger ein neues System als vielmehr ein Versuch, ein bestehendes Konzept in einen völlig anderen Markt zu übertragen – mit bemerkenswert ernüchterndem Ergebnis.

Als NEC Anfang der 1980er Jahre mit dem NEC PC-6001 in Japan einen vergleichsweise günstigen und bewusst einfach zugänglichen Heimcomputer etablierte, lag ein Schritt nahe, der aus heutiger Sicht fast selbstverständlich wirkt: der Blick über den eigenen Markt hinaus. Der daraus entstandene NEC PC-6001A, in den USA unter dem Namen NEC TREK vertrieben, war dabei weniger ein neues System als vielmehr ein Versuch, ein bestehendes Konzept in einen völlig anderen Markt zu übertragen – mit bemerkenswert ernüchterndem Ergebnis.

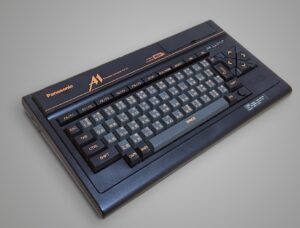

Gerade diese Integration erklärt, warum der FS-A1 im Inneren vergleichsweise aufgeräumt wirkt. Große, zentrale Chips dominieren das Layout, während diskrete Logikbausteine in den Hintergrund treten. Dennoch bleibt die klassische MSX-Struktur erhalten: Der Grafikchip arbeitet unabhängig vom Systemcontroller, und die CPU kommuniziert über ein klar definiertes Bus-System. Es handelt sich also nicht um ein Ein-Chip-System, sondern um eine bereits stark verdichtete Form eines modular gedachten Rechners.

Gerade diese Integration erklärt, warum der FS-A1 im Inneren vergleichsweise aufgeräumt wirkt. Große, zentrale Chips dominieren das Layout, während diskrete Logikbausteine in den Hintergrund treten. Dennoch bleibt die klassische MSX-Struktur erhalten: Der Grafikchip arbeitet unabhängig vom Systemcontroller, und die CPU kommuniziert über ein klar definiertes Bus-System. Es handelt sich also nicht um ein Ein-Chip-System, sondern um eine bereits stark verdichtete Form eines modular gedachten Rechners.

Zu den bekanntesten Spielen gehört

Zu den bekanntesten Spielen gehört  Es war eine Zeit, in der Computer noch keine Selbstverständlichkeit waren, sondern Versprechen. Während sich Großrechner in Universitäten und Forschungseinrichtungen bereits als Werkzeuge etabliert hatten, begann sich im Jahr 1978 langsam ein neuer Gedanke durchzusetzen: dass diese Maschinen auch in den eigenen vier Wänden stehen könnten. In genau diesem Moment erschien ein Spiel, das auf den ersten Blick unscheinbar wirkte, sich rückblickend jedoch als einer der entscheidenden Übergangspunkte herausstellen sollte – Adventureland.

Es war eine Zeit, in der Computer noch keine Selbstverständlichkeit waren, sondern Versprechen. Während sich Großrechner in Universitäten und Forschungseinrichtungen bereits als Werkzeuge etabliert hatten, begann sich im Jahr 1978 langsam ein neuer Gedanke durchzusetzen: dass diese Maschinen auch in den eigenen vier Wänden stehen könnten. In genau diesem Moment erschien ein Spiel, das auf den ersten Blick unscheinbar wirkte, sich rückblickend jedoch als einer der entscheidenden Übergangspunkte herausstellen sollte – Adventureland.

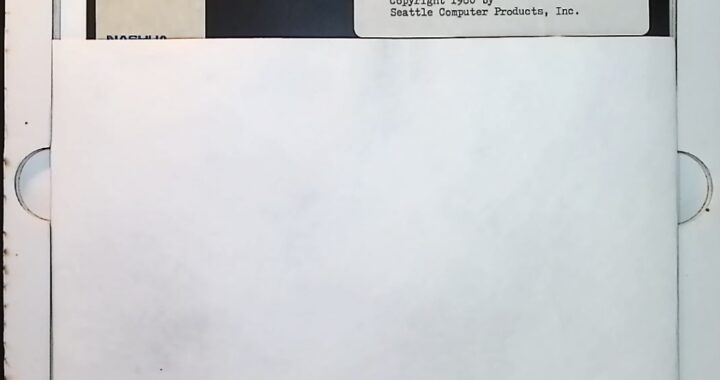

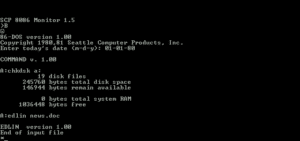

Seattle, Frühjahr 1980. In den Büroräumen von Seattle Computer Products sitzt ein junger Entwickler über einem neuen Projekt. Die Firma hat gerade eine Prozessorplatine für den Intel 8086 entwickelt – eine leistungsfähige 16-Bit-CPU, die auf dem damals verbreiteten S-100-Bus eingesetzt werden soll. Doch ohne ein Betriebssystem bleibt die Hardware kaum nutzbar. Also beginnt der Ingenieur Tim Paterson, ein eigenes System zu schreiben. In wenigen Wochen entsteht ein funktionierendes System, das intern den pragmatischen Namen „Quick and Dirty Operating System“ erhält. Jahrzehnte später erinnerte sich Paterson nüchtern an diese Situation: Er habe das System schlicht geschrieben, „weil wir ein Betriebssystem für die

Seattle, Frühjahr 1980. In den Büroräumen von Seattle Computer Products sitzt ein junger Entwickler über einem neuen Projekt. Die Firma hat gerade eine Prozessorplatine für den Intel 8086 entwickelt – eine leistungsfähige 16-Bit-CPU, die auf dem damals verbreiteten S-100-Bus eingesetzt werden soll. Doch ohne ein Betriebssystem bleibt die Hardware kaum nutzbar. Also beginnt der Ingenieur Tim Paterson, ein eigenes System zu schreiben. In wenigen Wochen entsteht ein funktionierendes System, das intern den pragmatischen Namen „Quick and Dirty Operating System“ erhält. Jahrzehnte später erinnerte sich Paterson nüchtern an diese Situation: Er habe das System schlicht geschrieben, „weil wir ein Betriebssystem für die  Das Projekt erhielt intern zunächst den Namen QDOS, eine Abkürzung für „Quick and Dirty Operating System“. In frühen Anzeigen und Produktinformationen von Seattle Computer Products wurde diese Bezeichnung zeitweise auch öffentlich verwendet. Schon bald entschied sich das Unternehmen jedoch für den Namen 86-DOS, der sich direkt auf den verwendeten Intel-Prozessor bezog und professioneller wirkte.

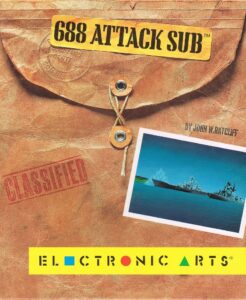

Das Projekt erhielt intern zunächst den Namen QDOS, eine Abkürzung für „Quick and Dirty Operating System“. In frühen Anzeigen und Produktinformationen von Seattle Computer Products wurde diese Bezeichnung zeitweise auch öffentlich verwendet. Schon bald entschied sich das Unternehmen jedoch für den Namen 86-DOS, der sich direkt auf den verwendeten Intel-Prozessor bezog und professioneller wirkte. Als Ende der 1980er-Jahre mehrere militärische Simulationen auf Heimcomputern erschienen, war das Interesse an moderner U-Boot-Technik plötzlich ungewöhnlich groß. Einen wichtigen Anteil daran hatte der internationale Erfolg von Tom Clancys Roman The Hunt for Red October aus dem Jahr 1984, der erstmals einem breiten Publikum erklärte, wie Sonar, Jagd-U-Boote und taktische Manöver unter Wasser funktionieren. Gleichzeitig wurden Heimcomputer wie IBM-PC, Amiga und Atari ST leistungsfähig genug, um Instrumente, Karten und taktische Anzeigen gleichzeitig darzustellen. In dieses Umfeld hinein veröffentlichte Electronic Arts im Jahr 1989 die U-Boot-Simulation 688 Attack Sub, die den Spieler in die Rolle eines Kommandanten eines modernen nuklearen Jagd-U-Bootes versetzte.

Als Ende der 1980er-Jahre mehrere militärische Simulationen auf Heimcomputern erschienen, war das Interesse an moderner U-Boot-Technik plötzlich ungewöhnlich groß. Einen wichtigen Anteil daran hatte der internationale Erfolg von Tom Clancys Roman The Hunt for Red October aus dem Jahr 1984, der erstmals einem breiten Publikum erklärte, wie Sonar, Jagd-U-Boote und taktische Manöver unter Wasser funktionieren. Gleichzeitig wurden Heimcomputer wie IBM-PC, Amiga und Atari ST leistungsfähig genug, um Instrumente, Karten und taktische Anzeigen gleichzeitig darzustellen. In dieses Umfeld hinein veröffentlichte Electronic Arts im Jahr 1989 die U-Boot-Simulation 688 Attack Sub, die den Spieler in die Rolle eines Kommandanten eines modernen nuklearen Jagd-U-Bootes versetzte.

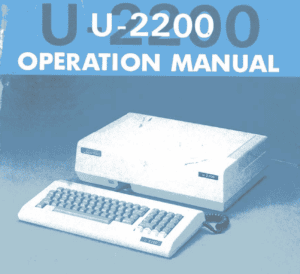

Der Unitron U-2200 gehört zu jener Generation von Mikrocomputern der frühen 1980er-Jahre, die in einer Phase entstanden, als sich noch keine einheitliche Architektur im Personal-Computer-Markt durchgesetzt hatte. Neben Systemen wie dem Apple II, verschiedenen CP/M-Rechnern und den ersten IBM-PC-Kompatiblen experimentierten zahlreiche kleinere Hersteller mit Maschinen, die mehrere Softwarewelten gleichzeitig unterstützen sollten. Der U-2200 wurde von der Firma Unitron in Taiwan produziert und über Händler unter anderem in Großbritannien, Australien und Teilen Europas vertrieben. Anzeigen aus Fachzeitschriften wie Personal Computer World aus dem Jahr 1984 bewarben das System ausdrücklich mit seiner Kombination aus Apple-II- und CP/M-Kompatibilität.

Der Unitron U-2200 gehört zu jener Generation von Mikrocomputern der frühen 1980er-Jahre, die in einer Phase entstanden, als sich noch keine einheitliche Architektur im Personal-Computer-Markt durchgesetzt hatte. Neben Systemen wie dem Apple II, verschiedenen CP/M-Rechnern und den ersten IBM-PC-Kompatiblen experimentierten zahlreiche kleinere Hersteller mit Maschinen, die mehrere Softwarewelten gleichzeitig unterstützen sollten. Der U-2200 wurde von der Firma Unitron in Taiwan produziert und über Händler unter anderem in Großbritannien, Australien und Teilen Europas vertrieben. Anzeigen aus Fachzeitschriften wie Personal Computer World aus dem Jahr 1984 bewarben das System ausdrücklich mit seiner Kombination aus Apple-II- und CP/M-Kompatibilität. Als Fujitsu im Oktober 1986 seine neue Generation der sogenannten „Audio-Visual Computer“ vorstellte, erschien neben dem Basismodell auch eine höher ausgestattete Variante. Der

Als Fujitsu im Oktober 1986 seine neue Generation der sogenannten „Audio-Visual Computer“ vorstellte, erschien neben dem Basismodell auch eine höher ausgestattete Variante. Der