Monty-pythonesker Einfall oder genialer Marketing-Trick? Im Herbst 1986 sorgt ausgerechnet ein Text-Adventure für Schlagzeilen: Dracula von CRL landet beim British Board of Film Censors – und das freiwillig. Computerspiele hatten bis dahin keine Altersfreigaben nötig, doch CRL-Chef Clem Chambers wittert eine Chance. Die Londoner schicken ihr Adventure mit ein paar blutigen Illustrationen zur Behörde und hoffen auf einen Skandal. Die BBFC vergibt tatsächlich ein „15“-Zertifikat, und CRL druckt stolz den Hinweis „nicht geeignet für unter 15-Jährige“ auf die Verpackung. Genau das sorgt für Aufmerksamkeit bei Medien und Horror-Fans. Hinter den Kulissen hätte man zwar gerne das noch drastischere „18“-Siegel gesehen, doch schon so funktioniert der PR-Coup. Im Jahr darauf folgen Frankenstein und 1987 Jack the Ripper – letzteres Spiel erhält dann tatsächlich eine 18er-Freigabe und schreibt damit Zensurgeschichte. Mitten in dieser kleinen Horrorwelle steht CRL mit Autor Rod Pike, der klassische Schauergeschichten als interaktive Fiction auf C64, ZX Spectrum und Amstrad CPC bringt.

Schon 1986 gilt Bram Stokers Dracula-Roman von 1897 als vielzitierter Kultstoff, und Pikes Spiel hält sich eng an die literarische Vorlage. Der junge Anwalt Jonathan Harker reist in die Karpaten, um Graf Dracula beim Immobilienkauf in England zu beraten. Das Spiel gliedert die Handlung in drei eigenständige Teile, die jeweils separat geladen werden. In The First Night verbringt Harker eine unheimliche Nacht im Gasthof „Goldene Krone“. In The Arrival erreicht er Draculas Schloss und begreift, dass er eigentlich Gefangener ist. Gelingt die Flucht, wechselt im dritten Teil The Hunt die Perspektive zu Dr. Seward, Leiter einer Irrenanstalt in Whitby. Er untersucht Harkers Warnungen vor mysteriösen Erde-Kisten und einem „Untoten“, während Patient Renfield immer seltsamer wird. Diese episodische Struktur deckt große Teile der Romanhandlung ab und passt zugleich zu den begrenzten Speicherreserven der 8-Bit-Rechner.

Technisch gehört Dracula klar in die Kategorie der Illustrated Text Adventures. Im Kern ist es ein reines Text-Adventure mit Parser-Eingabe, das wichtige Momente durch statische Bilder ergänzt. Auf allen Systemen arbeitet ein sehr einfacher Zwei-Wort-Parser nach dem Schema „Verb + Objekt“. Präpositionen oder komplexe Sätze ignoriert das Spiel, Kommandos wie „UNTERSUCHE RAUM“ oder „NIMM SCHLÜSSEL“ reichen. Das passt zur Entstehung mit dem populären Quill-Baukasten: Die Engine war für viele Autoren eine Einladung, Geschichten ohne tiefere Programmierkenntnisse umzusetzen, brachte aber klare Grenzen mit. Magazine wie Amstrad Action kritisierten, dass der Parser unbekannte Wörter nicht benennt, sondern nur lapidar mit „I don’t understand“ oder „You can’t do that“ reagiert – ein Verhalten, das eher an späte 70er-Jahre-Adventures erinnert. Türen erfordern exakt getimte Befehlsfolgen, alternative Formulierungen scheitern schnell. Wer statt „ZÜNDE LAMPE AN“ auf „BENUTZE LAMPE“ kommt, wird abgewiesen. Das bremst den Spielfluss, auch wenn Dracula insgesamt eher einsteigerfreundlich bleibt. Die ersten beiden Episoden verlaufen sehr linear und spielen auf wenigen Schauplätzen, benötigte Objekte liegen meist in der Nähe. Der dritte Teil öffnet die Struktur etwas, bleibt aber ebenfalls moderat im Anspruch; erfahrene Adventure-Spieler sehen den Abspann nach wenigen Stunden.

Trotz überschaubarer Mechanik gewinnt Dracula seine Wirkung aus der Atmosphäre. Rod Pike nutzt den Textspeicher intensiv, beschreibt Schauplätze und Ereignisse detailreich und mit hörbarer Vorliebe für Gothic-Vokabular. Wo andere Adventures der Zeit in knappen Telegrammsätzen sprechen, nimmt sich Dracula Zeit für Stimmung. Beim Einstieg im Gasthof liest der Spieler von flackernden Öllampen, gelben Lichtinseln und dunklen Ecken, in denen das Böse lauern könnte – genau diese Art Prosa lobten Testredaktionen. Crash stellte der Atmosphäre einen sehr hohen Wert gegenüber und sprach von „Romanqualität“ in den Beschreibungen. Die Kehrseite: Pro Kapitel gibt es nur eine Handvoll Räume, teilweise weniger als zehn, was Amstrad Action ausdrücklich notierte. Die fortlaufende Handlung mit geskripteten Ereignissen – Albträume, nächtliche Besuche, Visionen – sorgt für viel Lesestoff, ohne dass der Spieler immer aktiv eingreifen muss. Dracula fühlt sich dadurch eher wie eine interaktive Novelle oder ein Spielbuch an als wie ein klassisches Rätselabenteuer. Wer primär knobeln will, findet hier wenig Futter; wer sich gerne eine Gruselgeschichte erzählen lässt und ab und zu eingreift, wird deutlich besser bedient.

Die grafische Präsentation variiert von System zu System. Auf dem ZX Spectrum (48K) erscheinen die Illustrationen in einfachen, meist monochromen Bitmaps. Zeichner Jared Derrett holt aus der Hardware respektable Bilder heraus, die beim Laden zeilenweise aufgebaut werden und so für kurze Pausen sorgen. Um Speicher zu sparen, gönnt sich das Spiel nur wenige, gezielt eingesetzte Szenenbilder – etwa bei Albträumen oder besonders drastischen Momenten. Für 1986 wirken diese Pixelbilder sicher eindrucksvoll, heute eher harmlos. Amstrad Action kommentierte sinngemäß, die „fiesen Bilder“ seien in Wirklichkeit gar nicht so grausam – und auf einem Grünmonitor noch weniger. Auf dem Amstrad CPC (64K) nutzt Dracula den hochauflösenden Vier-Farben-Modus, was auf Farbbildschirmen durchaus stimmungsvoll wirkt, auf Grünmonitoren aber viele Details verschluckt. Die CPC-Version bleibt zudem weitgehend stumm. Mehr audiovisuelle Wirkung erzielt die C64-Fassung: Dank SID-Chip kann das Spiel eine kurze Titelmusik und simple Spannungs-Effekte abspielen; auch hier stammen die Grafiken von Jared Derrett, angepasst an die Multicolor-Möglichkeiten des Commodore. Auf allen Systemen setzt CRL eine verzierte Schriftart ein, um viktorianisches Flair zu transportieren. Besonders auf dem Spectrum stößt diese Wahl an Grenzen – Crash bezeichnete den Zeichensatz als einen der am schwersten lesbaren, die man je zu entziffern versucht habe. Auf CPC und C64 fällt das Problem weniger stark auf, doch besonders lange Sitzungen werden durch die Typografie anstrengend.

Zur Entstehungsgeschichte lässt sich heute recht klar sagen, wer für was verantwortlich war. Dracula entstand bei CRL unter dem Label The Zen Room. Autor und Designer war Rod Pike, der sich bereits zuvor mit Horror-Adaptionen einen Namen gemacht hatte. Er setzte unter anderem H. P. Lovecrafts The Dunwich Horror als Adventure um und schrieb kurz vor Dracula das mehrteilige Pilgrim. Die grafische Ausgestaltung stammt von Jared Derrett, dessen Name in mehreren Datenbanken den C64- und Spectrum-Fassungen zugeordnet wird. Für Musik und Effekte der C64-Version wird sein Bruder Jay Derrett geführt. Beide tauchen später auch bei weiteren CRL-Horrorprojekten wie Jack the Ripper und Wolfman in den Credits auf. Im Spiel selbst oder in den Handbüchern werden die Derretts nicht immer explizit genannt; ihre Beteiligung lässt sich aber über externe Credit-Sammlungen und Szenequellen nachvollziehen.

Wie reagierte die Presse auf dieses Experiment aus Zensur-Coup und Grusel-Abenteuer? In Großbritannien fielen vor allem die Sinclair-Magazine sehr wohlwollend aus. Crash vergab für die Spectrum-Version eine hohe Gesamtwertung und hob insbesondere Atmosphäre und Textqualität hervor. Sinclair User setzte noch eins drauf und belohnte Dracula mit der Höchstnote von fünf von fünf Punkten. Das frechere Your Sinclair blieb deutlich zurückhaltender: Der zuständige Redakteur lobte die Stimmung, kritisierte aber Umfang und altmodischen Parser und landete bei sechs von zehn Punkten. Auf Commodore-Seite kam das Spiel unterschiedlich an. Commodore User bescheinigte Dracula ein gutes Adventure und lag etwa im 80-Prozent-Bereich, während Computer Gamer sogar eine noch höhere Einschätzung abgab. Computer & Video Games ordnete sich mit einer soliden Acht-von-Zehn-Kategorie ein. Deutlich skeptischer zeigte sich Zzap!64: Dort empfand man das Adventure als zu dünn, um den Hype um die Altersfreigabe zu tragen, und vergab nur eine unterdurchschnittliche Wertung. Besonders störte die Redaktion, dass die angekündigte Schockwirkung in der Praxis eher moderat ausfiel.

In Deutschland fiel das Echo wesentlich kühler aus. Happy Computer zeigte sich in der Besprechung wenig angetan: fehlende deutsche Texte und die zähe Eingabe sorgten für eine deutlich unterdurchschnittliche Wertung und die Empfehlung, nur eingefleischten Adventure-Fans einen Blick zu gönnen. Der Aktuelle Software Markt verfolgte Dracula schon früh; ein Vorabbericht beschäftigte sich vor allem mit der ungewöhnlichen Altersfreigabe und dem Horror-Anspruch. Im eigentlichen Test fielen Grafik und Atmosphäre positiv auf, während der einfache Parser und die lineare Struktur zurückhaltend kommentiert wurden. Insgesamt kam das Spiel im deutschen Markt über einen Nischenstatus nicht hinaus; andere Magazine erwähnten Dracula, wenn überhaupt, eher am Rande.

Mit etwas zeitlichem Abstand bleibt Dracula von 1986 vor allem als Medienphänomen in Erinnerung. CRL nutzte die BBFC-Prüfung geschickt für Schlagzeilen, lange bevor offizielle Altersratings für Spiele zum Standard wurden. Spielerisch reiht sich das Adventure eher in die Kategorie der einfacheren Gruseltitel ein: kein Zork, kein Monkey Island, sondern eine interaktive Horrorgeschichte mit überschaubarem Rätselanteil. Technisch holen die Entwickler aus den drei Zielsystemen ordentlich etwas heraus – der Spectrum profitiert besonders von der starken Textbasis, der C64 punktet mit Musik und Farbe, der CPC liefert eine solide, wenn auch etwas blassere Variante. Der kommerzielle Erfolg blieb moderat, reichte aber aus, um weitere Horror-Adaptionen zu rechtfertigen. Ende der Achtziger verschwand CRL vom Markt, doch Dracula wird in der Retro-Szene heute gerne als kurioser Meilenstein zitiert: als Beispiel dafür, wie weit man mit einer guten Idee, etwas Mut zur Provokation und einem klassischen Stoff kommen konnte, auch wenn die Mechanik im Hintergrund vergleichsweise schlicht bleibt.

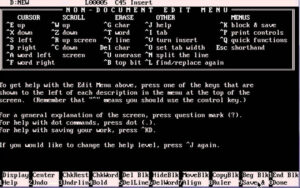

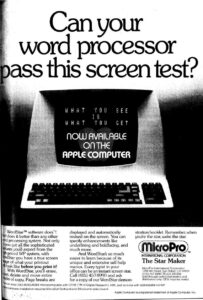

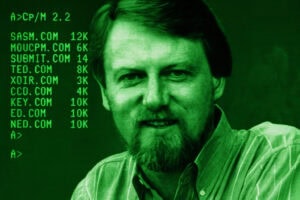

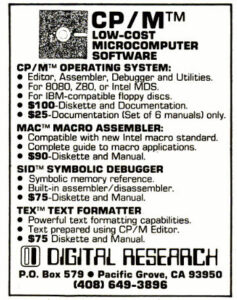

Als Mikrocomputer Ende der siebziger Jahre zunehmend in Werkstätten, Büros und Hobbykellern auftauchten, wuchs der Wunsch nach einer Textverarbeitung, die ernsthafte Schreibarbeit ermöglichen konnte. Seymour I. Rubinstein, vormals bei IMSAI tätig, erkannte diese Lücke und gründete 1978 MicroPro International. Er engagierte den außergewöhnlich begabten Programmierer Rob Barnaby, der bereits zuvor systemnahe Editoren für CP/M entwickelt hatte und in Fachkreisen als jemand galt, der Programme eher aus der Perspektive der Maschine als jener des Anwenders dachte. Zeitgenossen beschrieben ihn als einen Entwickler, der keine Rücksicht auf konventionelle Benutzerführung nahm, sondern darauf vertraute, dass Menschen seine effiziente, aber anspruchsvolle Logik erlernen konnten. Ein Ausspruch, den frühere Kollegen Barnabys überlieferten, bringt dies gut auf den Punkt: „Rob wrote software for the computer, and expected people to keep up“ („Rob schrieb Software für den Computer und erwartete, dass die Menschen mithalten“).

Als Mikrocomputer Ende der siebziger Jahre zunehmend in Werkstätten, Büros und Hobbykellern auftauchten, wuchs der Wunsch nach einer Textverarbeitung, die ernsthafte Schreibarbeit ermöglichen konnte. Seymour I. Rubinstein, vormals bei IMSAI tätig, erkannte diese Lücke und gründete 1978 MicroPro International. Er engagierte den außergewöhnlich begabten Programmierer Rob Barnaby, der bereits zuvor systemnahe Editoren für CP/M entwickelt hatte und in Fachkreisen als jemand galt, der Programme eher aus der Perspektive der Maschine als jener des Anwenders dachte. Zeitgenossen beschrieben ihn als einen Entwickler, der keine Rücksicht auf konventionelle Benutzerführung nahm, sondern darauf vertraute, dass Menschen seine effiziente, aber anspruchsvolle Logik erlernen konnten. Ein Ausspruch, den frühere Kollegen Barnabys überlieferten, bringt dies gut auf den Punkt: „Rob wrote software for the computer, and expected people to keep up“ („Rob schrieb Software für den Computer und erwartete, dass die Menschen mithalten“). Intern verlief die Entwicklung allerdings unruhig. Der rapide wachsende Erfolg erforderte Teamarbeit, doch Barnabys ursprünglicher Quelltext war maschinennah, komplex und nur spärlich dokumentiert. Mehrere Entwickler mussten später Teile des Codes praktisch neu erschließen, als das Programm für MS-DOS und weitere Plattformen angepasst wurde. Trotz dieser Herausforderungen blieb WordStar über Jahre das dominierende Schreibwerkzeug auf CP/M und frühen DOS-Rechnern.

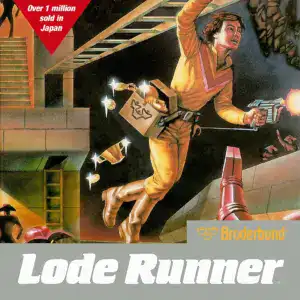

Intern verlief die Entwicklung allerdings unruhig. Der rapide wachsende Erfolg erforderte Teamarbeit, doch Barnabys ursprünglicher Quelltext war maschinennah, komplex und nur spärlich dokumentiert. Mehrere Entwickler mussten später Teile des Codes praktisch neu erschließen, als das Programm für MS-DOS und weitere Plattformen angepasst wurde. Trotz dieser Herausforderungen blieb WordStar über Jahre das dominierende Schreibwerkzeug auf CP/M und frühen DOS-Rechnern. In einer Zeit, als das mobile Internet noch sündhaft teuer mit Dublonen oder der eigenen Seele bezahlt werden musste, war der Mobilfunknutzer auf wenige Möglichkeiten der Unterhaltung während der Busfahrt beschränkt, sofern er nicht immer wieder alte SMS sichten oder aber telefonieren wollte. Nokia hatte mit den Nutzern Mitleid und präsentierte ab 1997 Kurzweil – und diese Kurzweil hieß Snake. Preislich war Snake untrennbar mit dem Kauf eines Nokia-Handys verbunden – es war also faktisch kostenlos. Dass ein monochromes Display mit vier Richtungen und einer stetigen Bewegung der Schlange eine ganze Generation prägen würde, erwartete damals niemand. Doch das Spiel wurde auf über 350 Millionen Geräten ausgeliefert und damit zu einem der populärsten Titel der Welt, gespielt in Pausenhöfen, in U-Bahnen, in überlangen Schulstunden und in stillen Momenten, in denen das Telefon sonst nur Uhrzeit, Akku und die obligatorische SMS-Zahl anzeigte. Doch Nokia hatte das Spiel nicht erfunden.

In einer Zeit, als das mobile Internet noch sündhaft teuer mit Dublonen oder der eigenen Seele bezahlt werden musste, war der Mobilfunknutzer auf wenige Möglichkeiten der Unterhaltung während der Busfahrt beschränkt, sofern er nicht immer wieder alte SMS sichten oder aber telefonieren wollte. Nokia hatte mit den Nutzern Mitleid und präsentierte ab 1997 Kurzweil – und diese Kurzweil hieß Snake. Preislich war Snake untrennbar mit dem Kauf eines Nokia-Handys verbunden – es war also faktisch kostenlos. Dass ein monochromes Display mit vier Richtungen und einer stetigen Bewegung der Schlange eine ganze Generation prägen würde, erwartete damals niemand. Doch das Spiel wurde auf über 350 Millionen Geräten ausgeliefert und damit zu einem der populärsten Titel der Welt, gespielt in Pausenhöfen, in U-Bahnen, in überlangen Schulstunden und in stillen Momenten, in denen das Telefon sonst nur Uhrzeit, Akku und die obligatorische SMS-Zahl anzeigte. Doch Nokia hatte das Spiel nicht erfunden.

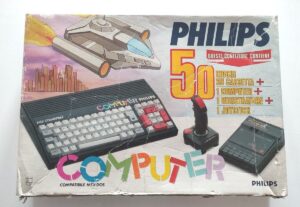

Als der Philips NMS 801 im Jahr 1989 auf dem italienischen Markt erschien, war die große MSX-Ära bereits Geschichte. Die Heimcomputerlandschaft befand sich im Wandel, und Philips versuchte, mit einem ungewöhnlichen Hybridgerät zwischen Konsole und Computer noch einmal Fuß zu fassen. Der NMS 801 war auf den ersten Blick ein vertrautes Mitglied der NMS-Familie – graues Kunststoffgehäuse, MSX-typische Formensprache – doch hinter der Fassade verbarg sich ein System, das nur vorgab, ein MSX zu sein.

Als der Philips NMS 801 im Jahr 1989 auf dem italienischen Markt erschien, war die große MSX-Ära bereits Geschichte. Die Heimcomputerlandschaft befand sich im Wandel, und Philips versuchte, mit einem ungewöhnlichen Hybridgerät zwischen Konsole und Computer noch einmal Fuß zu fassen. Der NMS 801 war auf den ersten Blick ein vertrautes Mitglied der NMS-Familie – graues Kunststoffgehäuse, MSX-typische Formensprache – doch hinter der Fassade verbarg sich ein System, das nur vorgab, ein MSX zu sein.