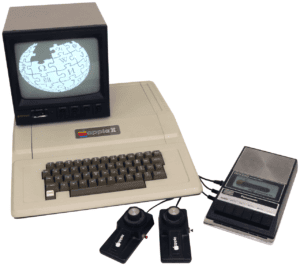

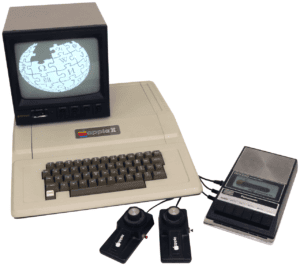

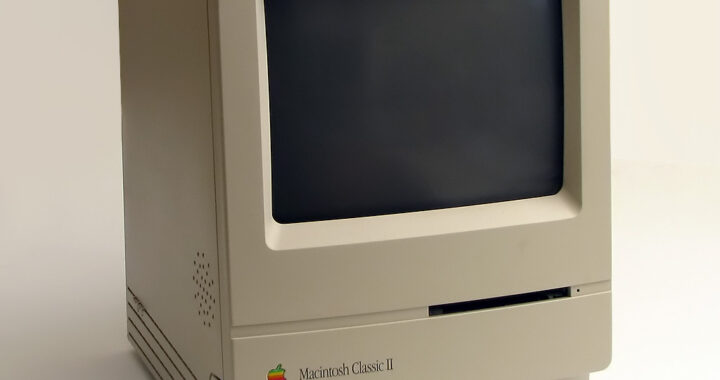

FozzTexx, CC BY-SA 4.0 (Wikimedia Commons)

Ein leises Klicken von Steckkontakten, der Geruch erhitzten Lötzinns, ein Schaltplan, der über Stunden hinweg auf einem Zeichenbrett wächst – doch in diesem Moment ist es mehr als nur Technik. Es ist die Vorstellung eines Computers, der nicht hinter Glasscheiben in Laboren steht, sondern auf einem Schreibtisch, erreichbar, verständlich, unmittelbar. So beginnt die Geschichte des Apple II nicht als Produktidee, sondern als persönliche Obsession. Steve Wozniak war kein Unternehmer im klassischen Sinn, sondern ein Ingenieur, der sich seit seiner Jugend mit dem Entwurf eigener Computersysteme beschäftigte. Während andere Systeme der Mitte der 1970er Jahre aus Schaltern, Leuchtdioden und Frontpanels bestanden, verfolgte er eine andere Vorstellung: ein Rechner, den man direkt bedienen konnte, mit Tastatur, Bildschirm und einer Programmiersprache, die ohne Umwege reagierte.

Der erste greifbare Schritt in diese Richtung war der Apple I, ein handverdrahteter Rechner, den Wozniak im Umfeld des Homebrew Computer Club präsentierte. Dort zeigte sich jedoch schnell, dass das Interesse über die reine Bastlerszene hinausging. Wozniak selbst trat zurückhaltend auf; er brachte seine Geräte mit, stellte sie auf einen Tisch und ließ andere die Fragen stellen. Erst das Feedback von Gleichgesinnten bestätigte ihm, dass seine Ideen auch außerhalb seiner eigenen Werkbank Relevanz hatten. Parallel erkannte Steve Jobs, dass sich aus diesen Konstruktionen ein Geschäft entwickeln ließ. Die oft zitierte Episode um Paul Terrell markiert dabei einen entscheidenden Wendepunkt: Statt einzelner Platinen wollte der Händler vollständig aufgebaute Computer verkaufen.

Doch gerade in diesem Moment zeigte sich auch die Grenze des Apple I. Für Wozniak war er ein Zwischenschritt. Als er begann, mit Farbgrafik zu experimentieren, wurde deutlich, dass sich diese nicht sinnvoll in das bestehende Design integrieren ließ. Die Konsequenz war ein vollständiger Neuentwurf – ein Rechner, dessen Zentrum nicht der Prozessor, sondern die Videoerzeugung war.

Diese Entscheidung prägte den Apple II fundamental. Während konkurrierende Systeme wie der Commodore PET oder der TRS-80 Model I auf Monochromdarstellung setzten, nutzte der Apple II gezielt die Eigenschaften des NTSC-Signals zur Farberzeugung. Das sogenannte Artifact Coloring ermöglichte es, mit minimaler Hardware farbige Darstellung zu erreichen – ein Ansatz, der weniger auf zusätzliche Chips als auf präzises Timing setzte.

Ein Detail, das dabei oft übersehen wird, ist die enge Kopplung zwischen Systemtakt und Videoerzeugung. Der Apple II arbeitete mit einer MOS 6502 CPU, die mit etwa 1,023 MHz getaktet war – genauer gesagt ein Bruchteil der NTSC-Farbträgerfrequenz. Dieser Takt bestimmte nicht nur die Rechengeschwindigkeit, sondern auch die Videogenerierung und sogar Teile des Diskettenzugriffs.

Besonders bemerkenswert ist dabei die Rolle des Grafiksystems selbst. Der Apple II besaß keinen klassischen Grafikchip. Stattdessen war der Grafikgenerator so aufgebaut, dass er gleichzeitig den Refresh des dynamischen RAMs übernahm. Speicher und Bildausgabe waren damit untrennbar miteinander verbunden – eine Konstruktion, die Hardware sparte, aber höchste Präzision erforderte.

Was in der damaligen Außendarstellung oft nur am Rande erwähnt wurde, zeigt sich in technischen Dokumenten deutlich konkreter: Der Apple II war kein einheitlich konfiguriertes System, sondern eine Plattform, deren Leistungsfähigkeit stark von der jeweiligen Bestückung abhing. Bereits frühe Modelle konnten sowohl mit 4 KB als auch mit bis zu 48 KB RAM ausgeliefert werden.

Interessant ist dabei, dass Apple früh zwischen verschiedenen Speicherlösungen wechselte. Dynamischer RAM ermöglichte niedrigere Preise, erforderte jedoch zusätzliche Logik. Die Architektur blieb bewusst offen: Erweiterungsslots erlaubten es, Speicher, Schnittstellen oder Controllerkarten direkt zu integrieren.

Diese Ausrichtung blieb auch der Fachpresse nicht verborgen. BYTE Magazine beschrieb den Apple II als „one of the most complete microcomputer systems available“ („eines der vollständigsten Mikrocomputersysteme, die verfügbar sind“) – eine Einschätzung, die vor allem die ungewöhnliche Kombination aus Bedienbarkeit und Erweiterbarkeit widerspiegelt.

Was diese technische Eleganz im Alltag bedeutete, lässt sich in den Handbüchern der Zeit beinahe greifen. Das System startete ohne Umwege: Einschalten, ein kurzer Ton – und der Rechner ist bereit. „an asterisk (‘’) prompt character … and a flashing white square“ („ein Sternchen (‘’) als Eingabeaufforderung … und ein blinkendes weißes Quadrat“) erscheinen auf dem Bildschirm. Kein Bootmenü, kein Betriebssystem im heutigen Sinne – nur ein Cursor und die Erwartung, dass man etwas damit tut.

Die Tastatur war vollständig integriert, aber bewusst reduziert. Großbuchstaben, direkte Eingabe, unmittelbare Rückmeldung. „The Apple II has a built-in 52-key typewriter-like keyboard…“ („Der Apple II besitzt eine eingebaute, schreibmaschinenähnliche Tastatur mit 52 Tasten…“) beschreibt nüchtern, was in der Praxis ein entscheidender Unterschied war: Der Rechner wartete nicht – er reagierte.

Creative Computing brachte diesen Eindruck auf den Punkt: „Apple has produced a machine that is both powerful and easy to use.“ („Apple hat eine Maschine geschaffen, die sowohl leistungsfähig als auch einfach zu bedienen ist.“)

Auch der Textmodus blieb funktional. 24 Zeilen mit je 40 Zeichen, weiße Schrift auf schwarzem Hintergrund, keine Kleinbuchstaben – eine Einschränkung, die gleichzeitig Klarheit schuf. Erst spätere Modelle erweiterten diesen Bereich.

Die Grafik hingegen war der eigentliche Sprung nach vorn. Neben einfacher Farbdarstellung bot der Apple II hochauflösende Grafik mit 280×192 Pixeln. Die Farben entstanden nicht direkt, sondern durch die Position einzelner Bits im Videosignal. Aus technischer Sicht ein Kompromiss – aus praktischer Sicht ein Durchbruch.

Besonders deutlich wurde die physische Nähe zwischen Mensch und Maschine beim Umgang mit Speichermedien. Der Kassettenbetrieb war hörbar, spürbar, fehleranfällig. „the Apple II needs a signal of about 2 1/2 to 5 volts peak-to-peak“ („der Apple II benötigt ein Signal von etwa 2,5 bis 5 Volt Spitze-zu-Spitze“) – eine technische Angabe, die im Alltag bedeutete: Lautstärke einstellen, Band prüfen, hoffen, dass es funktioniert.

„Tape recorder head alignment is the most common source of tape recorder problems.“ („Die Ausrichtung des Tonbandkopfes ist die häufigste Ursache für Probleme mit Kassettenrekordern.“) – der Computer funktionierte nicht allein, er verlangte Aufmerksamkeit.

Vor diesem Hintergrund wurde das Disk-II-System zu einem Wendepunkt. Es war schneller, zuverlässiger und technisch ungewöhnlich elegant. Während andere Systeme komplexe Controller benötigten, verlagerte Wozniak große Teile der Logik in die Software. Die Kapazität lag bei etwa 143 Kilobyte pro Diskettenseite – ein Wert, der damals deutlich über vielen konkurrierenden Heimlösungen lag.

Die zugehörigen Schaltpläne zeigen eine reduzierte, fast minimalistische Architektur. Kilobaud Microcomputing brachte es treffend auf den Punkt: „a very sophisticated piece of engineering“ („ein sehr ausgeklügeltes Stück Ingenieurskunst“).

Ein Blick auf die Hauptplatine bestätigt diesen Eindruck. Funktionen greifen ineinander, statt getrennt zu sein. CPU, Speicher und Video sind Teil eines gemeinsamen Systems.

Die Erweiterbarkeit war dabei kein Detail, sondern ein Grundprinzip. Acht Steckplätze erlaubten Anpassungen, Erweiterungen, Experimente – gegen den ursprünglichen Widerstand von Jobs.

An dieser Stelle wird auch die Einordnung im Markt greifbar. Gemeinsam mit dem Commodore PET und dem TRS-80 Model I bildet der Apple II die sogenannte „1977 Trinity“.

Doch die Unterschiede waren entscheidend:

Der PET war geschlossen.

Der TRS-80 war günstig und funktional.

Der Apple II war offen.

Diese Offenheit machte ihn zu einer Plattform. Erweiterungskarten wie die Z80 SoftCard ermöglichten sogar den Betrieb von CP/M und damit Zugang zu professioneller Software wie WordStar oder dBASE.

Ein oft unterschätztes Detail ist das Fehlen komfortabler, standardisierter Timer- und Interrupt-Mechanismen im Grundsystem. Zwar konnten Interrupts über Erweiterungskarten realisiert werden, doch im Auslieferungszustand musste vieles exakt berechnet werden. Sound entstand durch präzises Schalten des Lautsprechers, Diskettenzugriffe durch exakt abgestimmte CPU-Zyklen.

Der Apple II war kein komfortables System – er war ein präzises.

Parallel zu dieser technischen und spielerischen Nutzung entwickelte sich jedoch eine Anwendung, die den Apple II in eine völlig neue Kategorie verschob. Mit VisiCalc erschien 1979 ein Programm, das rückblickend häufig als erste echte „Killerapplikation“ des Personal-Computer-Zeitalters bezeichnet wird.

VisiCalc war mehr als nur Software – es war ein Perspektivwechsel. Tabellenkalkulationen, die zuvor auf Papier, mit Taschenrechnern oder auf teuren Großrechnern erstellt wurden, konnten plötzlich direkt auf einem Personal Computer berechnet und verändert werden. Jede Eingabe wirkte sich sofort auf das gesamte Modell aus. Zahlen wurden nicht mehr nur festgehalten – sie wurden beweglich.

Für viele Anwender war dies der erste Moment, in dem ein Computer nicht als Maschine, sondern als Werkzeug erschien. Ein Werkzeug, das Denken beschleunigte. Ein Werkzeug, das Entscheidungen sichtbar machte.

Zeitgenössische Berichte sind in dieser Hinsicht eindeutig: Unternehmen kauften den Apple II nicht wegen seiner Grafikfähigkeiten, nicht wegen seiner Erweiterbarkeit und auch nicht wegen seiner technischen Eleganz – sie kauften ihn wegen VisiCalc. Der Rechner wurde zur Trägerplattform für eine Anwendung.

Damit kehrte sich das Verhältnis von Hardware und Software erstmals spürbar um. Nicht mehr der Computer bestimmte, welche Programme sinnvoll waren – sondern ein Programm bestimmte, welcher Computer gekauft wurde.

In diesem Zusammenhang entstand die bis heute zitierte Einschätzung, VisiCalc sei „the first killer application“ („die erste Killerapplikation“). Doch diese Bezeichnung greift fast zu kurz. VisiCalc war nicht nur ein Verkaufsargument – es war ein Beweis. Ein Beweis dafür, dass Personal Computer wirtschaftlich sinnvoll eingesetzt werden konnten.

Die Auswirkungen waren unmittelbar. Der Apple II fand seinen Weg in Büros, in Buchhaltungen, in Planungsabteilungen. Aufgaben, die zuvor Tage oder Wochen beanspruchten, ließen sich nun innerhalb von Minuten durchspielen. Szenarien konnten verändert, Zahlen angepasst, Konsequenzen sofort sichtbar gemacht werden.

In der Rückschau markiert VisiCalc damit einen Wendepunkt, der über das System selbst hinausgeht. Der Apple II wurde nicht einfach erfolgreicher – er wurde relevant. Oder anders formuliert: Zum ersten Mal wurde ein Computer nicht gekauft, weil man ihn haben wollte, sondern weil man ihn brauchte.

Doch gerade in diesem Moment zeigt sich eine zweite Dimension, die über die unmittelbare Wirkung von VisiCalc hinausgeht. Der Apple II war kein kurzlebiges Produkt einer frühen Experimentierphase, sondern entwickelte sich zu einer der langlebigsten Plattformen der gesamten Mikrocomputerära. Zwischen 1977 und 1993 blieb die Architektur – in verschiedenen Ausprägungen – im Markt präsent.

Der ursprüngliche Einführungspreis lag bei rund 1.298 US-Dollar, während stärker ausgebaute Systeme deutlich darüber lagen. Über die gesamte Baureihe hinweg wurden mehrere Millionen Geräte verkauft.

Noch greifbarer wird diese Entwicklung anhand typischer Systemkonfigurationen. Ein arbeitsfähiger Apple II bestand selten nur aus dem Rechner selbst.

Ein typisches Business-System um 1980 umfasste:

– Apple II / II+

– Diskettenlaufwerk

– VisiCalc (ca. 150 US-Dollar)

Ein solches System bewegte sich im Bereich von etwa 1.800 bis über 2.400 US-Dollar. Mit zunehmender Verbreitung kamen weitere Komponenten hinzu. Textverarbeitungssysteme wurden für rund 129,95 US-Dollar angeboten und erweiterten den Rechner zu einem vielseitigen Arbeitsgerät. Bis Anfang der 1980er Jahre entstand daraus ein vollständiger Arbeitsplatz mit Software, Erweiterungen und Peripherie – oft mit Gesamtpreisen von mehreren tausend US-Dollar. In Europa, insbesondere in Deutschland, verstärkten Importkosten diesen Effekt zusätzlich. Apple-II-Systeme kosteten häufig mehrere tausend D-Mark und wurden eher als Investition denn als Konsumprodukt wahrgenommen. Im Vergleich dazu stand der Commodore 64 für den Heimgebrauch, während der IBM PC sich im professionellen Umfeld etablierte. Der Apple II bewegte sich zwischen diesen Welten.

Doch bevor der Apple II zu einem Werkzeug wurde, war er bereits etwas anderes – ein Experimentierfeld. Ein Ort, an dem sich nicht nur Programme, sondern Ideen entwickeln konnten. In dieser Umgebung entstand etwas, das sich erst Jahre später vollständig greifen ließ: Der Apple II wurde zur Geburtsstätte ganzer Spielgenres. Ein besonders prägnantes Beispiel ist die Entstehung von Sierra On-Line. Ken Williams und Roberta Williams entwickelten mit Mystery House das erste Grafik-Adventure. Parallel dazu entstand mit Akalabeth: World of Doom ein früher Vertreter des Rollenspielgenres. Mit zunehmender Reife des Systems folgten Titel wie Wizardry, Lode Runner oder Karateka. Auch Castle Wolfenstein und The Oregon Trail erweiterten das Spektrum. Zeitgenössische Magazine beobachteten diese Entwicklung genau. In der ersten Ausgabe von Softline wird offen beschrieben, dass Computer in der Praxis vor allem für Spiele genutzt wurden – und dass gerade diese Programme entscheidend zur Weiterentwicklung von Benutzerfreundlichkeit und Grafik beitrugen. Spiele waren damit nicht nur Unterhaltung, sondern ein Experimentierfeld für neue Ideen.

Der Apple II bot dafür ideale Bedingungen. Direkter Zugriff auf Speicher, flexible Grafik und eine offene Architektur ermöglichten es Entwicklern, die Grenzen des Systems auszureizen.

Der Rechner bot keine Abstraktion – er verlangte Verständnis. Der Apple II war kein fertiges Produkt im heutigen Sinn. Er war ein Angebot. Ein System, das den Benutzer nicht abschirmte, sondern einbezog. Ein Computer, den man nicht nur benutzte, sondern verstand. Oder, wie Apple es selbst formulierte: „the first personal computer you’ll actually enjoy using.“ („der erste Personal Computer, den man tatsächlich gern benutzt.“)

Und vielleicht liegt genau darin sein eigentlicher Wendepunkt: Nicht darin, was er konnte – sondern darin, dass er es dem Benutzer zutraute, es herauszufinden.

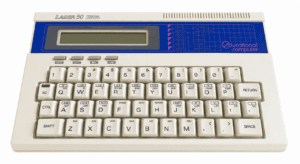

Es ist Mitte der 1980er Jahre, und während Systeme wie der Commodore 64 oder der ZX Spectrum den heimischen Schreibtisch erobern, verfolgt ein Hersteller aus Hongkong einen anderen Ansatz: Computer sollen nicht nur zu Hause stehen, sondern überallhin mitgenommen werden können – und vor allem eines tun: Programmieren lehren. In genau diesem Spannungsfeld entsteht der Video Technology Laser 50, ein Gerät, das sich selbstbewusst als „BASIC learning tool that teaches you BASIC“ bezeichnete.

Es ist Mitte der 1980er Jahre, und während Systeme wie der Commodore 64 oder der ZX Spectrum den heimischen Schreibtisch erobern, verfolgt ein Hersteller aus Hongkong einen anderen Ansatz: Computer sollen nicht nur zu Hause stehen, sondern überallhin mitgenommen werden können – und vor allem eines tun: Programmieren lehren. In genau diesem Spannungsfeld entsteht der Video Technology Laser 50, ein Gerät, das sich selbstbewusst als „BASIC learning tool that teaches you BASIC“ bezeichnete.

Der TRS-80 Model II erschien zu einem Zeitpunkt, als sich der Computermarkt bereits in zwei klar unterscheidbare Richtungen entwickelte. Systeme wie der

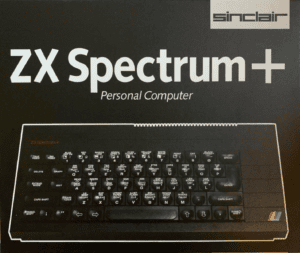

Der TRS-80 Model II erschien zu einem Zeitpunkt, als sich der Computermarkt bereits in zwei klar unterscheidbare Richtungen entwickelte. Systeme wie der  Als der Sinclair ZX Spectrum+ im Oktober 1984 erschien, war die eigentliche Sensation längst geschehen. Der ursprüngliche

Als der Sinclair ZX Spectrum+ im Oktober 1984 erschien, war die eigentliche Sensation längst geschehen. Der ursprüngliche

Als Mitte der 1980er-Jahre in westlichen Kinderzimmern bereits hitzig darüber diskutiert wurde, ob nun der

Als Mitte der 1980er-Jahre in westlichen Kinderzimmern bereits hitzig darüber diskutiert wurde, ob nun der

Als NEC Anfang der 1980er Jahre mit dem

Als NEC Anfang der 1980er Jahre mit dem