Franklin ACE 100

Wenn ich Dich, werter Leser, fragen würde, ob Du irgendwann einmal in Deinem Leben ein Programm ohne Zustimmung des Urhebers kopiert hast, würdest Du wahrscheinlich mit einem verlegenen Lächeln zustimmen, denn höchstwahrscheinlich hast Du die Zeit miterlebt und möglicherweise dank Programmen wie bspw. X-Copy auf dem Amiga ausgiebig davon Gebrauch gemacht (Nur zur Beruhigung: die Verjährungsfrist ist hier schon längst vorbei). Das nicht nur der private Heimanwender sich das Leben etwas vereinfachen wollte, ist daraus sicherlich erklärlich und beruhte auch auf der Tatsache, dass es noch bis Anfang der 1980er keine wirklichen Präzedenzfälle existierten. Dies sah auch der US-amerikanische Hersteller Franklin Computer Corporation so und präsentierte 1982 die ACE Modellreihe, die absolut Apple II kompatibel waren.

Wenn ich Dich, werter Leser, fragen würde, ob Du irgendwann einmal in Deinem Leben ein Programm ohne Zustimmung des Urhebers kopiert hast, würdest Du wahrscheinlich mit einem verlegenen Lächeln zustimmen, denn höchstwahrscheinlich hast Du die Zeit miterlebt und möglicherweise dank Programmen wie bspw. X-Copy auf dem Amiga ausgiebig davon Gebrauch gemacht (Nur zur Beruhigung: die Verjährungsfrist ist hier schon längst vorbei). Das nicht nur der private Heimanwender sich das Leben etwas vereinfachen wollte, ist daraus sicherlich erklärlich und beruhte auch auf der Tatsache, dass es noch bis Anfang der 1980er keine wirklichen Präzedenzfälle existierten. Dies sah auch der US-amerikanische Hersteller Franklin Computer Corporation so und präsentierte 1982 die ACE Modellreihe, die absolut Apple II kompatibel waren.

Technisch gesehen war der ACE 100 keine Nachbildung, sondern eine exakte Kopie des Apple II Plus: Franklin hatte den ROM-Inhalt von Apples System, inklusive BASIC-Interpreter, Monitorprogramm und Betriebssystem, Byte für Byte übernommen. Dies führte später zum wegweisenden Rechtsstreit Apple Computer, Inc. v. Franklin Computer Corp., der die Rechtsauffassung über Software-Urheberrecht nachhaltig prägte. Im Inneren arbeitete wie beim Original ein MOS Technology 6502 mit 1,023 MHz. Der 8-Bit-Prozessor war der zentrale Baustein zahlreicher Heimcomputer der Zeit, von der Atari-8-Bit-Serie bis zum Commodore 64. Er konnte direkt auf bis zu 64 KB RAM zugreifen, was dem ACE 100 voll zur Verfügung stand.

Die Grafikfunktionen entsprachen exakt dem Apple II Plus: Textmodus mit 40×24 Zeichen, Low-Resolution-Grafik mit 40×48 Bildpunkten bei 15 Farben plus schwarz, High-Res mit 280×192 bei bis zu sechs gleichzeitigen Farben, abhängig von den NTSC-Farbphasen. Für Ton sorgte wie beim Original ein 1-Bit-Speaker, der über Software getaktet wurde – komplexe Musik war nur durch gezieltes Pulsweitenmodulieren möglich.

Das ROM des ACE 100 enthielt eine 1:1-Kopie von Apples Integer BASIC (entwickelt von Steve Wozniak) sowie Apples Betriebssystem DOS 3.3. Der Computer unterstützte alle Apple-II-Platinen und Softwaretitel, da er vollständig signal- und softwarekompatibel war. Die Anschlussmöglichkeiten umfassten Composite-Video, Gameport, einen Erweiterungsbus mit acht Slots sowie Diskettenanschluss. Als Massenspeicher kamen externe 5,25-Zoll-Diskettenlaufwerke zum Einsatz – meist 140 KB pro Diskette –, häufig Apple-kompatible Nachbauten von Franklin selbst.

Ursprünglich wurde der ACE 100 als sogenannte „Bare Board“-Lösung vertrieben – ein vollständig bestücktes Mainboard ohne Gehäuse, Tastatur oder Netzteil. Zielgruppe waren technisch versierte Nutzer, Schulen und OEM-Kunden, die den Rechner in bestehende Apple-II-kompatible Gehäuse oder selbstgefertigte Lösungen einbauen wollten. Dennoch kam es im Handel bald zu Verwirrungen: Einige Dritthändler und Systemhäuser verkauften den ACE 100 auch als Komplettgerät, indem sie das Board mit Gehäuse, Tastatur und Netzteil kombinierten. Diese Varianten wurden teils noch unter dem Namen ACE 100 angeboten, obwohl der erste offiziell von Franklin vermarktete Komplettrechner auf Basis desselben Boards bereits ACE 1000 hieß.

Der Preis des ACE 100 als Mainboard lag bei rund 499 US-Dollar, was inflationsbereinigt ca. 1.475 Euro im Jahr 2025 entspricht – deutlich günstiger als der Apple II Plus mit etwa 1.195 Dollar (über 3.400 Euro heute). Diese Preisstrategie machte den ACE 100 besonders bei Bildungseinrichtungen beliebt. Presseberichte zur Veröffentlichung waren gespalten. Während Magazine wie Creative Computing das Gerät als „kostengünstigen Hoffnungsträger für Bildungseinrichtungen“ bezeichneten, schrieb BYTE Magazine im Oktober 1982: „Ein guter Computer, doch moralisch fragwürdiger Ursprung.“ Besonders Apple-Fans sahen in Franklin einen Trittbrettfahrer.

Etwa 20.000 Einheiten wurden laut interner Verkaufszahlen von Franklin bis Anfang 1983 ausgeliefert. Ein Lehrer aus Kalifornien baute mit Schülern Plexiglas-Gehäuse um ACE-Boards – ein Schulprojekt, das zum halblegalen Apple-Klonlabor wurde. „Ich hätte Apple lieber gekauft, aber mein Budget erlaubte das nicht. Der Franklin tat, was ich brauchte – Punkt“, sagte er rückblickend in einem Interview mit Popular Computing.

Apple war selbstredend kein allzu großer Freund der ACE Reihe und klagte bereits zur Veröffentlichung auf Urheberrechtsverletzung. Der Rechtsstreit Apple v. Franklin war ein historisches Verfahren in den USA, das maßgeblich die Rechtsgrundlage für den Schutz von Software festlegte. Franklin argumentierte, dass ROM-Code keine „literarischen Werke“ im Sinne des Urheberrechts seien und deshalb nicht geschützt werden könnten. Die Entscheidung des Berufungsgerichts (3rd Circuit) im Jahr 1983 war bahnbrechend: Das Gericht erklärte, dass auch Maschinencode in ROMs urheberrechtlich schützbar ist, selbst wenn dieser nicht direkt lesbar ist. Dies war das erste Mal, dass ein US-Gericht urheberrechtlichen Schutz für firmwarebasierte Software bestätigte.

Das Verfahren zog sich bis 1988 hin. Franklin verlor in allen wesentlichen Punkten. Die Firma musste den Vertrieb der betroffenen Produkte einstellen oder neu designen, was ihren Marktanteil stark schrumpfen ließ. Franklin bot später den ACE 500 mit neuem ROM und eigener Softwarearchitektur an – jedoch ohne die vollständige Kompatibilität, die den ACE 100 so erfolgreich gemacht hatte. Gegenüber direkten Konkurrenten wie dem Commodore PET oder dem Tandy TRS-80 war der Franklin ACE 100 grafisch unterlegen, aber durch seine Apple-Kompatibilität deutlich vielseitiger. Für Bastler war er eine kostengünstige Alternative – für Apple ein Dorn im Auge.

Der ACE 100 war also mehr als nur ein Plagiat. Er war ein politischer Computer, ein juristisches Exempel, ein Spiegel der frühen 80er-Jahre zwischen Innovation, Nachbau und der Suche nach Standards. Heute ist er ein Sammlerstück – gerade weil er als einziger Computer in US-Geschichte vor Gericht tatsächlich als urheberrechtswidrig verboten wurde, obwohl er technisch brillant umgesetzt war.

Wings of Fury, von Brøderbund im Dezember 1987 veröffentlicht, war ein ungewöhnlicher, stilisierter Mix aus Shoot-'em-up und Simulation, der sich in der Ästhetik eher an Spielhallenklassiker anlehnte, inhaltlich jedoch überraschend ernst war. Entwickelt wurde das Spiel ursprünglich von Steve Waldo, einem der weniger bekannten, aber technisch versierten Designer, der zuvor an Tools und internen Konvertern für Brøderbund mitgearbeitet hatte. Die Musik und Sounds wurden von Kris Hatlelid beigesteuert, wobei die PC-Version mangels Sound-Hardware auf einfache Effekt-Cues beschränkt blieb. Die Amiga- und Apple-II-Versionen nutzten einfache Sampleeffekte und systemnahe Töne, boten aber keine musikalische Untermalung im eigentlichen Sinne.

Wings of Fury, von Brøderbund im Dezember 1987 veröffentlicht, war ein ungewöhnlicher, stilisierter Mix aus Shoot-'em-up und Simulation, der sich in der Ästhetik eher an Spielhallenklassiker anlehnte, inhaltlich jedoch überraschend ernst war. Entwickelt wurde das Spiel ursprünglich von Steve Waldo, einem der weniger bekannten, aber technisch versierten Designer, der zuvor an Tools und internen Konvertern für Brøderbund mitgearbeitet hatte. Die Musik und Sounds wurden von Kris Hatlelid beigesteuert, wobei die PC-Version mangels Sound-Hardware auf einfache Effekt-Cues beschränkt blieb. Die Amiga- und Apple-II-Versionen nutzten einfache Sampleeffekte und systemnahe Töne, boten aber keine musikalische Untermalung im eigentlichen Sinne.

Im Jahr 1989 veröffentlichte GrandSlam Entertainments das Actionspiel The Running Man, eine Adaption des gleichnamigen Films mit Arnold Schwarzenegger aus dem Jahr 1987, der seinerseits lose auf Stephen Kings dystopischem Roman unter dem Pseudonym Richard Bachman basierte. Die Umsetzung war typisch für die späten 1980er, als britische Publisher eilig Lizenzprodukte zu Blockbustern auf den Markt brachten. Entwickelt wurde das Spiel von der irischen Softwareschmiede Emerald Software. Das Kernteam bestand unter anderem aus den Programmierern John Gibson und Jim Baguley, zwei Veteranen der Szene, die zuvor bei Imagine Software und Ocean aktiv waren. Die Musik komponierte Jonathan Dunn, bekannt durch Titel wie Platoon, RoboCop und das musikalisch überraschend gefühlvolle Pictionary.

Im Jahr 1989 veröffentlichte GrandSlam Entertainments das Actionspiel The Running Man, eine Adaption des gleichnamigen Films mit Arnold Schwarzenegger aus dem Jahr 1987, der seinerseits lose auf Stephen Kings dystopischem Roman unter dem Pseudonym Richard Bachman basierte. Die Umsetzung war typisch für die späten 1980er, als britische Publisher eilig Lizenzprodukte zu Blockbustern auf den Markt brachten. Entwickelt wurde das Spiel von der irischen Softwareschmiede Emerald Software. Das Kernteam bestand unter anderem aus den Programmierern John Gibson und Jim Baguley, zwei Veteranen der Szene, die zuvor bei Imagine Software und Ocean aktiv waren. Die Musik komponierte Jonathan Dunn, bekannt durch Titel wie Platoon, RoboCop und das musikalisch überraschend gefühlvolle Pictionary.

Der Archimedes A7000 war einer der letzten klassischen Computer von Acorn Computers Ltd., jener traditionsreichen britischen Firma, die sich bereits in den 1980er Jahren mit ihren innovativen BBC-Mikrocomputern und der Einführung des RISC-Konzepts als Pionier auf dem Heimcomputermarkt etablierte. Der A7000 wurde im Juli 1995 vorgestellt und markierte den Versuch, ein erschwingliches und zugleich leistungsfähiges Modell für den Bildungsbereich und ambitionierte Heimnutzer anzubieten, das die Tugenden seiner Vorgänger mit moderneren Bauteilen verband. Während der A7000 äußerlich kompakter wirkte, verbarg sich unter seinem schlichten grauen Kunststoffgehäuse ein System, das auf RISC OS 3.6 lief und in vielerlei Hinsicht den Brückenschlag zwischen der alten Archimedes-Reihe und den späteren RiscPCs darstellte.

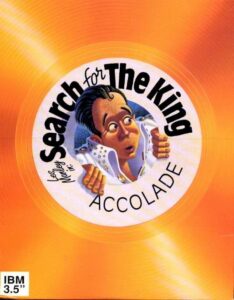

Der Archimedes A7000 war einer der letzten klassischen Computer von Acorn Computers Ltd., jener traditionsreichen britischen Firma, die sich bereits in den 1980er Jahren mit ihren innovativen BBC-Mikrocomputern und der Einführung des RISC-Konzepts als Pionier auf dem Heimcomputermarkt etablierte. Der A7000 wurde im Juli 1995 vorgestellt und markierte den Versuch, ein erschwingliches und zugleich leistungsfähiges Modell für den Bildungsbereich und ambitionierte Heimnutzer anzubieten, das die Tugenden seiner Vorgänger mit moderneren Bauteilen verband. Während der A7000 äußerlich kompakter wirkte, verbarg sich unter seinem schlichten grauen Kunststoffgehäuse ein System, das auf RISC OS 3.6 lief und in vielerlei Hinsicht den Brückenschlag zwischen der alten Archimedes-Reihe und den späteren RiscPCs darstellte. Das unter dem Label Accolade entwickelte Adventure "Les Manley in: Search for the King" erschien 1990 für MS-DOS und Amiga und markierte den Einstieg der lockeren, erwachsenen Spielreihe rund um dena tollpatschigen Videotechniker Les Manley, der magenkribbelnd auf der Suche nach Elvis („The King“) quer durch Amerika reist. Designer Steve Cartwright, der zuvor bekannt war für Actiontitel wie Ice Hockey und Seaquest von Atari, bekam bei Accolade ab 1988 endlich freie Hand, ein vollwertiges Sierra ähnliches Adventuresystem zu entwickeln. Zusammen mit Michael Berlyn (Infocom Veteran, verantwortlich für Suspended und Infidel) entwarf er den Adventure Programming Engine, der handgepixelte Charakteranimationen über gemalte Hintergründe legte und mit 1.500 Parser Kommandos ausgestattet war. In einem frühen Interview schwärmte Cartwright: „Ich wollte ein Text-Adventure mit Grafik erschaffen – den ultimativen Parser, der auch Humor transportiert“. Die künstlerische Federführung lag bei Justin Chin (später Art Director bei Star Wars: Dark Forces) und Bonnie Borucki (Animation bei Leisure Suit Larry II). Weitere Crewmitglieder waren Grafikprogrammierer wie Russell Shiffer (Score für Test Drive II/III).

Das unter dem Label Accolade entwickelte Adventure "Les Manley in: Search for the King" erschien 1990 für MS-DOS und Amiga und markierte den Einstieg der lockeren, erwachsenen Spielreihe rund um dena tollpatschigen Videotechniker Les Manley, der magenkribbelnd auf der Suche nach Elvis („The King“) quer durch Amerika reist. Designer Steve Cartwright, der zuvor bekannt war für Actiontitel wie Ice Hockey und Seaquest von Atari, bekam bei Accolade ab 1988 endlich freie Hand, ein vollwertiges Sierra ähnliches Adventuresystem zu entwickeln. Zusammen mit Michael Berlyn (Infocom Veteran, verantwortlich für Suspended und Infidel) entwarf er den Adventure Programming Engine, der handgepixelte Charakteranimationen über gemalte Hintergründe legte und mit 1.500 Parser Kommandos ausgestattet war. In einem frühen Interview schwärmte Cartwright: „Ich wollte ein Text-Adventure mit Grafik erschaffen – den ultimativen Parser, der auch Humor transportiert“. Die künstlerische Federführung lag bei Justin Chin (später Art Director bei Star Wars: Dark Forces) und Bonnie Borucki (Animation bei Leisure Suit Larry II). Weitere Crewmitglieder waren Grafikprogrammierer wie Russell Shiffer (Score für Test Drive II/III). Der Thrustmaster Flight Control System (FCS) Mark I erschien 1992 als hochwertiger PC-Joystick im F‑16-Phantom-Stil und gilt als erste echte Flight-Yoke-Steuerung für Flugsimulatoren am PC. Entwickelt unter der Leitung von Norm Winningstad – einem Mitgründer von Thrustmaster im Jahr 1990 in Oregon – vereinte das FCS robuste Materialien und realistische Technik: Ein einseitiger Haltegriff mit Fingerschlaufen, getragen von massivem Kunststoffboden mit schwerer Metalplatte, vermittelte das Gefühl eines echten Kampfjets. Ein zeitgenössischer Test befand sogar, das FCS sei „wahrscheinlich der authentischste Joystick, der für Computer erhältlich ist“. Der Stick verfügte über drei Achsen (Quer-, Hoch- und Drehachse) sowie vier Feuertasten, die computergestützt per Keyboard-Interface ausgegeben wurden.

Der Thrustmaster Flight Control System (FCS) Mark I erschien 1992 als hochwertiger PC-Joystick im F‑16-Phantom-Stil und gilt als erste echte Flight-Yoke-Steuerung für Flugsimulatoren am PC. Entwickelt unter der Leitung von Norm Winningstad – einem Mitgründer von Thrustmaster im Jahr 1990 in Oregon – vereinte das FCS robuste Materialien und realistische Technik: Ein einseitiger Haltegriff mit Fingerschlaufen, getragen von massivem Kunststoffboden mit schwerer Metalplatte, vermittelte das Gefühl eines echten Kampfjets. Ein zeitgenössischer Test befand sogar, das FCS sei „wahrscheinlich der authentischste Joystick, der für Computer erhältlich ist“. Der Stick verfügte über drei Achsen (Quer-, Hoch- und Drehachse) sowie vier Feuertasten, die computergestützt per Keyboard-Interface ausgegeben wurden. Als zweiter Bestandteil des Thrustmaster-HOTAS-Konzepts ergänzte ab 1992 das Weapons Control System (WCS) den FCS. Dabei handelte es sich um einen seitlichen Schubhebel mit sechs Tasten und einem 3‑Positionen-Schalter im Layout eines Kampfflugzeugs. Der Gashebel besaß reale Rastpositionen (Vollgas und Nachbrenner): Man schob ihn zur ersten Blockade für Volllast und darüber hinaus für Nachbrennerbetrieb. Seine Tasten und Kippschalter übermittelten je nach Flugprogramm Funktionen wie Kontermittel, Waffenwechsel, Luftbremse oder Klappen. Technisch war das WCS ein reines Tastaturgerät: Es steckte zwischen PC und Tastatur und emulierte alle Steuerbefehle als Tastaturcodes. Diese Bauweise machte Treiber überflüssig (das System lief unter DOS/Windows einfach auf dem Keyboard-Port), hatte aber Nachteile: Die Gasstellung wurde durch mehrere Tastendrücke dargestellt, nicht durch ein kontinuierliches Signal. Vergleichstests bemängelten, der WCS sei „nicht so reaktionsschnell wie die analoge Trimmung“ etwa des CH-FlightStick. Zudem war pro Spiel ein Satz DIP-Schalter am WCS zu setzen, um die korrekten Befehle zu wählen, und bei Bedarf musste ein Austausch des ROM-Chips erfolgen, um neue Spiele zu unterstützen.

Als zweiter Bestandteil des Thrustmaster-HOTAS-Konzepts ergänzte ab 1992 das Weapons Control System (WCS) den FCS. Dabei handelte es sich um einen seitlichen Schubhebel mit sechs Tasten und einem 3‑Positionen-Schalter im Layout eines Kampfflugzeugs. Der Gashebel besaß reale Rastpositionen (Vollgas und Nachbrenner): Man schob ihn zur ersten Blockade für Volllast und darüber hinaus für Nachbrennerbetrieb. Seine Tasten und Kippschalter übermittelten je nach Flugprogramm Funktionen wie Kontermittel, Waffenwechsel, Luftbremse oder Klappen. Technisch war das WCS ein reines Tastaturgerät: Es steckte zwischen PC und Tastatur und emulierte alle Steuerbefehle als Tastaturcodes. Diese Bauweise machte Treiber überflüssig (das System lief unter DOS/Windows einfach auf dem Keyboard-Port), hatte aber Nachteile: Die Gasstellung wurde durch mehrere Tastendrücke dargestellt, nicht durch ein kontinuierliches Signal. Vergleichstests bemängelten, der WCS sei „nicht so reaktionsschnell wie die analoge Trimmung“ etwa des CH-FlightStick. Zudem war pro Spiel ein Satz DIP-Schalter am WCS zu setzen, um die korrekten Befehle zu wählen, und bei Bedarf musste ein Austausch des ROM-Chips erfolgen, um neue Spiele zu unterstützen. Thrustmaster bot neben FCS und WCS 1992 auch ein Ruderpedalsystem (Rudder Control System, RCS) an, das über den Spielport die Pedale und Haupteinheit verband. Später erschienen verbesserte Versionen: 1993 kam das programmierbare Pro Flight Control System (FCS Mark II) mit optimierten Komponenten, 1994 das luxuriöse F-16 FLCS mit Metallbau und Komplettprogrammierung, und 1997 folgte der WCS II mit analogem Gas und Software-Unterstützung. Zusätzlich wurden über die Jahre „Elite“-Ruderpedale und Multi-Port-Adapter angeboten, um mehrere Thrustmaster-Geräte gleichzeitig zu betreiben.

Thrustmaster bot neben FCS und WCS 1992 auch ein Ruderpedalsystem (Rudder Control System, RCS) an, das über den Spielport die Pedale und Haupteinheit verband. Später erschienen verbesserte Versionen: 1993 kam das programmierbare Pro Flight Control System (FCS Mark II) mit optimierten Komponenten, 1994 das luxuriöse F-16 FLCS mit Metallbau und Komplettprogrammierung, und 1997 folgte der WCS II mit analogem Gas und Software-Unterstützung. Zusätzlich wurden über die Jahre „Elite“-Ruderpedale und Multi-Port-Adapter angeboten, um mehrere Thrustmaster-Geräte gleichzeitig zu betreiben. Der Yashica YC 64 wurde 1984 von Kyocera unter der Marke Yashica als MSX 1 Heimcomputer auf den europäischen Markt gebracht und erschien Ende 1985 offiziell auch in Frankreich . Sein Gehäuse in ungewöhnlichem Rotbraun stach sofort ins Auge – eine bewusst jugendfreundliche Designentscheidung, die ihn von anderen MSX Geräten abhob. Der Preis lag bei etwa 950 DM (rund 798 DM laut MSX Wiki für Deutschland). Umgerechnet und inflationsbereinigt entspräche das heute etwa 400–450 €, was ihn als gehobene Mittelklasse positionierte. Der MSX-Standard versprach einheitliche Kompatibilität, einen großen Softwarepool und internationale Anschlussfähigkeit – ein attraktives Feld für Firmen, die bislang mit Computern wenig zu tun hatten. In Deutschland stellte das Magazin Happy Computer fest : „Wer ›nur‹ ein MSX Gerät ohne Schnörkel und mit viel Speicher sucht, ist mit dem YC 64 ausreichend bedient“

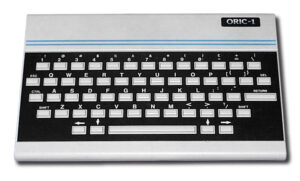

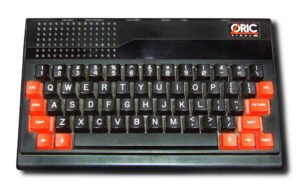

Der Yashica YC 64 wurde 1984 von Kyocera unter der Marke Yashica als MSX 1 Heimcomputer auf den europäischen Markt gebracht und erschien Ende 1985 offiziell auch in Frankreich . Sein Gehäuse in ungewöhnlichem Rotbraun stach sofort ins Auge – eine bewusst jugendfreundliche Designentscheidung, die ihn von anderen MSX Geräten abhob. Der Preis lag bei etwa 950 DM (rund 798 DM laut MSX Wiki für Deutschland). Umgerechnet und inflationsbereinigt entspräche das heute etwa 400–450 €, was ihn als gehobene Mittelklasse positionierte. Der MSX-Standard versprach einheitliche Kompatibilität, einen großen Softwarepool und internationale Anschlussfähigkeit – ein attraktives Feld für Firmen, die bislang mit Computern wenig zu tun hatten. In Deutschland stellte das Magazin Happy Computer fest : „Wer ›nur‹ ein MSX Gerät ohne Schnörkel und mit viel Speicher sucht, ist mit dem YC 64 ausreichend bedient“ In den frühen 1980er Jahren startete das britische Unternehmen Tangerine Computer Systems einen weiteren Vorstoß in den Heimbereich: Im Frühjahr 1982 gründeten die Erfinder Dr. Paul Johnson und Barry Muncaster die Tochterfirma Oric Products International Ltd (OPI), um einen ZX-Spectrum-Konkurrenten zu entwickeln. Finanziell unterstützt wurde das Unterfangen maßgeblich durch den Gebrauchtwagenhändler British Car Auctions (BCA) um den Firmenchef John Tullis, der auch selbst als Managing Director von OPI eintrat. Am 27. Januar 1983 lud OPI zur offiziellen Markteinführung des neuen Heimcomputers Oric-1 ein. Im noblen Ambiente von Coworth Park, dem Sitz des Unternehmens, prahlte Vertriebsleiter Peter Harding mit Großaufträgen: Man habe bereits Lieferverträge für über 200.000 Geräte und wolle „Clive Sinclair schlagen, indem wir für viel weniger Geld sehr viel mehr bieten“. Der Oric-1 kam in zwei Speichervarianten auf den Markt – 16 KB RAM für £129 und 48 KB für £169,95 – und übertraf preislich selbst das Sinclair ZX Spectrum-Angebot nur um Haaresbreite. Entwickler Paul Kaufman formulierte damals selbstbewusst: „Der Oric ist ein Konkurrent zum Spectrum… Wir sind überzeugt, dass er eine bessere Maschine ist“.

In den frühen 1980er Jahren startete das britische Unternehmen Tangerine Computer Systems einen weiteren Vorstoß in den Heimbereich: Im Frühjahr 1982 gründeten die Erfinder Dr. Paul Johnson und Barry Muncaster die Tochterfirma Oric Products International Ltd (OPI), um einen ZX-Spectrum-Konkurrenten zu entwickeln. Finanziell unterstützt wurde das Unterfangen maßgeblich durch den Gebrauchtwagenhändler British Car Auctions (BCA) um den Firmenchef John Tullis, der auch selbst als Managing Director von OPI eintrat. Am 27. Januar 1983 lud OPI zur offiziellen Markteinführung des neuen Heimcomputers Oric-1 ein. Im noblen Ambiente von Coworth Park, dem Sitz des Unternehmens, prahlte Vertriebsleiter Peter Harding mit Großaufträgen: Man habe bereits Lieferverträge für über 200.000 Geräte und wolle „Clive Sinclair schlagen, indem wir für viel weniger Geld sehr viel mehr bieten“. Der Oric-1 kam in zwei Speichervarianten auf den Markt – 16 KB RAM für £129 und 48 KB für £169,95 – und übertraf preislich selbst das Sinclair ZX Spectrum-Angebot nur um Haaresbreite. Entwickler Paul Kaufman formulierte damals selbstbewusst: „Der Oric ist ein Konkurrent zum Spectrum… Wir sind überzeugt, dass er eine bessere Maschine ist“. Tatsächlich gelang dem Oric-1 ein spektakulärer Marktstart. 1983 verkaufte OPI etwa 160.000 Stück in Großbritannien – und weitere 50.000 in Frankreich, wo das Gerät zeitweise sogar das meistverkaufte Computersystem des Jahres war. Ein glücklicher Zufall kam hinzu: Der eingebaute RGB-Monitoranschluss erwies sich für Frankreich nützlich, da er das einfache Scart-Kabel für das dort übliche SECAM-Fernsehen ermöglichte. Fachpresse und Kunden lobten das Gerät weitgehend: So stellte Your-Computer-Redakteur Meirion Jones fest, dass der Oric-1 „mit dem Bewusstsein konstruiert wurde, dass Computer 1983 immer mehr für praktische Zwecke eingesetzt werden“ und hob etwa den Centronics-Druckerport hervor. Er schrieb: „Das Gerät lässt sich dadurch leicht mit Druckern und anderen Peripheriegeräten verbinden. Oric wird bald ein Modem auf den Markt bringen, damit Prestel verfügbar ist“. Schon mit dem ersten Modell zeichnete sich ab, dass OPI Business- und Heimanwender zugleich ansprechen wollte. Eine Rezension in Popular Computing Weekly wies darauf hin, dass Oric viel Werbeplatz „den Vorteilen der Maschine für den Business-Benutzer widmet. Sie betonen die Verfügbarkeit eines Modems und versprechen (ohne Termin) Microdrive-Disketten und einen Schnellprinter“. Tatsächlich lag ein Oric-1 oft neben der Gebrauchsanweisung ein kleines „Tansoft“-Magazin bei, und der Oric wurde als moderner Allrounder gepriesen.

Tatsächlich gelang dem Oric-1 ein spektakulärer Marktstart. 1983 verkaufte OPI etwa 160.000 Stück in Großbritannien – und weitere 50.000 in Frankreich, wo das Gerät zeitweise sogar das meistverkaufte Computersystem des Jahres war. Ein glücklicher Zufall kam hinzu: Der eingebaute RGB-Monitoranschluss erwies sich für Frankreich nützlich, da er das einfache Scart-Kabel für das dort übliche SECAM-Fernsehen ermöglichte. Fachpresse und Kunden lobten das Gerät weitgehend: So stellte Your-Computer-Redakteur Meirion Jones fest, dass der Oric-1 „mit dem Bewusstsein konstruiert wurde, dass Computer 1983 immer mehr für praktische Zwecke eingesetzt werden“ und hob etwa den Centronics-Druckerport hervor. Er schrieb: „Das Gerät lässt sich dadurch leicht mit Druckern und anderen Peripheriegeräten verbinden. Oric wird bald ein Modem auf den Markt bringen, damit Prestel verfügbar ist“. Schon mit dem ersten Modell zeichnete sich ab, dass OPI Business- und Heimanwender zugleich ansprechen wollte. Eine Rezension in Popular Computing Weekly wies darauf hin, dass Oric viel Werbeplatz „den Vorteilen der Maschine für den Business-Benutzer widmet. Sie betonen die Verfügbarkeit eines Modems und versprechen (ohne Termin) Microdrive-Disketten und einen Schnellprinter“. Tatsächlich lag ein Oric-1 oft neben der Gebrauchsanweisung ein kleines „Tansoft“-Magazin bei, und der Oric wurde als moderner Allrounder gepriesen. Die Atmos erwies sich technisch als behutsam verbessertes Modell: Sie bot ein neues Gehäuse mit eleganterem Tastatur-Layout und aktualisierte System-ROM-Version 1.1, löschte damit viele der ältesten Fehler des Oric-1, blieb aber im Kern ein Oric-1 der vierten Revision. Auf der Which-Computer-Show (1/1984) in Birmingham präsentierte OPI einen Prototyp eines 3-Zoll-Diskettenlaufwerks und das neue Atmos-Gehäuse, das zum gleichen Preis von £170 angeboten wurde. Doch in der Produktpresse kam die Atmos recht nüchtern an. Der Your-Computer-Redakteur Bryan Skinner bemängelte: „Ich sehe nicht, wie man die Atmos ein neues Produkt nennen kann“ (Your Computer, 3/1984) – angesichts der weitgehenden Funktionsgleichheit mit dem Vorgänger blieb das Publikum eher skeptisch.

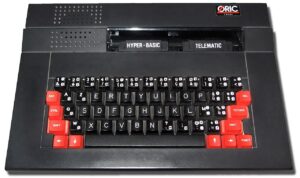

Die Atmos erwies sich technisch als behutsam verbessertes Modell: Sie bot ein neues Gehäuse mit eleganterem Tastatur-Layout und aktualisierte System-ROM-Version 1.1, löschte damit viele der ältesten Fehler des Oric-1, blieb aber im Kern ein Oric-1 der vierten Revision. Auf der Which-Computer-Show (1/1984) in Birmingham präsentierte OPI einen Prototyp eines 3-Zoll-Diskettenlaufwerks und das neue Atmos-Gehäuse, das zum gleichen Preis von £170 angeboten wurde. Doch in der Produktpresse kam die Atmos recht nüchtern an. Der Your-Computer-Redakteur Bryan Skinner bemängelte: „Ich sehe nicht, wie man die Atmos ein neues Produkt nennen kann“ (Your Computer, 3/1984) – angesichts der weitgehenden Funktionsgleichheit mit dem Vorgänger blieb das Publikum eher skeptisch. Als einziger Bieter trat nun Eureka Informatique hervor: Die französische Firma übernahm OPI mit allen Rechten, nannte sich in „Oric Products International“ um und setzte die Entwicklung fort. Eureka brachte 1986 zunächst die Stratos in Serie, die in der Werbung als Oric Stratos oder IQ164 geführt wurde – ein technisch aufgemöbelter Atmos-Klon mit zusätzlichen ROM-Cartridge-Slots. Kurz darauf erschien noch 1986 der Oric Telestrat, eine Art weiterentwickelte Variante mit eingebautem Gehäuse-Modem und neuen Bauteilen. Trotz namhafter Zusatzsoftware reichte es nur zu wenigen Tausend Verkäufen. Gerade einmal etwa 6.000 Telestrat-Geräte fanden noch Käufer, bevor Eureka 1987 bankrottging. Ein geplanter Nachfolger Telestrat II, beworben 1987, kam nie heraus. Im Dezember 1987 musste auch das französische Unternehmen Konkurs anmelden, womit das Kapitel „Oric Computer“ endgültig endete.

Als einziger Bieter trat nun Eureka Informatique hervor: Die französische Firma übernahm OPI mit allen Rechten, nannte sich in „Oric Products International“ um und setzte die Entwicklung fort. Eureka brachte 1986 zunächst die Stratos in Serie, die in der Werbung als Oric Stratos oder IQ164 geführt wurde – ein technisch aufgemöbelter Atmos-Klon mit zusätzlichen ROM-Cartridge-Slots. Kurz darauf erschien noch 1986 der Oric Telestrat, eine Art weiterentwickelte Variante mit eingebautem Gehäuse-Modem und neuen Bauteilen. Trotz namhafter Zusatzsoftware reichte es nur zu wenigen Tausend Verkäufen. Gerade einmal etwa 6.000 Telestrat-Geräte fanden noch Käufer, bevor Eureka 1987 bankrottging. Ein geplanter Nachfolger Telestrat II, beworben 1987, kam nie heraus. Im Dezember 1987 musste auch das französische Unternehmen Konkurs anmelden, womit das Kapitel „Oric Computer“ endgültig endete.