Spindizzy Worlds – 1990 by Arsys Software, Inc.

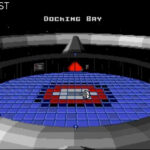

Spindizzy Worlds ist eines dieser Spiele, das auf den ersten Blick aussieht wie ein schrulliger Physikbaukasten mit Schwerkraftproblemen, aber unter der Haube eine kleine Design-Offenbarung verbirgt. Entwickelt wurde es von Paul Shirley, dem Schöpfer des ursprünglichen Spindizzy aus dem Jahr 1986, das sich seinerzeit durch seine schwindelerregende isometrische Perspektive und ein kreiselndes Vehikel namens GERALD einen Platz in der Heimcomputer-Geschichte sicherte. Der Nachfolger, Spindizzy Worlds, erschien zuerst 1990 auf dem Amiga und dem Atari ST und wurde später auf diverse andere Plattformen wie SNES, Sharp X68000, NEC PC-9801 und sogar das Super Famicom portiert – Letzteres allerdings ohne Zustimmung Shirleys, was zu einem der kurioseren Kapitel der Spielegeschichte führte.

Spindizzy Worlds ist eines dieser Spiele, das auf den ersten Blick aussieht wie ein schrulliger Physikbaukasten mit Schwerkraftproblemen, aber unter der Haube eine kleine Design-Offenbarung verbirgt. Entwickelt wurde es von Paul Shirley, dem Schöpfer des ursprünglichen Spindizzy aus dem Jahr 1986, das sich seinerzeit durch seine schwindelerregende isometrische Perspektive und ein kreiselndes Vehikel namens GERALD einen Platz in der Heimcomputer-Geschichte sicherte. Der Nachfolger, Spindizzy Worlds, erschien zuerst 1990 auf dem Amiga und dem Atari ST und wurde später auf diverse andere Plattformen wie SNES, Sharp X68000, NEC PC-9801 und sogar das Super Famicom portiert – Letzteres allerdings ohne Zustimmung Shirleys, was zu einem der kurioseren Kapitel der Spielegeschichte führte.

Die Handlung? Man spielt wieder das GERALD-Gerät, ein Geographical Environmental Reconnaissance And Land-Mapping Device, das durch ein Sternensystem namens Beta Twirlinus rollt, um Energie zu sammeln, bevor die Sonne alles auslöscht. Keine Sorge, so episch wie es klingt, bleibt es in der Praxis meist bei schwebenden Plattformen, tückischen Abgründen und dem unbarmherzigen Ticken einer ablaufenden Energieleiste. Der Spieler erkundet dabei Dutzende kleiner Planeten mit sehr individuellen Mechaniken – manche drehen sich, andere kippen oder werfen den armen GERALD mit katapultartigen Plattformen durch die Gegend. Die Weltkarte gliedert sich in zwei Sektoren: Easydizzy und Spindizzy – ein schöner Hinweis darauf, was einem in der zweiten Hälfte blüht.

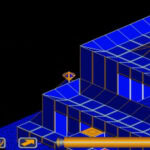

Das Spielprinzip hat sich gegenüber dem Vorgänger verändert. Während Spindizzy eine zusammenhängende, gigantische Welt bot, in der man sich verlieren konnte wie in einem IKEA ohne Ausgang, setzt Spindizzy Worlds auf abgeschlossene Levelstrukturen. Diese sind dennoch fies verschachtelt und verlangen gutes räumliches Denken. Besonders die Steuerung von GERALD, der sich wie ein gut geschmierter Hockey-Puck auf Eis verhält, sorgt für die eine oder andere spontane Tischkante im Kieferbereich. Dafür bietet das Spiel auch ein paar neue Annehmlichkeiten, wie Speicherstände oder Hinweise innerhalb der Level – ein Novum, das im gnadenlosen Vorgänger noch völlig fehlte. Außerdem kann man nun die Kameraperspektive frei in 90°-Schritten drehen, was bei der Orientierung oft lebenswichtig ist, auch wenn man dabei gelegentlich den Überblick verliert und plötzlich rückwärts in einen Abgrund rollt.

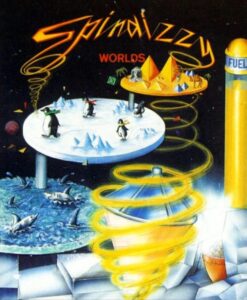

Programmiert wurde Spindizzy Worlds erneut von Paul Shirley, der von Debbie Sorrell grafisch unterstützt wurde. Die Musik stammt von Martin Walker, bekannt für seine C64-Tracks in Armalyte oder Speedball 2: Brutal Deluxe. In einer witzigen Fußnote ließ Produzent Colin Fuidge im Abspann die Frage stellen: „Can GERALD have a gun?“ – was wohl eine Reaktion auf das völlig gewaltfreie Gameplay war, das so gar nicht in die damalige Actionära passen wollte. Das ikonische Boxart entstand durch einen Wettbewerb in einem britischen Computermagazin und zeigt GERALD, umgeben von thematischen Welten mit Pinguinen, Pyramiden und U-Booten. Warum Pinguine? Warum nicht.

Der SNES-Port sorgte dann für ordentlich Zwist. Shirley hatte keine Freigabe erteilt und distanzierte sich später explizit von dieser Version. Seine Reaktion fiel entsprechend deutlich aus: „I disown it.“ Die SNES-Version wurde von ASCII Entertainment umgesetzt, und etwa 80.000 Module wurden laut späteren Aussagen produziert. Wie viele davon tatsächlich über die Ladentheke gingen, bleibt unklar. Fakt ist: Durch die ausbleibende Vermarktung wurde das Spiel nie der Hit, der es hätte werden können. Besonders ärgerlich für Shirley: Schon beim ersten Spindizzy hatte Activision eine US-Version für den Apple II veröffentlicht – komplett ohne seine Kenntnis und sogar mit entfernten Credits.

Die internationale Presse zeigte sich dennoch meist begeistert. In Großbritannien heimste die Amiga-Version bis zu 94 % ein, während auch die Power Play mit 86 % nicht geizte. Die SNES-Version wurde gemischt aufgenommen: Während Nintendo Magazine System 90 % vergab, bemängelten US-Magazine wie Nintendo Power die träge Steuerung auf dem Gamepad. Dennoch schaffte es Spindizzy Worlds auf Platz 90 der besten 100 SNES-Spiele in einer späteren Total!-Liste – ein Achtungserfolg für ein Spiel, das nie große Stückzahlen erreichte.

Die Levelarchitektur ist bis heute bemerkenswert: Mit cleverem Design, physikalischen Fallen, versteckten Gängen und einem Mix aus Geschicklichkeit und Denkspiel forderte das Spiel seine Spieler auf mehreren Ebenen. Energie ist stets Mangelware, und jedes verlorene Leben kratzt an der Zeitreserve. Die späteren Level sind dabei sadistisch genug, um selbst geduldige Spieler zur Verzweiflung zu treiben – und gleichzeitig motivierend genug, um einen weitermachen zu lassen.

Was bleibt, ist ein faszinierendes Beispiel für ein Indie-ähnliches Projekt lange vor dem Indie-Boom. Ein Spiel, das mit bescheidenen Mitteln, viel Kreativität und ein bisschen britischem Humor eine Nische im Puzzle-Genre schuf, die bis heute viele Fans begeistert. Die letzten Worte überlassen wir Paul Shirley selbst, der auf die Frage, was er am Spieldesign von Spindizzy Worlds ändern würde, nur antwortete: „Nothing. I got it right the first time.“

Spindizzy Worlds ist eines dieser Spiele, das auf den ersten Blick aussieht wie ein schrulliger Physikbaukasten mit Schwerkraftproblemen, aber unter der Haube eine kleine Design-Offenbarung verbirgt. Entwickelt wurde es von Paul Shirley, dem Schöpfer des ursprünglichen Spindizzy aus dem Jahr 1986, das sich seinerzeit durch seine schwindelerregende isometrische Perspektive und ein kreiselndes Vehikel namens GERALD einen Platz in der Heimcomputer-Geschichte sicherte. Der Nachfolger, Spindizzy Worlds, erschien zuerst 1990 auf dem Amiga und dem Atari ST und wurde später auf diverse andere Plattformen wie SNES, Sharp X68000, NEC PC-9801 und sogar das Super Famicom portiert – Letzteres allerdings ohne Zustimmung Shirleys, was zu einem der kurioseren Kapitel der Spielegeschichte führte.

Die Handlung? Man spielt wieder das GERALD-Gerät, ein Geographical Environmental Reconnaissance And Land-Mapping Device, das durch ein Sternensystem namens Beta Twirlinus rollt, um Energie zu sammeln, bevor die Sonne alles auslöscht. Keine Sorge, so episch wie es klingt, bleibt es in der Praxis meist bei schwebenden Plattformen, tückischen Abgründen und dem unbarmherzigen Ticken einer ablaufenden Energieleiste. Der Spieler erkundet dabei Dutzende kleiner Planeten mit sehr individuellen Mechaniken – manche drehen sich, andere kippen oder werfen den armen GERALD mit katapultartigen Plattformen durch die Gegend. Die Weltkarte gliedert sich in zwei Sektoren: Easydizzy und Spindizzy – ein schöner Hinweis darauf, was einem in der zweiten Hälfte blüht.

Das Spielprinzip hat sich gegenüber dem Vorgänger verändert. Während Spindizzy eine zusammenhängende, gigantische Welt bot, in der man sich verlieren konnte wie in einem IKEA ohne Ausgang, setzt Spindizzy Worlds auf abgeschlossene Levelstrukturen. Diese sind dennoch fies verschachtelt und verlangen gutes räumliches Denken. Besonders die Steuerung von GERALD, der sich wie ein gut geschmierter Hockey-Puck auf Eis verhält, sorgt für die eine oder andere spontane Tischkante im Kieferbereich. Dafür bietet das Spiel auch ein paar neue Annehmlichkeiten, wie Speicherstände oder Hinweise innerhalb der Level – ein Novum, das im gnadenlosen Vorgänger noch völlig fehlte. Außerdem kann man nun die Kameraperspektive frei in 90°-Schritten drehen, was bei der Orientierung oft lebenswichtig ist, auch wenn man dabei gelegentlich den Überblick verliert und plötzlich rückwärts in einen Abgrund rollt.

Programmiert wurde Spindizzy Worlds erneut von Paul Shirley, der von Debbie Sorrell grafisch unterstützt wurde. Die Musik stammt von Martin Walker, bekannt für seine C64-Tracks in Armalyte oder Speedball 2: Brutal Deluxe. In einer witzigen Fußnote ließ Produzent Colin Fuidge im Abspann die Frage stellen: „Can GERALD have a gun?“ – was wohl eine Reaktion auf das völlig gewaltfreie Gameplay war, das so gar nicht in die damalige Actionära passen wollte. Das ikonische Boxart entstand durch einen Wettbewerb in einem britischen Computermagazin und zeigt GERALD, umgeben von thematischen Welten mit Pinguinen, Pyramiden und U-Booten. Warum Pinguine? Warum nicht.

Der SNES-Port sorgte dann für ordentlich Zwist. Shirley hatte keine Freigabe erteilt und distanzierte sich später explizit von dieser Version. Seine Reaktion fiel entsprechend deutlich aus: „I disown it.“ Die SNES-Version wurde von ASCII Entertainment umgesetzt, und etwa 80.000 Module wurden laut späteren Aussagen produziert. Wie viele davon tatsächlich über die Ladentheke gingen, bleibt unklar. Fakt ist: Durch die ausbleibende Vermarktung wurde das Spiel nie der Hit, der es hätte werden können. Besonders ärgerlich für Shirley: Schon beim ersten Spindizzy hatte Activision eine US-Version für den Apple II veröffentlicht – komplett ohne seine Kenntnis und sogar mit entfernten Credits.

Die internationale Presse zeigte sich dennoch meist begeistert. In Großbritannien heimste die Amiga-Version bis zu 94 % ein, während auch die Power Play mit 86 % nicht geizte. Die SNES-Version wurde gemischt aufgenommen: Während Nintendo Magazine System 90 % vergab, bemängelten US-Magazine wie Nintendo Power die träge Steuerung auf dem Gamepad. Dennoch schaffte es Spindizzy Worlds auf Platz 90 der besten 100 SNES-Spiele in einer späteren Total!-Liste – ein Achtungserfolg für ein Spiel, das nie große Stückzahlen erreichte.

Die Levelarchitektur ist bis heute bemerkenswert: Mit cleverem Design, physikalischen Fallen, versteckten Gängen und einem Mix aus Geschicklichkeit und Denkspiel forderte das Spiel seine Spieler auf mehreren Ebenen. Energie ist stets Mangelware, und jedes verlorene Leben kratzt an der Zeitreserve. Die späteren Level sind dabei sadistisch genug, um selbst geduldige Spieler zur Verzweiflung zu treiben – und gleichzeitig motivierend genug, um einen weitermachen zu lassen.

Was bleibt, ist ein faszinierendes Beispiel für ein Indie-ähnliches Projekt lange vor dem Indie-Boom. Ein Spiel, das mit bescheidenen Mitteln, viel Kreativität und ein bisschen britischem Humor eine Nische im Puzzle-Genre schuf, die bis heute viele Fans begeistert. Die letzten Worte überlassen wir Paul Shirley selbst, der auf die Frage, was er am Spieldesign von Spindizzy Worlds ändern würde, nur antwortete: „Nothing. I got it right the first time.“

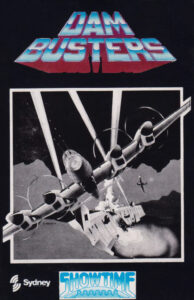

Es ist egal, in welchem Jahrzehnt der Videospiele wir uns befinden, der zweite Weltkrieg ist immer wieder eine Anlaufstelle für Actionspiele oder Simulatoren. The Spiel The Dam Busters (1984) ist ein weiteres Beispiel für britisch-kanadische Zusammenarbeit im frühen Flugsimulations-Genre: ein mutiger Versuch, Geschichte, Technik und Spielgefühl zu verknüpfen. Hinter diesem ambitionierten Titel steckte die kanadische Firma Sydney Development Corp., realisiert in enger Kooperation mit U.S. Gold (Europa) und Accolade (Nordamerika) für verschiedenste Plattformen.

Es ist egal, in welchem Jahrzehnt der Videospiele wir uns befinden, der zweite Weltkrieg ist immer wieder eine Anlaufstelle für Actionspiele oder Simulatoren. The Spiel The Dam Busters (1984) ist ein weiteres Beispiel für britisch-kanadische Zusammenarbeit im frühen Flugsimulations-Genre: ein mutiger Versuch, Geschichte, Technik und Spielgefühl zu verknüpfen. Hinter diesem ambitionierten Titel steckte die kanadische Firma Sydney Development Corp., realisiert in enger Kooperation mit U.S. Gold (Europa) und Accolade (Nordamerika) für verschiedenste Plattformen.

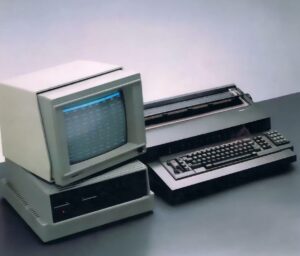

Wenn man sich in den 1980er Jahren in einem europäischen Anwaltsbüro, einer Behörde oder einem Verlag umsah, dann begegnete man nicht selten einem Gerät mit Olivetti-Schriftzug, dezent grauem Gehäuse und dem markanten Surren eines daisy-wheel-Druckkopfs. Der Olivetti ETS 1010 war eines dieser Geräte – weder vollwertiger PC noch bloße elektrische Schreibmaschine, sondern etwas dazwischen: ein eigenständiges elektronisches Textsystem mit Bildschirm, Speichermedien und intelligentem Software-Unterbau.

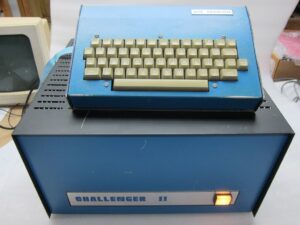

Wenn man sich in den 1980er Jahren in einem europäischen Anwaltsbüro, einer Behörde oder einem Verlag umsah, dann begegnete man nicht selten einem Gerät mit Olivetti-Schriftzug, dezent grauem Gehäuse und dem markanten Surren eines daisy-wheel-Druckkopfs. Der Olivetti ETS 1010 war eines dieser Geräte – weder vollwertiger PC noch bloße elektrische Schreibmaschine, sondern etwas dazwischen: ein eigenständiges elektronisches Textsystem mit Bildschirm, Speichermedien und intelligentem Software-Unterbau. Der Ohio Scientific Challenger II, meist kurz C2 genannt, erschien zwischen 1977 und 1979 als konsequente Weiterentwicklung der populären Superboard-Serie des US-amerikanischen Herstellers Ohio Scientific Instruments (OSI). Das Unternehmen, gegründet 1975 im Bundesstaat Ohio durch den Ingenieur Michael Cheiky, seine Frau Charity Cheiky sowie den Techniker Dale A. Dreisbach, hatte sich zum Ziel gesetzt, erschwingliche, aber leistungsfähige Mikrocomputersysteme mit professionellem Anspruch zu entwickeln – eine Philosophie, die sich im C2 deutlich widerspiegelt.

Der Ohio Scientific Challenger II, meist kurz C2 genannt, erschien zwischen 1977 und 1979 als konsequente Weiterentwicklung der populären Superboard-Serie des US-amerikanischen Herstellers Ohio Scientific Instruments (OSI). Das Unternehmen, gegründet 1975 im Bundesstaat Ohio durch den Ingenieur Michael Cheiky, seine Frau Charity Cheiky sowie den Techniker Dale A. Dreisbach, hatte sich zum Ziel gesetzt, erschwingliche, aber leistungsfähige Mikrocomputersysteme mit professionellem Anspruch zu entwickeln – eine Philosophie, die sich im C2 deutlich widerspiegelt.

Wenn ich Dich, werter Leser, fragen würde, ob Du irgendwann einmal in Deinem Leben ein Programm ohne Zustimmung des Urhebers kopiert hast, würdest Du wahrscheinlich mit einem verlegenen Lächeln zustimmen, denn höchstwahrscheinlich hast Du die Zeit miterlebt und möglicherweise dank Programmen wie bspw. X-Copy auf dem Amiga ausgiebig davon Gebrauch gemacht (Nur zur Beruhigung: die Verjährungsfrist ist hier schon längst vorbei). Das nicht nur der private Heimanwender sich das Leben etwas vereinfachen wollte, ist daraus sicherlich erklärlich und beruhte auch auf der Tatsache, dass es noch bis Anfang der 1980er keine wirklichen Präzedenzfälle existierten. Dies sah auch der US-amerikanische Hersteller Franklin Computer Corporation so und präsentierte 1982 die ACE Modellreihe, die absolut Apple II kompatibel waren.

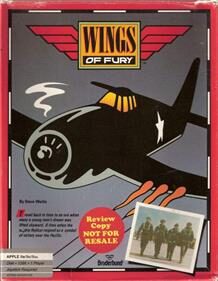

Wenn ich Dich, werter Leser, fragen würde, ob Du irgendwann einmal in Deinem Leben ein Programm ohne Zustimmung des Urhebers kopiert hast, würdest Du wahrscheinlich mit einem verlegenen Lächeln zustimmen, denn höchstwahrscheinlich hast Du die Zeit miterlebt und möglicherweise dank Programmen wie bspw. X-Copy auf dem Amiga ausgiebig davon Gebrauch gemacht (Nur zur Beruhigung: die Verjährungsfrist ist hier schon längst vorbei). Das nicht nur der private Heimanwender sich das Leben etwas vereinfachen wollte, ist daraus sicherlich erklärlich und beruhte auch auf der Tatsache, dass es noch bis Anfang der 1980er keine wirklichen Präzedenzfälle existierten. Dies sah auch der US-amerikanische Hersteller Franklin Computer Corporation so und präsentierte 1982 die ACE Modellreihe, die absolut Apple II kompatibel waren. Wings of Fury, von Brøderbund im Dezember 1987 veröffentlicht, war ein ungewöhnlicher, stilisierter Mix aus Shoot-'em-up und Simulation, der sich in der Ästhetik eher an Spielhallenklassiker anlehnte, inhaltlich jedoch überraschend ernst war. Entwickelt wurde das Spiel ursprünglich von Steve Waldo, einem der weniger bekannten, aber technisch versierten Designer, der zuvor an Tools und internen Konvertern für Brøderbund mitgearbeitet hatte. Die Musik und Sounds wurden von Kris Hatlelid beigesteuert, wobei die PC-Version mangels Sound-Hardware auf einfache Effekt-Cues beschränkt blieb. Die Amiga- und Apple-II-Versionen nutzten einfache Sampleeffekte und systemnahe Töne, boten aber keine musikalische Untermalung im eigentlichen Sinne.

Wings of Fury, von Brøderbund im Dezember 1987 veröffentlicht, war ein ungewöhnlicher, stilisierter Mix aus Shoot-'em-up und Simulation, der sich in der Ästhetik eher an Spielhallenklassiker anlehnte, inhaltlich jedoch überraschend ernst war. Entwickelt wurde das Spiel ursprünglich von Steve Waldo, einem der weniger bekannten, aber technisch versierten Designer, der zuvor an Tools und internen Konvertern für Brøderbund mitgearbeitet hatte. Die Musik und Sounds wurden von Kris Hatlelid beigesteuert, wobei die PC-Version mangels Sound-Hardware auf einfache Effekt-Cues beschränkt blieb. Die Amiga- und Apple-II-Versionen nutzten einfache Sampleeffekte und systemnahe Töne, boten aber keine musikalische Untermalung im eigentlichen Sinne.

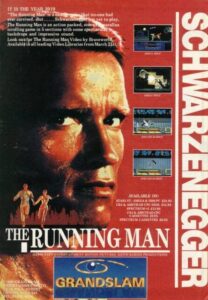

Im Jahr 1989 veröffentlichte GrandSlam Entertainments das Actionspiel The Running Man, eine Adaption des gleichnamigen Films mit Arnold Schwarzenegger aus dem Jahr 1987, der seinerseits lose auf Stephen Kings dystopischem Roman unter dem Pseudonym Richard Bachman basierte. Die Umsetzung war typisch für die späten 1980er, als britische Publisher eilig Lizenzprodukte zu Blockbustern auf den Markt brachten. Entwickelt wurde das Spiel von der irischen Softwareschmiede Emerald Software. Das Kernteam bestand unter anderem aus den Programmierern John Gibson und Jim Baguley, zwei Veteranen der Szene, die zuvor bei Imagine Software und Ocean aktiv waren. Die Musik komponierte Jonathan Dunn, bekannt durch Titel wie Platoon, RoboCop und das musikalisch überraschend gefühlvolle Pictionary.

Im Jahr 1989 veröffentlichte GrandSlam Entertainments das Actionspiel The Running Man, eine Adaption des gleichnamigen Films mit Arnold Schwarzenegger aus dem Jahr 1987, der seinerseits lose auf Stephen Kings dystopischem Roman unter dem Pseudonym Richard Bachman basierte. Die Umsetzung war typisch für die späten 1980er, als britische Publisher eilig Lizenzprodukte zu Blockbustern auf den Markt brachten. Entwickelt wurde das Spiel von der irischen Softwareschmiede Emerald Software. Das Kernteam bestand unter anderem aus den Programmierern John Gibson und Jim Baguley, zwei Veteranen der Szene, die zuvor bei Imagine Software und Ocean aktiv waren. Die Musik komponierte Jonathan Dunn, bekannt durch Titel wie Platoon, RoboCop und das musikalisch überraschend gefühlvolle Pictionary.

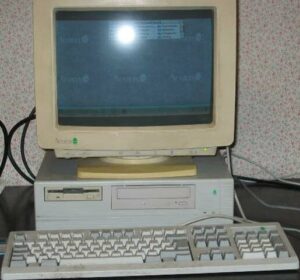

Der Archimedes A7000 war einer der letzten klassischen Computer von Acorn Computers Ltd., jener traditionsreichen britischen Firma, die sich bereits in den 1980er Jahren mit ihren innovativen BBC-Mikrocomputern und der Einführung des RISC-Konzepts als Pionier auf dem Heimcomputermarkt etablierte. Der A7000 wurde im Juli 1995 vorgestellt und markierte den Versuch, ein erschwingliches und zugleich leistungsfähiges Modell für den Bildungsbereich und ambitionierte Heimnutzer anzubieten, das die Tugenden seiner Vorgänger mit moderneren Bauteilen verband. Während der A7000 äußerlich kompakter wirkte, verbarg sich unter seinem schlichten grauen Kunststoffgehäuse ein System, das auf RISC OS 3.6 lief und in vielerlei Hinsicht den Brückenschlag zwischen der alten Archimedes-Reihe und den späteren RiscPCs darstellte.

Der Archimedes A7000 war einer der letzten klassischen Computer von Acorn Computers Ltd., jener traditionsreichen britischen Firma, die sich bereits in den 1980er Jahren mit ihren innovativen BBC-Mikrocomputern und der Einführung des RISC-Konzepts als Pionier auf dem Heimcomputermarkt etablierte. Der A7000 wurde im Juli 1995 vorgestellt und markierte den Versuch, ein erschwingliches und zugleich leistungsfähiges Modell für den Bildungsbereich und ambitionierte Heimnutzer anzubieten, das die Tugenden seiner Vorgänger mit moderneren Bauteilen verband. Während der A7000 äußerlich kompakter wirkte, verbarg sich unter seinem schlichten grauen Kunststoffgehäuse ein System, das auf RISC OS 3.6 lief und in vielerlei Hinsicht den Brückenschlag zwischen der alten Archimedes-Reihe und den späteren RiscPCs darstellte.