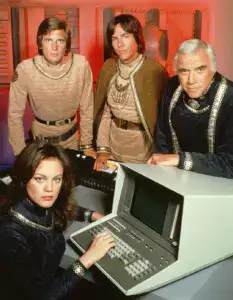

Kein Requisiten-Fake, sondern echte Labortechnik: Systeme der Tektronix-4050-Reihe dienten in den späten 1970ern häufig als glaubwürdige „Zukunftscomputer“ in Film- und Fernsehproduktionen.

Manchmal verrät ein Fernsehbild mehr über die technische Gegenwart seiner Entstehungszeit als über die Zukunft, die es darstellen soll. Als 1978 die Zuschauer erstmals die Kommandozentrale der Battlestar Galactica sahen, stand dort kein futuristischer Fantasierechner, sondern ein real existierendes wissenschaftliches Instrument aus Oregon: ein System der Tektronix-4050-Serie. In einer Zeit, in der Mikrocomputer meist als Bausätze, Terminals oder experimentelle Systeme auftraten, verkörperten diese Geräte eine andere Tradition – die des Laborrechners, der aus der Messtechnik kam und die Brücke zwischen Oszilloskop, Grafikterminal und programmierbarem Rechner schlug.

Tektronix hatte den 4051 nicht als Heimcomputer entwickelt, sondern als wissenschaftliches Werkzeug. Wie es im Service-Handbuch formuliert wird, vereinte das System „die visuelle Darstellung eines Grafikterminals mit der Rechenleistung eines wissenschaftlichen programmierbaren Rechners“ und konnte sowohl eigenständig arbeiten als auch als intelligentes Grafikterminal dienen.

Im Inneren arbeitete ein Motorola-6800-Acht-Bit-Mikroprozessor, der Mitte der siebziger Jahre zu den frühen Standardprozessoren für Mikrocomputersysteme und industrielle Steuertechnik gehörte. Im Tektronix-Rechner übernahm er die Ausführung des BASIC-Interpreters, die Steuerung der Grafiklogik sowie die Kommunikation mit angeschlossenen Geräten. Der Standardausbau umfasste acht Kilobyte Arbeitsspeicher, von denen etwa sechs Kilobyte dem Anwender zur Verfügung standen. Durch optionale Erweiterungen ließ sich der Speicher auf bis zu 32 Kilobyte ausbauen, was für einen Desktop-Rechner dieser Zeit ein beachtlicher Wert war.

Die Firmware befand sich in einem umfangreichen ROM-System mit mehreren Dutzend Kilobyte Kapazität und enthielt neben dem Interpreter eine erweiterte BASIC-Variante. Diese unterstützte numerische Berechnungen ebenso wie Grafikbefehle, Matrizenoperationen, String-Verarbeitung und die Steuerung externer Geräte. Erweiterungs-ROMs konnten über Steckmodule eingebunden werden, wodurch sich der Rechner funktional an unterschiedliche Aufgaben anpassen ließ – ein Konzept, das stärker an wissenschaftliche Instrumente als an spätere Heimcomputer erinnerte.

Als Massenspeicher diente ein integriertes Magnetband-Cartridge-System mit einer Kapazität von rund 300 Kilobyte. Die Daten wurden sequenziell gespeichert, was zwar langsamer als spätere Diskettenlösungen war, jedoch als robust und zuverlässig galt. Für Labore, in denen Messdaten archiviert werden mussten, entsprach dies den praktischen Anforderungen der Zeit.

Der vielleicht markanteste Unterschied zu späteren Personal Computern lag im Bildschirm. Der 4051 verwendete keine rasterbasierte Videodarstellung, sondern eine sogenannte Direct-View-Storage-Tube-Röhre. Ein einmal gezeichneter Vektor blieb sichtbar, ohne ständig neu aufgebaut werden zu müssen. Linien wurden direkt geschrieben und blieben stabil stehen, bis der Bildschirm gelöscht wurde. Dadurch entstand eine außergewöhnlich ruhige und flimmerfreie Darstellung technischer Grafiken, Diagramme und Messkurven. Für wissenschaftliche Visualisierung war diese Technik ideal, auch wenn sie dynamische Animationen nur eingeschränkt zuließ.

Gerade deshalb gehörten Tektronix-Displays in vielen Laboren fast ebenso selbstverständlich zur Ausstattung wie Oszilloskope. Der 4051 verband diese präzise Anzeige mit eigener Rechenleistung und konnte über den General Purpose Interface Bus – später als IEEE-488 standardisiert – mit Plottern, Messgeräten, Druckern oder Speicherlösungen kommunizieren. Damit wurde er Teil größerer Instrumentationssysteme, ohne selbst ein komplexes Rechnernetz zu benötigen.

Auch wirtschaftlich gehörte der Rechner nicht in die Welt der Heimcomputer. Der Basispreis lag bei seiner Einführung bei rund 5.995 US-Dollar, während einzelne Quellen für das Jahr 1976 auch etwa 6.995 US-Dollar nennen, abhängig von Ausstattung und Erweiterungen. Inflationsbereinigt entspricht dies heute einer Kaufkraft von ungefähr 35.900 US-Dollar und unterstreicht die Position des Systems als professionelles Instrument für Forschung, Industrie und Ausbildung – deutlich günstiger als komplette Minicomputer-Grafikinstallationen, aber weit entfernt vom entstehenden Heimcomputermarkt.

Nicht nur in Forschungseinrichtungen, sondern auch vor der Kamera wurden Systeme der Tektronix-4050-Reihe zu einem vertrauten Anblick. In den späten siebziger und frühen achtziger Jahren griffen Ausstattungsabteilungen von Film- und Fernsehproduktionen regelmäßig auf Geräte dieser Bauart zurück, wenn moderne Labore, Kontrollzentren oder technische Einrichtungen dargestellt werden sollten. Ihre klare Vektorgrafik, die ruhige Darstellung und das instrumentelle Erscheinungsbild vermittelten genau jene technische Glaubwürdigkeit, die Studiodesigner suchten.

So tauchten Geräte der Serie in verschiedenen Science-Fiction-Produktionen und Thrillern auf, darunter Moonraker oder D.A.R.Y.L., wo sie als scheinbar hochentwickelte Rechentechnik inszeniert wurden. Doch nicht nur ernste Zukunftsvisionen machten sich ihre Wirkung zunutze. Auch in Komödien fanden sie Verwendung. In Airplane! (Die unglaubliche Reise in einem verrückten Flugzeug, 1980) ist in der Flugleitzentrale deutlich die markante Silhouette eines Systems der Tektronix-4050-Serie zu erkennen, das dort als moderner Radarbildschirm dient und die Flugbewegungen in typischer Vektorgrafik darstellt – ein Requisitenwitz, der gerade deshalb funktionierte, weil das Gerät real existierte und überzeugend wirkte.

Bis zur Einführung grafischer Desktop-Computer mit rasterbasierter Benutzeroberfläche gehörten Tektronix-Systeme dieser Art zu den besonders häufig verwendeten Rechnern vor der Kamera. Erst mit dem Auftreten von Systemen wie dem Macintosh, deren grafische Oberfläche eine neue visuelle Vorstellung von Computern prägte, verlor diese Form der Darstellung allmählich ihre Wirkung als Zukunftsbild. Innerhalb der Tektronix-Produktpalette blieb der 4051 dennoch nur ein Teil einer größeren Entwicklung. Für anspruchsvollere Visualisierungsaufgaben entstanden parallel leistungsfähigere Systeme, darunter der Tektronix 4081, der einen deutlich anderen technischen Ansatz verfolgte und damit ein eigenes Kapitel in der Geschichte grafischer Computersysteme bildet.

Während der 4051 den grafischen Laborarbeitsplatz verkörperte, entwickelte Tektronix mit dem 4081 parallel ein deutlich leistungsfähigeres Visualisierungssystem, das nicht mehr primär als eigenständiger Desktop-Rechner gedacht war, sondern als Bestandteil größerer Rechenumgebungen. Der 4081 zielte auf anspruchsvollere grafische Anwendungen in Wissenschaft, Technik und Simulation und knüpfte damit stärker an die Tradition von Hochleistungs-Grafikterminals und spezialisierten Visualisierungsstationen an als an die kompakten Instrumentenrechner der 4050-Serie.