Source: https://www.mac27.net/power-mac-g4-cube

Es war einer dieser Momente, wie sie Steve Jobs über Jahre hinweg perfektioniert hatte. Apple-Präsentationen waren für ihn nie bloße Produktvorstellungen gewesen – sie waren Inszenierungen, bewusst aufgebaute Dramaturgien, bei denen das Publikum nicht nur informiert, sondern regelrecht verführt werden sollte.

Die Zuschauer wussten das. Und sie erwarteten es auch. Wenn Jobs die Bühne betrat, ging es nicht allein um technische Daten oder Modellpflege. Es ging um den nächsten Schritt, um die Frage, welchen Stempel Cupertino der Computerwelt diesmal aufdrücken würde.

Der berühmte Moment, das kurze Innehalten, die scheinbar beiläufige Ankündigung – „but there’s one more thing“ – war längst zu einem Ritual geworden. Ein Versprechen, dass hinter dem Vorhang noch etwas wartete, das über das Erwartbare hinausging.

Genau in diesem Spannungsfeld wurde im Sommer 2000 der Apple Power Mac G4 Cube vorgestellt.

Es war einer dieser Momente, wie sie Steve Jobs nur selten inszenierte – und wenn, dann mit maximaler Wirkung. Auf der Bühne der Macworld im Sommer 2000 stand zunächst nichts weiter als eine Idee im Raum, formuliert in einem jener Sätze, die zugleich Vision und Versprechen waren:

„we are combining the power of the Power Mac G4 […] with the desktop elegance, the silence and the miniaturization that we learned from doing the iMac to make a whole new class of machine“

(„Wir kombinieren die Leistung des Power Mac G4 mit der Eleganz, der Lautlosigkeit und der Miniaturisierung des iMac, um eine völlig neue Klasse von Computern zu schaffen.“)

Es war mehr als nur eine Produktankündigung. Jobs sprach nicht von einem neuen Modell, sondern ausdrücklich von einer „new class of machine“ – ein Anspruch, der weit über die Technik hinausging. Apple wollte hier keinen bestehenden Markt bedienen, sondern ihn erweitern.

Dann folgte die Verdichtung dieser Idee in eine physische Form:

„we have miniaturized all that power into something this size […] an 8 inch cube“

(„Wir haben all diese Leistung in etwas von dieser Größe miniaturisiert […] einen 8-Zoll-Würfel.“)

Ein kompletter Power Mac G4, reduziert auf ein Volumen, das eher an ein Designobjekt erinnerte als an einen klassischen Rechner. Und als wäre das nicht genug, setzte Jobs noch einen weiteren Akzent:

„all this power in an 8 inch cube has cooled without a fan […] so it runs in virtual silence“

(„All diese Leistung in einem 8-Zoll-Würfel wird ohne Lüfter gekühlt […] und läuft praktisch lautlos.“)

Als der Rechner schließlich enthüllt wurde, fiel der vielleicht programmatischste Satz des gesamten Auftritts:

„quite possibly the most beautiful product we’ve ever designed“

(„Möglicherweise das schönste Produkt, das wir je entworfen haben.“)

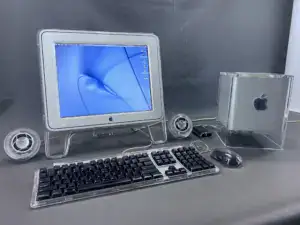

Und tatsächlich – der Cube war weniger ein Computer im klassischen Sinne als vielmehr ein bewusst inszeniertes Objekt. Ein System, das nicht unter dem Schreibtisch verschwand, sondern sichtbar wurde.

Während der Applaus noch nachhallte, begann hinter den Kulissen jedoch bereits eine Geschichte, die deutlich weniger makellos verlief.

Die Form selbst war kein Zufall. Wer genau hinsah, erkannte eine Linie zurück zu NeXT – jenem Unternehmen, das Jobs nach seinem Weggang von Apple gegründet hatte. Dessen Rechner, später als NeXTcube bekannt, folgten bereits einer ähnlichen geometrischen Klarheit. Jobs bestätigte später knapp: „Yes, we did one before.“

Doch der Unterschied war entscheidend. Während der NeXTcube noch als klassisches Arbeitsgerät gedacht war, wurde der Cube bewusst als Objekt gestaltet – als ein System, das sichtbar auf dem Schreibtisch stand. Jobs beschrieb ihn sinngemäß als „brain in a beaker“ – ein sichtbar gemachtes, konzentriertes System.

Der Weg dorthin war jedoch alles andere als trivial. Die transparente Hülle war das Ergebnis monatelanger Entwicklung. Jobs ließ durchblicken, dass es ein halbes Jahr dauerte, allein die exakte Materialzusammensetzung für das Gehäuse zu entwickeln. Statt klassischem Spritzguss setzte Apple zusätzlich auf präzise Nachbearbeitung – Bohrungen und Lüftungsöffnungen wurden nachträglich gefräst, um die gewünschte optische Klarheit zu erreichen.

Dieser Aufwand war kein Selbstzweck. Apple hatte bereits mit dem iMac gelernt, dass Material und Erscheinung Teil der Produktidentität waren. Der Cube führte diesen Ansatz konsequent fort.

Und doch zeigte sich bereits in dieser Phase ein grundlegendes Problem. Kurz vor der Präsentation wurde intern deutlich, dass sich der geplante Preis nicht halten ließ. Der Rechner würde deutlich teurer werden als ursprünglich vorgesehen. Hier kollidierten erstmals Vision und Realität – ein Konflikt, der später entscheidend werden sollte.

So überzeugend die Inszenierung war – ihre eigentliche Bewährungsprobe fand die Konstruktion nicht auf der Bühne, sondern im Alltag statt.

Im Inneren arbeitete ein PowerPC G4 (Motorola 7400) mit integrierter Velocity Engine, unterstützt von einem dedizierten L2-Cache. Der Arbeitsspeicher ließ sich auf bis zu 1,5 GB ausbauen, womit das System technisch klar im oberen Bereich seiner Zeit lag. Auch die Ausstattung mit FireWire, USB, Ethernet und optionalem AirPort unterstrich, dass es sich nicht um ein abgespecktes System handelte.

Doch nicht die reine Leistung machte den Cube bemerkenswert, sondern seine Konstruktion. Apple verzichtete vollständig auf einen Lüfter. Stattdessen wurde die Wärme über einen zentralen Kühlkörper nach oben abgeführt – allein durch natürliche Luftzirkulation. In der Praxis bedeutete das einen nahezu lautlosen Betrieb, allerdings auch ein System, das thermisch näher an seinen Grenzen arbeitete als klassische Tower-Rechner.

Auch die äußere Gestaltung folgte diesem Prinzip der Reduktion. Sämtliche Anschlüsse befanden sich an der Unterseite des Geräts – eine Entscheidung, die das Erscheinungsbild klar hielt, im Alltag jedoch nicht immer praktisch war.

Mit dem Apple Display Connector ging Apple noch einen Schritt weiter. Video, Daten und Strom wurden über ein einziges Kabel geführt – elegant, aber zugleich proprietär. Ein Ansatz, der bereits erkennen ließ, wie stark Apple sein Ökosystem kontrollieren wollte.

Beim Thema Audio verzichtete man vollständig auf interne Lösungen. Stattdessen entwickelte Apple gemeinsam mit Harman Kardon externe Lautsprecher, die sowohl funktional als auch gestalterisch Teil des Systems waren.

Im Inneren blieb der Zugriff hingegen überraschend klassisch. Mit einem einfachen Mechanismus ließ sich der komplette Kern des Systems herausziehen. Komponenten waren schnell erreichbar – ein Detail, das besonders professionelle Anwender ansprach.

Doch genau hier lag die Grenze. Trotz dieser Zugänglichkeit war die Erweiterbarkeit eingeschränkt. Es fehlten PCI-Steckplätze, zusätzliche Laufwerksplätze und flexible Upgrade-Möglichkeiten. Im direkten Vergleich bot der klassische Power Mac G4 Tower mehr Leistungsspielraum – und das oft zu einem geringeren Preis.

Damit wurde die Position des Cube zunehmend unklar. Für Einsteiger war er zu teuer, für Profis zu eingeschränkt.

Die Zahlen folgten schnell. Statt der erwarteten Nachfrage wurden nur rund 150.000 Einheiten verkauft. Bereits wenige Monate nach Marktstart reagierte Apple mit Preisnachlässen. Intern galt das Projekt schon früh als gescheitert.

Später formulierte Tim Cook rückblickend:

„It was a spectacular failure commercially, from the first day almost.“

(„Es war wirtschaftlich ein spektakulärer Fehlschlag – praktisch vom ersten Tag an.“)

Auch Apples eigene Analyse fiel nüchtern aus. Phil Schiller erklärte, dass sich die meisten Kunden stattdessen für die Power-Mac-G4-Tower entschieden hätten – leistungsstärker, günstiger und vor allem flexibler.

Am 3. Juli 2001 setzte Apple den Cube offiziell aus und ließ die Tür bewusst offen – man sprach von einer möglichen Rückkehr, nicht von einer endgültigen Einstellung.

Und doch verschwand der Cube in seiner ursprünglichen Form.

Sein Einfluss blieb jedoch bestehen. Die Idee, leistungsfähige Hardware in kompakte, designorientierte Gehäuse zu integrieren, fand später in Geräten wie dem Mac mini oder dem Mac Studio eine neue Ausprägung – diesmal jedoch zu einem Preis und in einer Form, die der Markt besser aufnehmen konnte.

Rückblickend wirkt der Cube wie ein Produkt, das weniger für seine eigene Zeit entwickelt wurde als für eine Zukunft, die erst noch entstehen musste. Ein Rechner, der technisch funktionierte, gestalterisch überzeugte – und dennoch an seiner Einordnung scheiterte.

Vielleicht liegt gerade darin seine eigentliche Bedeutung.

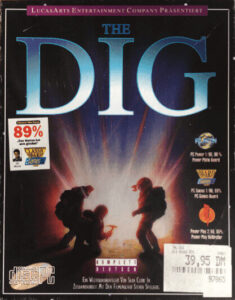

Ein Asteroiden-Abenteuer aus Spielberg’scher Feder? Klingt nach Hollywood-Kino, landete aber 1995 als Videospiel auf unseren Festplatten. The Dig blickt auf eine der verrücktesten Entstehungsgeschichten der LucasArts-Adventures zurück. Starregisseur Steven Spielberg hatte Mitte der 80er Jahre die Ursprungsidee zu dieser Sci-Fi-Story – ursprünglich als Episode der TV-Serie Amazing Stories, später sogar als Film angedacht. Doch das Konzept (Archäologen im All!) war für eine TV-Produktion zu teuer, also verschwand es vorerst in der Schublade. Einige Jahre und Blockbuster später – Spielberg hatte gerade mit Kumpel George Lucas Indiana Jones und der letzte Kreuzzug abgedreht – erinnerte er sich an die Idee und schlug sie LucasArts als Adventure-Spiel vor. Man traf sich 1989 im Skywalker Ranch Anwesen, ausgerechnet am Tag des San-Francisco-Erdbebens, um das Projekt aufzugleisen. Ein schlechtes Omen? Vielleicht. Jedenfalls sollte es bis zur Veröffentlichung noch über sechs Jahre dauern – länger als bei jedem anderen LucasArts-Adventure. In dieser Zeit wechselte das Spiel viermal den Projektleiter und drohte zwischenzeitlich zum Vapoware-Geist zu werden. „Es war, als müsste man für eine schwere Physikprüfung lernen, während rundherum eine Party tobt“, erinnerte sich Lead Designer Sean Clark augenzwinkernd an die schwierige Produktion inmitten der sonst spaßigen LucasArts-Truppe.

Ein Asteroiden-Abenteuer aus Spielberg’scher Feder? Klingt nach Hollywood-Kino, landete aber 1995 als Videospiel auf unseren Festplatten. The Dig blickt auf eine der verrücktesten Entstehungsgeschichten der LucasArts-Adventures zurück. Starregisseur Steven Spielberg hatte Mitte der 80er Jahre die Ursprungsidee zu dieser Sci-Fi-Story – ursprünglich als Episode der TV-Serie Amazing Stories, später sogar als Film angedacht. Doch das Konzept (Archäologen im All!) war für eine TV-Produktion zu teuer, also verschwand es vorerst in der Schublade. Einige Jahre und Blockbuster später – Spielberg hatte gerade mit Kumpel George Lucas Indiana Jones und der letzte Kreuzzug abgedreht – erinnerte er sich an die Idee und schlug sie LucasArts als Adventure-Spiel vor. Man traf sich 1989 im Skywalker Ranch Anwesen, ausgerechnet am Tag des San-Francisco-Erdbebens, um das Projekt aufzugleisen. Ein schlechtes Omen? Vielleicht. Jedenfalls sollte es bis zur Veröffentlichung noch über sechs Jahre dauern – länger als bei jedem anderen LucasArts-Adventure. In dieser Zeit wechselte das Spiel viermal den Projektleiter und drohte zwischenzeitlich zum Vapoware-Geist zu werden. „Es war, als müsste man für eine schwere Physikprüfung lernen, während rundherum eine Party tobt“, erinnerte sich Lead Designer Sean Clark augenzwinkernd an die schwierige Produktion inmitten der sonst spaßigen LucasArts-Truppe.

Zum Ende der 1980er und zum Beginn der 1990er war das Wort „Quest“ scheinbar ein eingetragenes Markenzeichen des Spieleherstellers Sierra Online. King's Quest, Space Quest, Quest for Glory, Hero’s Quest, The Colonels BeQUEST, ConQUESTS of Camelot oder EcoQuest seien da nur als Beispiele genannt. Hinzu kam ab 1987 Police Quest, dass dem gewöhnlichen Polizisten Sonny Bonds in seinem Arbeitsalltag auf den Straßen Lyttons im Bundesstaat Kalifornien folgt. Im Zuge des Abenteuers lernt der Spieler nicht nur typischen Alltag eines Polizisten kennen, sondern auch das Handbuch anzubeten. Dieses sollte man sich unbedingt vor Spielbeginn zu Gemüte gezogen und die Hinweise zu Eigen gemacht haben, sonst ist ein vorzeitiges Game Over unvermeidlich.

Zum Ende der 1980er und zum Beginn der 1990er war das Wort „Quest“ scheinbar ein eingetragenes Markenzeichen des Spieleherstellers Sierra Online. King's Quest, Space Quest, Quest for Glory, Hero’s Quest, The Colonels BeQUEST, ConQUESTS of Camelot oder EcoQuest seien da nur als Beispiele genannt. Hinzu kam ab 1987 Police Quest, dass dem gewöhnlichen Polizisten Sonny Bonds in seinem Arbeitsalltag auf den Straßen Lyttons im Bundesstaat Kalifornien folgt. Im Zuge des Abenteuers lernt der Spieler nicht nur typischen Alltag eines Polizisten kennen, sondern auch das Handbuch anzubeten. Dieses sollte man sich unbedingt vor Spielbeginn zu Gemüte gezogen und die Hinweise zu Eigen gemacht haben, sonst ist ein vorzeitiges Game Over unvermeidlich.