Seattle, Frühjahr 1980. In den Büroräumen von Seattle Computer Products sitzt ein junger Entwickler über einem neuen Projekt. Die Firma hat gerade eine Prozessorplatine für den Intel 8086 entwickelt – eine leistungsfähige 16-Bit-CPU, die auf dem damals verbreiteten S-100-Bus eingesetzt werden soll. Doch ohne ein Betriebssystem bleibt die Hardware kaum nutzbar. Also beginnt der Ingenieur Tim Paterson, ein eigenes System zu schreiben. In wenigen Wochen entsteht ein funktionierendes System, das intern den pragmatischen Namen „Quick and Dirty Operating System“ erhält. Jahrzehnte später erinnerte sich Paterson nüchtern an diese Situation: Er habe das System schlicht geschrieben, „weil wir ein Betriebssystem für die 8086-Karte brauchten“, und damals nicht gedacht, dass daraus einmal etwas Bedeutendes entstehen würde.

Seattle, Frühjahr 1980. In den Büroräumen von Seattle Computer Products sitzt ein junger Entwickler über einem neuen Projekt. Die Firma hat gerade eine Prozessorplatine für den Intel 8086 entwickelt – eine leistungsfähige 16-Bit-CPU, die auf dem damals verbreiteten S-100-Bus eingesetzt werden soll. Doch ohne ein Betriebssystem bleibt die Hardware kaum nutzbar. Also beginnt der Ingenieur Tim Paterson, ein eigenes System zu schreiben. In wenigen Wochen entsteht ein funktionierendes System, das intern den pragmatischen Namen „Quick and Dirty Operating System“ erhält. Jahrzehnte später erinnerte sich Paterson nüchtern an diese Situation: Er habe das System schlicht geschrieben, „weil wir ein Betriebssystem für die 8086-Karte brauchten“, und damals nicht gedacht, dass daraus einmal etwas Bedeutendes entstehen würde.

Als im August 1981 der IBM PC vorgestellt wurde, lief bereits eine weiterentwickelte Version dieses Systems auf der neuen Maschine. In den folgenden Jahren verbreiteten sich Varianten dieses Systems auf hunderten Millionen Personal Computern weltweit. Bis Anfang der 1990er-Jahre hatte Microsoft bereits rund 100 Millionen Lizenzen von MS-DOS verkauft. Hinzu kamen kompatible Varianten wie IBM PC-DOS oder DR-DOS sowie die später auf DOS aufbauenden Systeme Windows 95, Windows 98 und Windows Me, deren installierte Basis die tatsächliche Verbreitung noch erheblich vergrößerte. In vielen Regionen kamen zudem große Mengen nicht lizenzierter Kopien hinzu. Der Ursprung dieser Entwicklung lag jedoch nicht bei IBM und auch nicht bei Microsoft, sondern bei einem kleinen Hardwareunternehmen im Bundesstaat Washington. Dort entstand 1980 ein Betriebssystem namens 86-DOS, das ursprünglich nur dazu gedacht war, eine neue Prozessorplattform überhaupt nutzbar zu machen.

Seattle Computer Products war zu dieser Zeit ein vergleichsweise kleines Unternehmen aus der Region Seattle, das vor allem Erweiterungskarten und Prozessorboards für den S-100-Bus herstellte. Gegründet wurde die Firma 1978 von Rod Brock. Der Markt für Mikrocomputer befand sich damals in einer Phase rasanten Wachstums, doch die Softwarelandschaft war stark fragmentiert. Der De-facto-Standard war CP/M von Digital Research, ein Betriebssystem für 8-Bit-Prozessoren wie den Intel 8080 oder Zilog Z80. Viele Hersteller warteten auf eine angekündigte 16-Bit-Variante namens CP/M-86, doch deren Entwicklung verzögerte sich.

Für Unternehmen wie Seattle Computer Products stellte das ein praktisches Problem dar. Die neue 8086-Hardware konnte zwar technisch überzeugen, doch ohne ein Betriebssystem war sie für Entwickler und Anwender kaum attraktiv. In dieser Situation begann Tim Paterson im Frühjahr 1980 mit der Entwicklung eines eigenen Systems.

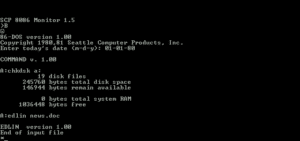

Das Projekt erhielt intern zunächst den Namen QDOS, eine Abkürzung für „Quick and Dirty Operating System“. In frühen Anzeigen und Produktinformationen von Seattle Computer Products wurde diese Bezeichnung zeitweise auch öffentlich verwendet. Schon bald entschied sich das Unternehmen jedoch für den Namen 86-DOS, der sich direkt auf den verwendeten Intel-Prozessor bezog und professioneller wirkte.

Das Projekt erhielt intern zunächst den Namen QDOS, eine Abkürzung für „Quick and Dirty Operating System“. In frühen Anzeigen und Produktinformationen von Seattle Computer Products wurde diese Bezeichnung zeitweise auch öffentlich verwendet. Schon bald entschied sich das Unternehmen jedoch für den Namen 86-DOS, der sich direkt auf den verwendeten Intel-Prozessor bezog und professioneller wirkte.

Technisch war das System bemerkenswert kompakt. Der ursprüngliche Kernel bestand aus nur etwa sechs Kilobyte Assemblercode, eine Größe, die selbst für damalige Verhältnisse ungewöhnlich klein war. Dennoch enthielt das System bereits die grundlegenden Funktionen eines Diskettenbetriebssystems: einen Kommandointerpreter, Dateiverwaltung sowie eine Programmierschnittstelle, über die Anwendungen mit dem Betriebssystem kommunizieren konnten.

Bei der Gestaltung orientierte sich Paterson teilweise an CP/M, das damals praktisch der Industriestandard für Mikrocomputer darstellte. Viele Befehle und Strukturen wurden bewusst ähnlich gehalten, um Entwicklern den Übergang zu erleichtern und die Portierung bestehender Programme zu vereinfachen. Gleichzeitig versuchte er jedoch, einige Schwächen des Vorbilds zu vermeiden. Besonders kritisch sah er die Art und Weise, wie CP/M Diskettenzugriffe organisierte. Das System benötigte oft mehrere Umdrehungen der Diskette, um alle benötigten Daten eines Tracks einzulesen, was den Zugriff vergleichsweise langsam machte. Paterson versuchte deshalb, die Diskettenorganisation effizienter zu gestalten und unnötige Rotationen zu vermeiden.

Eine wichtige technische Entscheidung war die Nutzung einer File Allocation Table (FAT) zur Verwaltung von Dateien. Diese Struktur hatte Paterson zuvor aus Microsofts Disk-BASIC kennengelernt und adaptierte sie für sein Betriebssystem. Das FAT-Dateisystem erlaubte eine flexiblere Organisation von Dateien und wurde später zu einem der langlebigsten technischen Elemente der gesamten DOS-Familie.

Die ersten Versionen von 86-DOS waren bewusst minimalistisch gehalten. Das System bot nur eine begrenzte Zahl grundlegender Befehle – etwa zwanzig interne und externe Kommandos –, mit denen Dateien verwaltet und Programme gestartet werden konnten. Für Entwickler reichte diese Umgebung jedoch aus, um erste Anwendungen für den neuen 16-Bit-Prozessor zu schreiben.

Seattle Computer Products begann 1980 damit, seine 8086-Hardware zusammen mit 86-DOS anzubieten. Anzeigen aus dieser Zeit zeigen Komplettpakete aus CPU-Karte, Support-Board und Betriebssystem für Entwickler und Systembauer. Für das Unternehmen selbst war die Software jedoch vor allem ein praktisches Werkzeug, um die eigene Hardware überhaupt nutzbar zu machen.

Während diese Entwicklung im Nordwesten der USA stattfand, arbeitete IBM an einem Projekt, das später als IBM PC bekannt werden sollte. Um die Entwicklung zu beschleunigen, entschied sich das Unternehmen bewusst gegen eine vollständig proprietäre Architektur. Stattdessen sollten möglichst viele Komponenten aus bereits verfügbaren Standardbausteinen bestehen. Für den Prozessor fiel die Wahl auf den Intel 8088, eine Variante des 8086 mit 8-Bit-Datenbus.

Auch beim Betriebssystem wollte IBM auf vorhandene Lösungen zurückgreifen. Der naheliegendste Kandidat war Digital Research, dessen CP/M damals den Markt für Mikrocomputer dominierte. Im Sommer 1980 nahmen IBM-Vertreter daher Kontakt mit dem Unternehmen auf, um über eine Version namens CP/M-86 für den neuen Rechner zu sprechen.

Die Gespräche verliefen jedoch nicht wie geplant. Verschiedene Berichte schildern unterschiedliche Details, doch fest steht, dass keine Einigung zustande kam. Eine häufig erzählte Version besagt, dass Gary Kildall, der Gründer von Digital Research, an diesem Tag nicht persönlich an den Verhandlungen teilnahm und die Gespräche zunächst von seiner Frau Dorothy McEwen geführt wurden. Sie weigerte sich, eine von IBM verlangte Geheimhaltungsvereinbarung zu unterschreiben, ohne sie vorher juristisch prüfen zu lassen. Als Kildall später zurückkehrte, war die Situation bereits festgefahren. Ob es danach noch weitere Gespräche gab, ist unter Historikern umstritten. Am Ende kam jedoch kein Vertrag zustande.

IBM suchte daher nach einer Alternative und wandte sich an ein kleines Unternehmen aus Seattle, das bereits Software für verschiedene Mikrocomputer geliefert hatte: Microsoft.

Microsoft war zu diesem Zeitpunkt vor allem als Hersteller von Programmiersprachen bekannt. Besonders Microsoft BASIC war auf zahlreichen Mikrocomputern der späten 1970er-Jahre im Einsatz. IBM beauftragte das Unternehmen daher zunächst damit, eine BASIC-Version für den neuen Personal Computer bereitzustellen. Erst im Verlauf dieser Zusammenarbeit entstand auch die Frage nach einem geeigneten Betriebssystem.

Microsoft selbst besaß jedoch noch keines. Hier kam eine Erinnerung von Paul Allen, dem Mitgründer des Unternehmens, ins Spiel. Allen wusste von dem Betriebssystem, das bei Seattle Computer Products für den 8086 entwickelt worden war. Für Microsoft bot sich damit eine Möglichkeit, schnell eine Grundlage für ein neues PC-Betriebssystem zu erhalten.

Ende 1980 erwarb Microsoft zunächst eine Lizenz für 86-DOS von Seattle Computer Products. Kurz darauf entschied sich das Unternehmen jedoch, sämtliche Rechte an der Software vollständig zu übernehmen. Durch diesen Schritt erhielt Microsoft die Kontrolle über die Weiterentwicklung des Systems und konnte es auch unabhängig an andere Hersteller lizenzieren.

Um das System rasch an die Anforderungen des IBM-PC-Projekts anzupassen, holte Microsoft schließlich auch Tim Paterson selbst ins Unternehmen. Der Entwickler wechselte 1981 von Seattle Computer Products nach Redmond und arbeitete dort an der Anpassung seines Systems für den Intel 8088 des neuen Personal Computers.

Erst im Laufe dieser Arbeit wurde ihm klar, für welchen Kunden das Projekt tatsächlich bestimmt war. In späteren Interviews erinnerte sich Paterson, dass Microsoft intern zunächst lediglich von einem neuen Computer eines großen Herstellers gesprochen habe. Erst nach und nach wurde deutlich, dass es sich um den geplanten Personal Computer von IBM handelte. Für Paterson, der wenige Monate zuvor noch ein Betriebssystem für eine S-100-Prozessorplatine geschrieben hatte, bedeutete diese Erkenntnis eine unerwartete Wendung: Aus einem improvisierten Werkzeug für eine einzelne Hardwareplattform wurde plötzlich das Betriebssystem eines Rechners, der kurz darauf zu einer neuen Standardplattform der Personal-Computer-Industrie werden sollte.

Als der IBM PC im August 1981 schließlich vorgestellt wurde, erschien das Betriebssystem unter dem Namen PC-DOS. Parallel dazu behielt Microsoft jedoch das Recht, das System auch unabhängig von IBM zu lizenzieren und unter eigener Bezeichnung zu vertreiben.

Diese Vertragsstruktur erwies sich im Rückblick als entscheidend. Während IBM seine eigene Variante des Systems verwendete, konnte Microsoft das Betriebssystem an die wachsende Zahl von IBM-PC-kompatiblen Computern lizenzieren. Als in den folgenden Jahren immer mehr Hersteller sogenannte PC-Klone auf den Markt brachten, wurde MS-DOS zum gemeinsamen Softwarefundament dieser neuen Computerplattform.

Aus dem kleinen Projekt, das Tim Paterson ursprünglich als pragmatische Lösung für eine einzelne Prozessorplatine geschrieben hatte, entstand so die Grundlage für MS-DOS. In den folgenden Jahren wurde dieses System zum dominierenden Betriebssystem der PC-Welt und prägte eine ganze Generation von Personal Computern.

Die Geschichte von 86-DOS zeigt damit eine typische Konstellation der frühen PC-Industrie: Ein kleines Hardwareunternehmen löst ein unmittelbares technisches Problem, ein Softwareanbieter erkennt das größere Marktpotenzial – und aus einer pragmatischen Zwischenlösung entsteht schließlich eine der prägendsten Plattformen der Computergeschichte.

Als der NCR Personal Computer Model 4 Mitte der 1980er Jahre erschien, stand dahinter kein Newcomer, sondern eines der traditionsreichsten Unternehmen der Datenverarbeitung. NCR – ursprünglich National Cash Register – war bereits seit dem späten 19. Jahrhundert im Bereich mechanischer und später elektronischer Rechen- und Kassensysteme aktiv und hatte sich im Laufe des 20. Jahrhunderts zu einem globalen Anbieter von Banktechnik, Transaktionssystemen und Großrechner-Peripherie entwickelt. Lange bevor der Personal Computer den Büromarkt eroberte, prägten NCR-Systeme bereits den Alltag von Banken, Verwaltungen und Handelsketten. Der Einstieg in den PC-Markt war daher weniger ein Experiment als der Versuch, diese gewachsene Erfahrung in eine neue Geräteklasse zu übertragen.

Als der NCR Personal Computer Model 4 Mitte der 1980er Jahre erschien, stand dahinter kein Newcomer, sondern eines der traditionsreichsten Unternehmen der Datenverarbeitung. NCR – ursprünglich National Cash Register – war bereits seit dem späten 19. Jahrhundert im Bereich mechanischer und später elektronischer Rechen- und Kassensysteme aktiv und hatte sich im Laufe des 20. Jahrhunderts zu einem globalen Anbieter von Banktechnik, Transaktionssystemen und Großrechner-Peripherie entwickelt. Lange bevor der Personal Computer den Büromarkt eroberte, prägten NCR-Systeme bereits den Alltag von Banken, Verwaltungen und Handelsketten. Der Einstieg in den PC-Markt war daher weniger ein Experiment als der Versuch, diese gewachsene Erfahrung in eine neue Geräteklasse zu übertragen.