Als die AdLib Music Synthesizer Card 1987 erschien, war der IBM-PC zwar längst als Arbeitsrechner etabliert, klanglich jedoch noch immer ein technisches Hinterland. Während Besitzer eines Commodore 64 bereits vom markanten Klang des SID-Chips begleitet wurden, der Atari ST mit seinem YM2149 mehrstimmige Musik beherrschte und der Amiga dank Paula sogar digitale Samples ausgeben konnte, musste sich der PC-Spieler weiterhin mit dem berüchtigten Systemlautsprecher begnügen – einem Piezo-Piepser, dessen akustische Ausdruckskraft irgendwo zwischen Taschenrechner und Rauchmelder lag. Zwar existierten bereits vereinzelte Soundlösungen für IBM-kompatible Rechner, doch erst die kanadische Firma Ad Lib, Inc. schuf mit ihrer AdLib-Karte jene Erweiterung, die sich erstmals als echter Audiostandard im PC-Bereich etablieren sollte.

Als die AdLib Music Synthesizer Card 1987 erschien, war der IBM-PC zwar längst als Arbeitsrechner etabliert, klanglich jedoch noch immer ein technisches Hinterland. Während Besitzer eines Commodore 64 bereits vom markanten Klang des SID-Chips begleitet wurden, der Atari ST mit seinem YM2149 mehrstimmige Musik beherrschte und der Amiga dank Paula sogar digitale Samples ausgeben konnte, musste sich der PC-Spieler weiterhin mit dem berüchtigten Systemlautsprecher begnügen – einem Piezo-Piepser, dessen akustische Ausdruckskraft irgendwo zwischen Taschenrechner und Rauchmelder lag. Zwar existierten bereits vereinzelte Soundlösungen für IBM-kompatible Rechner, doch erst die kanadische Firma Ad Lib, Inc. schuf mit ihrer AdLib-Karte jene Erweiterung, die sich erstmals als echter Audiostandard im PC-Bereich etablieren sollte.

Gegründet wurde Ad Lib in Québec von Martin Prevel, einem Musikpädagogen und Unternehmer, der überzeugt war, dass Personal Computer mehr sein müssten als bloße Arbeitsmaschinen. Seine Idee war ebenso einfach wie wirkungsvoll: eine bezahlbare Erweiterungskarte, die dem IBM-PC echte musikalische Fähigkeiten verleihen sollte, ohne den Rechner selbst zu verändern. Das Herzstück dieser Lösung war der Yamaha YM3812, besser bekannt als OPL2 – ein FM-Synthesechip, der ursprünglich für elektronische Musikinstrumente und Embedded-Anwendungen entwickelt worden war. Dieser Baustein sollte in den folgenden Jahren zum akustischen Fingerabdruck des DOS-PCs werden.

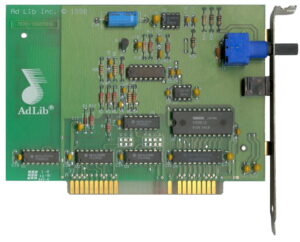

Technisch war die AdLib bemerkenswert schlicht konstruiert. Die Karte belegte einen 8-Bit-ISA-Slot und bestand im Wesentlichen aus dem Yamaha-Chip, der nötigen ISA-Logik, einem Wandler für das Ausgangssignal und einer einfachen Analogsektion. Auf zusätzliche Funktionen verzichtete Ad Lib bewusst: Es gab weder PCM-Digitalaudio noch Aufnahmefunktionen, keinen Gameport und keine Mischlogik. Die Karte war ein reiner FM-Synthesizer – gebaut ausschließlich für Musik und synthetische Soundeffekte. Technisch war die AdLib bemerkenswert schlicht konstruiert. Die Karte belegte einen 8-Bit-ISA-Slot und bestand im Wesentlichen aus dem Yamaha-Chip, der nötigen ISA-Logik, einem Wandler für das Ausgangssignal und einer einfachen Analogsektion. Auf zusätzliche Funktionen verzichtete Ad Lib bewusst: Es gab weder PCM-Digitalaudio noch Aufnahmefunktionen, keinen Gameport und keine Mischlogik. Die Karte war ein reiner FM-Synthesizer – gebaut ausschließlich für Musik und synthetische Soundeffekte. Selbst auf softwareseitige Lautstärkeregelung musste der Nutzer verzichten: Die originale AdLib besaß hierfür ein kleines analoges Potentiometer direkt an der Slotblende, sodass die Lautstärke physisch per Hand an der Karte selbst eingestellt werden musste – ein charmantes Detail, das heute fast archaisch wirkt, damals jedoch keineswegs ungewöhnlich war. Gerade diese Konzentration auf das Wesentliche hielt die Hardware überschaubar und den Preis im Rahmen. Gerade diese Konzentration auf das Wesentliche hielt die Hardware überschaubar und den Preis im Rahmen: Zum Marktstart kostete die Karte rund 219 US-Dollar, was inflationsbereinigt heute etwa 600 bis 650 Euro entspräche.

Der YM3812/OPL2 arbeitete mit Frequency Modulation Synthesis, kurz FM-Synthese. Anders als spätere Sample-basierte Soundkarten spielte er keine aufgezeichneten Instrumente ab, sondern erzeugte seine Klangfarben mathematisch in Echtzeit. Zwei sogenannte Operatoren modulierten dabei Sinuswellen zu komplexeren Klangstrukturen. Der Chip bot neun simultane Stimmen, alternativ einen Rhythmusmodus mit dedizierten Percussion-Kanälen. Das Resultat war kein realistischer Orchesterklang, sondern ein markant synthetischer, leicht metallischer Soundcharakter – unverwechselbar, prägnant und heute untrennbar mit der DOS-Ära verbunden.

Doch gute Technik allein genügt selten. In ihren ersten Monaten blieb die AdLib ein Nischenprodukt, dessen Potential nur wenige erkannten. Erst Sierra On-Line sorgte für den entscheidenden Durchbruch. Mit King’s Quest IV: The Perils of Rosella, veröffentlicht am 16. August 1988, erschien das erste große kommerzielle Spiel mit nativer AdLib-Unterstützung. Für viele PC-Spieler war dies ein Schlüsselmoment: Statt piepsender Signaltöne erklang plötzlich ein vollständiger, orchestrierter Soundtrack. Sierra engagierte hierfür sogar den Film- und TV-Komponisten William Goldstein, was eindrucksvoll zeigte, welchen Stellenwert man der neuen Audiotechnik beimaß. Der Erfolg des Spiels machte die AdLib über Nacht vom Spezialistenwerkzeug zur begehrten Gaming-Hardware.

Binnen kurzer Zeit wurde „AdLib Compatible“ zu einem festen Schlagwort auf PC-Spielverpackungen. Entwickler schätzten die einfache Programmierung über die Ports 388h und 389h, wodurch sich der OPL2-Chip direkt ansprechen ließ. Gleichzeitig wurde die Offenheit der Hardware jedoch zu einem zweischneidigen Schwert. Da Ad Lib außer dem Yamaha-Chip kaum proprietäre Technik einsetzte, konnten Konkurrenten die Karte vergleichsweise leicht nachbauen. Zahlreiche kompatible Clones erschienen auf dem Markt – und der Name „AdLib“ wandelte sich rasch vom konkreten Produktnamen zum generischen Synonym für FM-PC-Sound.

Wie weit sich der OPL2 klanglich ausreizen ließ, demonstrierten Anfang der 1990er Jahre besonders talentierte Komponisten. Zu den bekanntesten Beispielen zählt der Soundtrack von Dune (1992), komponiert von Stéphane Picq. Um diesen rankte sich über Jahre der Mythos, der AdLib-Chip habe dort „physikalisch unmögliche“ Klänge erzeugt oder gar versteckte Samples abgespielt. Tatsächlich beruhte die Wirkung auf meisterhaft programmierter FM-Synthese: Picq entwarf eigene Klang-Patches, verzichtete weitgehend auf Standard-Presets und reizte die Operator-Struktur des OPL-Chips ungewöhnlich konsequent aus. Das Ergebnis waren für FM-Verhältnisse bemerkenswert weiche, atmosphärische und fast organisch wirkende Klangflächen, die den Ruf des OPL-Chips nachhaltig prägten.

Ironischerweise wurde der Erfolg der AdLib zugleich zu ihrem größten Problem. 1989 brachte Creative Labs die erste Sound Blaster auf den Markt – vollständig AdLib-kompatibel, aber zusätzlich ausgestattet mit PCM-Digitalaudio, Sample-Wiedergabe, Sprachausgabe und Gameport. Für Käufer gab es damit kaum noch einen rationalen Grund, zur Original-AdLib zu greifen. Die Sound Blaster verdrängte ihren geistigen Vorgänger nicht durch Inkompatibilität, sondern gerade dadurch, dass sie dessen Standard vollständig übernahm und erweiterte.

Ad Lib reagierte mit der technisch ambitionierten AdLib Gold 1000, doch die Karte erschien zu spät, war teuer und traf auf einen Markt, der bereits klar von Creative dominiert wurde. 1992 meldete das Unternehmen Insolvenz an. Damit verschwand zwar die Originalhardware, nicht jedoch ihr Standard: Der OPL-basierte „AdLib-Sound“ blieb bis weit in die Mitte der 1990er Jahre fester Bestandteil zahlloser DOS-Spiele, selbst wenn im Rechner längst eine Sound Blaster oder kompatible OPL3-Karte arbeitete.

Bemerkenswert ist, wie lebendig dieses Erbe bis heute geblieben ist. Originale AdLib-Karten erzielen auf dem Sammlermarkt inzwischen teils Preise von mehreren hundert Euro, seltene Varianten sogar deutlich mehr. Gleichzeitig entstand eine aktive Retro-Hardware-Szene, die exakte Reproduktionen historischer Platinenlayouts fertigt oder moderne Lösungen entwickelt, um echten OPL-Sound erneut verfügbar zu machen. Projekte wie OPL2LPT oder OPL3LPT verlagern den klassischen Yamaha-Synthesizer auf den Parallelport und ermöglichen damit authentischen AdLib-Sound selbst an Laptops oder ISA-losen Systemen. Multifunktionslösungen wie PicoGUS emulieren daneben mehrere historische Audiostandards auf moderner Hardware und zeigen, wie gefragt originalgetreuer DOS-Sound noch immer ist.

Auch in der Musikszene lebt der OPL-Klang weiter. Bastler integrieren originale Yamaha-Chips in DIY-Synthesizer, während Software-Emulationen und VST-Instrumente den charakteristischen FM-Sound moderner Produktion zugänglich machen. Was einst als pragmatische Sounderweiterung für Bürorechner begann, entwickelte sich so über Jahrzehnte zu einer eigenen Klangästhetik – vergleichbar mit der anhaltenden Verehrung des SID-Chips oder klassischer Roland-Synthesizer.

Rückblickend war die AdLib nie die technisch mächtigste Soundlösung ihrer Zeit. Sie bot weder Samples noch Stereo noch die Flexibilität späterer Konkurrenzprodukte. Doch ihre historische Bedeutung liegt an anderer Stelle: Sie war die erste Soundkarte, die den IBM-PC akustisch aus seiner piepsenden Frühzeit führte und einen einheitlichen, breit akzeptierten Audio-Standard etablierte. Ohne die AdLib hätte die Sound Blaster keinen so einfachen Weg gehabt. Ohne den OPL2-Chip würde ein erheblicher Teil der DOS-Spielegeschichte heute schlicht anders klingen.

Wer heute den unverwechselbaren Klang von Monkey Island, Commander Keen, Wing Commander, Dune oder zahllosen anderen DOS-Klassikern hört, lauscht damit nicht einfach nur „altem PC-Sound“ – sondern dem Vermächtnis einer unscheinbaren kanadischen Steckkarte, die dem IBM-PC erstmals eine musikalische Identität verlieh.

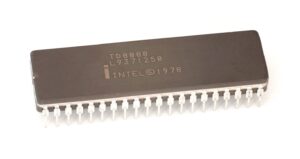

Seattle, Frühjahr 1980. In den Büroräumen von Seattle Computer Products sitzt ein junger Entwickler über einem neuen Projekt. Die Firma hat gerade eine Prozessorplatine für den Intel 8086 entwickelt – eine leistungsfähige 16-Bit-CPU, die auf dem damals verbreiteten S-100-Bus eingesetzt werden soll. Doch ohne ein Betriebssystem bleibt die Hardware kaum nutzbar. Also beginnt der Ingenieur Tim Paterson, ein eigenes System zu schreiben. In wenigen Wochen entsteht ein funktionierendes System, das intern den pragmatischen Namen „Quick and Dirty Operating System“ erhält. Jahrzehnte später erinnerte sich Paterson nüchtern an diese Situation: Er habe das System schlicht geschrieben, „weil wir ein Betriebssystem für die

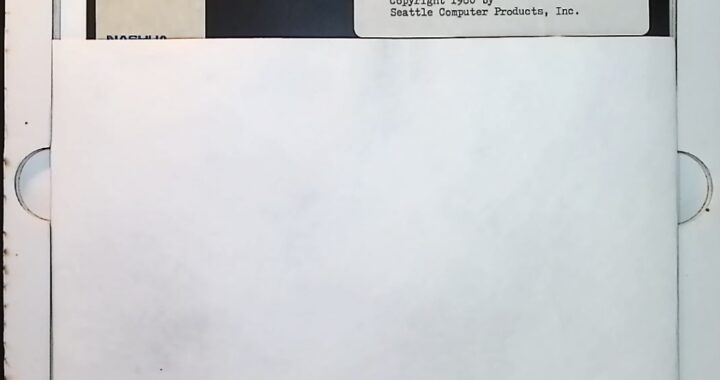

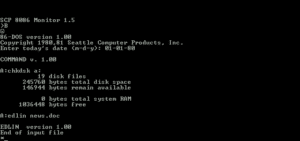

Seattle, Frühjahr 1980. In den Büroräumen von Seattle Computer Products sitzt ein junger Entwickler über einem neuen Projekt. Die Firma hat gerade eine Prozessorplatine für den Intel 8086 entwickelt – eine leistungsfähige 16-Bit-CPU, die auf dem damals verbreiteten S-100-Bus eingesetzt werden soll. Doch ohne ein Betriebssystem bleibt die Hardware kaum nutzbar. Also beginnt der Ingenieur Tim Paterson, ein eigenes System zu schreiben. In wenigen Wochen entsteht ein funktionierendes System, das intern den pragmatischen Namen „Quick and Dirty Operating System“ erhält. Jahrzehnte später erinnerte sich Paterson nüchtern an diese Situation: Er habe das System schlicht geschrieben, „weil wir ein Betriebssystem für die  Das Projekt erhielt intern zunächst den Namen QDOS, eine Abkürzung für „Quick and Dirty Operating System“. In frühen Anzeigen und Produktinformationen von Seattle Computer Products wurde diese Bezeichnung zeitweise auch öffentlich verwendet. Schon bald entschied sich das Unternehmen jedoch für den Namen 86-DOS, der sich direkt auf den verwendeten Intel-Prozessor bezog und professioneller wirkte.

Das Projekt erhielt intern zunächst den Namen QDOS, eine Abkürzung für „Quick and Dirty Operating System“. In frühen Anzeigen und Produktinformationen von Seattle Computer Products wurde diese Bezeichnung zeitweise auch öffentlich verwendet. Schon bald entschied sich das Unternehmen jedoch für den Namen 86-DOS, der sich direkt auf den verwendeten Intel-Prozessor bezog und professioneller wirkte.

B.C.’s Quest for Tires, entwickelt von Sydney Development Corporation und vertrieben durch Sierra On-Line, war eines jener Spiele, das im goldenen Zeitalter der Heimcomputer erschien und dabei etwas ganz Eigenes schuf. Basierend auf dem beliebten Zeitungscomic B.C. von Johnny Hart, versetzte das Spiel den Spieler in die Rolle des wortkargen Höhlenmenschen Thor, der auf einem Steinrad durch prähistorische Landschaften rollt, um seine Angebetete – „Cute Chick“ – aus den Fängen des Dinosauriers Gronk zu befreien. Die Handlung mag rudimentär wirken, doch der Witz, die stilisierte Grafik und das durchdachte Gameplay machten den Titel zu einem Klassiker jener frühen Homecomputer-Ära.

B.C.’s Quest for Tires, entwickelt von Sydney Development Corporation und vertrieben durch Sierra On-Line, war eines jener Spiele, das im goldenen Zeitalter der Heimcomputer erschien und dabei etwas ganz Eigenes schuf. Basierend auf dem beliebten Zeitungscomic B.C. von Johnny Hart, versetzte das Spiel den Spieler in die Rolle des wortkargen Höhlenmenschen Thor, der auf einem Steinrad durch prähistorische Landschaften rollt, um seine Angebetete – „Cute Chick“ – aus den Fängen des Dinosauriers Gronk zu befreien. Die Handlung mag rudimentär wirken, doch der Witz, die stilisierte Grafik und das durchdachte Gameplay machten den Titel zu einem Klassiker jener frühen Homecomputer-Ära.

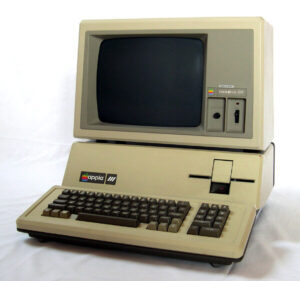

Als Apple im Mai 1980 den Apple III vorstellte, galt er als ambitioniertes Vorhaben, das den erfolgreichen

Als Apple im Mai 1980 den Apple III vorstellte, galt er als ambitioniertes Vorhaben, das den erfolgreichen