Ist es wirklich notwendig, noch über den Commodore 64 zu schreiben? Über einen Rechner, den viele als ihren ersten Computer erlebt haben. Über einen Namen, um den sich seit Jahrzehnten Mythen, Überhöhungen und nostalgische Rückblicke ranken. Vielleicht ist es gerade deshalb notwendig, noch einmal innezuhalten. Nicht, um diese Mythen zu wiederholen, sondern um sie einzuordnen. Denn wir sprechen hier über einen Computer, der angeblich zwanzig oder gar dreißig Millionen Mal verkauft wurde – Zahlen, die in dieser Form nicht belastbar sind. Sicher ist: Es waren sehr viele, und genug, um eine ganze Ära zu prägen. Aber statt mit Superlativen zu beginnen, lohnt es sich, den Weg in Ruhe nachzuzeichnen.

Der C64 war kein Wunderwerk und kein Zufallstreffer. Er war das Ergebnis einer Zeit, eines Marktes und einer spezifischen Denkweise. Für viele Haushalte war er der erste Computer, der nicht im Arbeitszimmer verschwand, sondern selbstverständlich im Wohnzimmer stand – oft am einzigen Fernseher der Familie. Spätestens mit Spielen wie Summer Games wurde er zum Gemeinschaftsgerät. Nicht selten standen mehrere Generationen gemeinsam vor dem Bildschirm: Kinder mit Ehrgeiz, Eltern mit Neugier, und manchmal griff sogar die Großmutter zum Joystick – und erreichte beim Stabhochsprung Höhen, die man ihr mit Gehstock im Flur nicht zugetraut hätte. Der C64 war einer der ersten Computer, bei dem man niemandem erklären musste, warum er eingeschaltet wurde. Er funktionierte als gemeinsamer Bezugspunkt.

Entstehung unter Zeitdruck und mit klarer Agenda

Geprägt wurde der Ansatz durch Jack Tramiel, dessen Ziel es war, Computer aus der Nische zu holen. Sein Leitsatz „Computers for the masses, not the classes“ war weniger Werbespruch als Geschäftsgrundlage. Für Tramiel war Technik kein Selbstzweck, sondern eine Ressource, die man so lange zuschnitt, bis sie sich verkaufen ließ. Erfahrungen mit dem VIC-20 hatten gezeigt, dass ein Markt für günstige Rechner existierte – doch der Schritt zu einem deutlich leistungsfähigeren System war intern umstritten. Erst die rapide fallenden RAM-Preise Anfang der 1980er-Jahre machten es realistisch, einen Computer mit 64 Kilobyte Arbeitsspeicher wirtschaftlich zu kalkulieren.

Unter erheblichem Zeitdruck – im Vorfeld der CES 1982 – entstand der C64 in ungewöhnlich kurzer Entwicklungszeit. In der Commodore-Organisation wurde das Projekt von Führung und Technik koordiniert; als zentrale Figur gilt Charles Winterble, der als Leiter des weltweiten Engineering-Bereichs die Linie stützte, das System konsequent auf Commodores hauseigene MOS-Technologie und eigens entwickelte Spezialbausteine auszurichten – Grafik, Sound und Systemlogik als Kern einer Plattform, nicht als austauschbare Standardkomponenten. Die Systemarchitektur wird häufig Robert „Bob“ Russell zugeschrieben, der bereits am VIC-20 mitgewirkt hatte und KERNAL-Anteile sowie die BASIC-Integration prägte. David A. Ziembicki gilt als treibende Kraft beim Prototypenbau unter extremem Termindruck. Ebenfalls aus diesem Umfeld stammt Shiraz Shivji, der später eine zentrale Rolle beim Atari ST spielen sollte. Zeitzeugenberichte betonen den enormen Einsatz dieses kleinen Teams – bis hin zu Feiertagen, die im Labor verbracht wurden. Der C64 entstand nicht aus Forschung im Elfenbeinturm, sondern aus Pragmatismus, Tempo und einer klaren Marktstrategie.

Technische und konzeptionelle Altlasten – warum der C64 so wurde, wie er war

Der C64 war kein Rechner vom weißen Reißbrett. Viele seiner Eigenheiten versteht man erst, wenn man ihn als Ergebnis von Kostenentscheidungen, Lagerrealitäten und Zeitdruck betrachtet. So wurde aus Produktions- und Werkzeuggründen zunächst ein Gehäusekonzept weitergeführt, das Commodore bereits kannte – nicht, weil es ideal war, sondern weil Formen, Prozesse und Zulieferketten vorhanden waren. Der Rechner sollte günstiger produzierbar sein als die Konkurrenz; jede vermiedene Neuentwicklung zählte.

Ein ähnliches Prinzip zeigte sich bei der Peripherie. Das Diskettenlaufwerk 1541 war leistungsfähig, wurde aber berüchtigt für vergleichsweise langsame Ladezeiten. Häufig wird dies mit einer Mischung aus Kompatibilitätszielen, engen Zeitplänen und bewusst konservativen Schnittstellenentscheidungen erklärt: Commodore hielt an einer seriellen Philosophie fest, die in der Praxis durch Implementationsdetails und spätere Software-Workarounds deutlich weniger Tempo lieferte, als viele Anwender erwarteten. Der Markt reagierte, wie Märkte reagieren: Turbo-Loader, Fastloader-Cartridges und neue Routinen wurden nicht zur Ausnahme, sondern zum Standardrepertoire der Szene.

Auch auf Software-Ebene war der C64 von Altlasten geprägt. Commodore lizenzierte sein BASIC von Microsoft, setzte aber weiterhin auf BASIC V2 – eine Version, die bereits bei Erscheinen des C64 als schlicht galt. Grafik- und Soundbefehle fehlten vollständig. Was zunächst wie ein Makel wirkt, prägte den Umgang mit dem Rechner nachhaltig: Wer die Fähigkeiten der Hardware ausschöpfen wollte, musste direkt in Speicher und Register greifen. PEEK und POKE wurden dadurch zu Alltagsvokabeln. Der C64 lehrte keine Bequemlichkeit – er belohnte Neugier mit Kontrolle.

Technisches Fundament: stark, eigenwillig, beherrschbar

Im Zentrum arbeitete der MOS 6510, eine angepasste Variante des 6502 mit integriertem I/O-Port, der das Umschalten von Speicherbereichen erleichterte. Dieser Baustein ist ein gutes Beispiel dafür, wie Commodore Technik pragmatisch nutzte: nicht „mehr Leistung um jeden Preis“, sondern „Funktionalität, die das Gesamtsystem vereinfachte“. Dass spätere Systeme ebenfalls 6502-Verwandtschaft nutzten – etwa der 65C816 als CPU-Familienabkömmling in späteren Konsolenwelten – zeigt, wie langlebig diese Architekturidee war, ohne den C64 damit gleichsetzen zu wollen.

Für die Grafik war der VIC-II verantwortlich: Hardware-Sprites, feines Scrolling, Timing-Eigenheiten, die Programmierer liebten und fürchteten. Für den Klang sorgte der SID, der bis heute als Instrument wahrgenommen wird – mit Charakter, Eigenheiten und einem Klangbild, das selten „neutral“, aber oft unverwechselbar war. Ergänzt wurde das Ganze durch die CIA 6526, die mit Timing, Ports und I/O im Alltag mitbestimmte, was am Ende stabil lief – oder eben nicht, wenn am Joystickport elektrisch unsauber experimentiert wurde.

Diese Architektur war nicht elegant, nicht bequem und schon gar nicht zukunftssicher im klassischen Sinn. Aber sie war beherrschbar. Und genau diese Beherrschbarkeit machte den C64 für Millionen von Nutzern produktiv – im Spiel, im Lernen und im Experimentieren.

Revisionen, C64C und der Mythos vom „neuen“ C64

So konstant der C64 nach außen wirkte, so deutlich veränderte sich sein Inneres. Über die lange Produktionszeit entstanden zahlreiche Platinenrevisionen, deren Ziel weniger „neue Features“ als Kostenreduktion, Integrationsgrad und Fertigungsstabilität war. Commodores Leitlinie blieb dabei kompromisslos: maximale Softwarekompatibilität bei sinkenden Produktionskosten.

Frühe Geräte basierten auf großformatigen Platinen, später verschwanden viele TTL-Bausteine, Funktionen wurden zusammengefasst, die Fertigung wurde effizienter. Beim Prozessor findet sich in späteren Modellen häufig der stromsparendere MOS 8500 statt des 6510 – ohne dass der Rechner dadurch „schneller“ würde. Beim Sound kam es zu einem Wechsel vom SID 6581 zum 8580: weniger Grundrauschen, saubereres Verhalten, aber auch ein anderer Charakter. Wer beide kennt, weiß: „besser“ ist hier keine objektive Kategorie – es ist eine Frage des Klangbilds und der jeweiligen Schaltungsauslegung.

Mit dem C64C (umgangssprachlich oft C64 II) wurde diese stille Evolution sichtbar. Das flachere Gehäuse signalisierte Modernisierung, doch der Rechner blieb „ganz der Alte“: kompatibel, vertraut, berechenbar. Dass manche ihn als „leiser“ wahrnahmen, hat nichts mit Lüftern zu tun – es geht um thermische Eigenschaften, Abschirmung, Netzteil- und Bauteilverhalten. In Deutschland wurde das Thema Modellpflege zusätzlich durch den legendären Massenverkauf geprägt: Der Aldi-C64 steht sinnbildlich für den Moment, in dem ein Heimcomputer endgültig im Alltag ankam – inklusive kleiner Varianten-Details, die den Normalanwender kaum störten, Bastler aber bis heute diskutieren.

Markt und Konkurrenz: gleiche Epoche, unterschiedliche Realitäten

Entscheidender als bloße Marktanteile war, wie früh ein System in einem Land verfügbar war – und zu welchem Preis. In Großbritannien hatte der ZX Spectrum am 23. April 1982 einen deutlichen Vorsprung und dominierte dort lange Zeit das Bild des Heimcomputers: günstiger, kulturell verankert, früh verfügbar. Der C64 war in UK erfolgreich, blieb aber oft die Nummer zwei – nicht weil er technisch schwach gewesen wäre, sondern weil der Markt bereits besetzt war.

Auf dem Kontinent verschoben sich die Kräfte. In Deutschland konnte der C64 seine Stärken bei Grafik und Sound gut ausspielen und profitierte von einer ungewöhnlich breiten Verfügbarkeit: Fachhandel, Versandhäuser, Kaufhäuser – später sogar Discounter. Erst 1984 trat mit dem Amstrad CPC 464 ein weiterer starker Gegner auf, der mit Monitor-Bundle, „Komplettpaket“-Denke und einer anderen Positionierung punktete. In Frankreich wurde der CPC besonders populär; in Deutschland trat er als Schneider-CPC auf. Das sind keine Randdetails, sondern erklärt, warum „der“ europäische Heimcomputermarkt nie einheitlich war.

Preislich ist der C64 zugleich Paradebeispiel für Commodores aggressive Strategie. Zum UK-Start lag der Preis bei 399 £ (inflationsbereinigt grob etwa £ 1.500; rund € 1.750). In Deutschland startete er bei 1.495 DM (inflationsbereinigt grob etwa € 1.757; rund £ 1.500). In Frankreich wurden zur Einführung etwa 4.500–5.000 FF genannt (inflationsbereinigt grob etwa € 1.650; rund £ 1.400). In den USA startete er bei 595 US-Dollar (inflationsbereinigt grob etwa £ 1.550; rund € 1.800). Diese Preislandschaft war dynamisch: rasche Preissenkungen machten den C64 in kurzer Zeit vom Luxusgerät zum Massenprodukt. In den USA eskalierte dies zum Preiskrieg, der Konkurrenten wie Texas Instruments in die Knie zwang – ein seltener Moment, in dem aggressive Preispolitik den Markt tatsächlich neu sortierte.

Software, die den Rechner zum Wohnzimmergerät machte

Das Software-Ökosystem war der Hebel, mit dem der C64 seine Hardware in Alltagsrelevanz verwandelte. Spiele wie Summer Games machten den Rechner zum Familiengerät, weil sie ohne große Schwelle verstanden wurden – und gleichzeitig genug Tiefe hatten, um Ehrgeiz auszulösen. Andere Titel wurden zu Symbolen einer „reifen“ 8-Bit-Ära: International Karate zeigte internationale Schlagkraft europäischer Entwickler, The Last Ninja wurde zum Synonym für aufwendige Präsentation und atmosphärische Dichte auf dem C64. Bei einzelnen, später oft zitierten Millionenzahlen ist Vorsicht geboten; wichtiger ist die Relation: Bei einer installierten Basis im zweistelligen Millionenbereich bedeutete bereits ein siebenstelliger Absatz eine Marktdurchdringung, die man in der damaligen Zeit nur bei wenigen Produkten sah.

Für die Langlebigkeit des Systems war jedoch nicht nur Spiele-Software entscheidend. Mit GEOS zog eine grafische Oberfläche ein, die den C64 in eine neue Rolle rücken konnte: Maus, Desktop-Metapher, Programme wie GeoWrite und GeoPaint. Zeitgenössische Einschätzungen betonten dabei gerade, dass die Hardware im Kern gleich blieb – und dass genau das den Reiz ausmachte. GEOS war kein „neuer C64“, sondern ein neuer Blick auf denselben Rechner.

Szene, Raubkopien und die kulturelle Aneignung

Für viele Jugendliche war die Szene kein Beiwerk, sondern der eigentliche Zugang zur Technik. Software wurde getauscht, Disketten wurden kopiert, katalogisiert, weitergereicht. Das war soziale Realität und wirtschaftlicher Streitpunkt zugleich. Statt moralisch zu urteilen, muss man historisch nüchtern feststellen: Diese informellen Verbreitungswege erhöhten die Reichweite des Systems, hielten Nutzer am C64 und schufen eine kritische Masse, die Entwickler, Magazine und Zubehör anlockte.

Aus Kopierpraxis wurde Technikpraxis. Kopierschutz wurde analysiert, Cracks verbreitet, Cracktros entstanden als Signatur – später als Wettbewerb. Aus frühen Einzelakteuren und losen Zusammenschlüssen wuchs eine international vernetzte Gruppenlandschaft mit klaren Rollen: Cracker, Supplier, Intro-Coder, Grafiker, Musiker. Der Übergang von Cracktro zu Demo war fließend: Rastereffekte, Scroller, Soundroutinen und präzises Timing wurden zur eigenen Kunstform. Wer das einmal ernsthaft gesehen hat, versteht: Die Demokultur war nicht nur „Show“, sondern ein Beweis, wie tief diese Szene die Maschine verstand.

Magazinen kam dabei eine Schlüsselrolle zu. Listings waren nicht nur Unterhaltung, sondern eine Form von Wissensverbreitung: abtippen, Fehler suchen, Speicheradressen verstehen – und lernen, wie ein Computer „denkt“. Genau diese Mischung aus offener Maschine, stabiler Hardwarebasis und kultureller Praxis erklärt, warum der C64 nicht nur benutzt, sondern angeeignet wurde.

Langlebigkeit, Auslaufen, Erbe

Der C64 verschwand nicht einfach, als er technisch überholt war. Er blieb präsent, weil er wirtschaftlich billig produzierbar wurde, weil er eine riesige Softwarebasis hatte und weil die Szene das System als Herausforderung weitertrug. Weltweit werden die Verkäufe meist im Bereich von 12,5 bis 17 Millionen verortet; höhere Zahlen kursieren, sind aber weniger belastbar. Entscheidend ist nicht die letzte Nachkommastelle, sondern die Wirkung: Der C64 war ein industrielles Massenprodukt – und zugleich ein kulturelles Ereignis.

Der Übergang zum Commodore Amiga erfolgte nicht als harter Schnitt. Beide Systeme existierten lange nebeneinander: Der Amiga stand für den technischen Sprung, der C64 für Verbreitung, Verlässlichkeit und das, was man heute „installierte Basis“ nennt. Als der C64 schließlich auslief, blieb sein Abdruck: in der Demokultur, in der Retro-Hardware-Szene, in Remakes, Emulatoren, Neuauflagen – und in der Erinnerung daran, dass Computer einmal Geräte waren, die man nicht nur konsumierte, sondern verstand.

Und vielleicht liegt genau darin der Grund, warum man auch heute noch über ihn schreiben kann, ohne sich zu wiederholen.

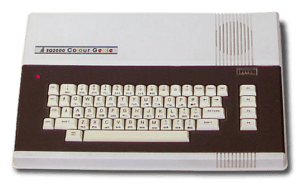

Die frühen 1980er-Jahre brachten weltweit eine große Zahl neuer Heim- und Bürocomputer hervor. Sinkende Chippreise und ein wachsendes Interesse an privater Rechentechnik führten dazu, dass innerhalb weniger Jahre zahlreiche Systeme auf den Markt kamen. In Europa prägten vor allem einige bekannte Hersteller das Bild dieser Zeit, während andere Ansätze regional begrenzt blieben oder früh wieder verschwanden. Neben den etablierten Linien existierten jedoch auch Rechner, die sich zwischen Arbeitsgerät, Lernmaschine und Heimcomputer einordnen ließen. Ein solcher Ansatz war der EACA Colour Genie (EG-2000).

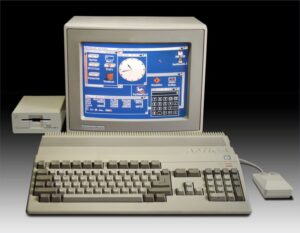

Die frühen 1980er-Jahre brachten weltweit eine große Zahl neuer Heim- und Bürocomputer hervor. Sinkende Chippreise und ein wachsendes Interesse an privater Rechentechnik führten dazu, dass innerhalb weniger Jahre zahlreiche Systeme auf den Markt kamen. In Europa prägten vor allem einige bekannte Hersteller das Bild dieser Zeit, während andere Ansätze regional begrenzt blieben oder früh wieder verschwanden. Neben den etablierten Linien existierten jedoch auch Rechner, die sich zwischen Arbeitsgerät, Lernmaschine und Heimcomputer einordnen ließen. Ein solcher Ansatz war der EACA Colour Genie (EG-2000). Ist es wirklich notwendig, über den Amiga 500 zu schreiben? Über einen Computer, den viele als ihren ersten „echten“ Rechner erlebt haben, über den sich Mythen ranken, dessen Name noch heute nostalgische Reflexe auslöst? Vielleicht ist es genau deshalb notwendig. Denn der Amiga 500 war nicht nur ein Erfolgsmodell, sondern ein kulturelles Phänomen – eines, dessen Bedeutung sich erst im Rückblick vollständig erschließt. Wir sprechen von einem Computer, der millionenfach verkauft wurde, der Generationen prägte und dennoch wirtschaftlich nie jene Stabilität erreichte, die sein Einfluss vermuten ließe. Zeit also, den Amiga 500 in Ruhe einzuordnen. Der Amiga 500 war weniger Neuentwicklung als bewusste Neupositionierung.

Ist es wirklich notwendig, über den Amiga 500 zu schreiben? Über einen Computer, den viele als ihren ersten „echten“ Rechner erlebt haben, über den sich Mythen ranken, dessen Name noch heute nostalgische Reflexe auslöst? Vielleicht ist es genau deshalb notwendig. Denn der Amiga 500 war nicht nur ein Erfolgsmodell, sondern ein kulturelles Phänomen – eines, dessen Bedeutung sich erst im Rückblick vollständig erschließt. Wir sprechen von einem Computer, der millionenfach verkauft wurde, der Generationen prägte und dennoch wirtschaftlich nie jene Stabilität erreichte, die sein Einfluss vermuten ließe. Zeit also, den Amiga 500 in Ruhe einzuordnen. Der Amiga 500 war weniger Neuentwicklung als bewusste Neupositionierung.

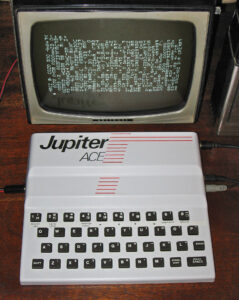

Als der Jupiter Ace im Herbst 1982 erschien, war er zugleich ein Produkt seiner Zeit und ein bewusster Gegenentwurf zu ihr. Entwickelt wurde der Rechner von Richard Altwasser und Steven Vickers, zwei Ingenieuren, die zuvor maßgeblich für Sinclair Research gearbeitet hatten. Altwasser war bereits an der Entwicklung des

Als der Jupiter Ace im Herbst 1982 erschien, war er zugleich ein Produkt seiner Zeit und ein bewusster Gegenentwurf zu ihr. Entwickelt wurde der Rechner von Richard Altwasser und Steven Vickers, zwei Ingenieuren, die zuvor maßgeblich für Sinclair Research gearbeitet hatten. Altwasser war bereits an der Entwicklung des

Wenn vier Pixelhelden losziehen, um einen Kelch zu retten, den niemand je gesehen hat, dann ist das entweder der Auftakt zu einer Bibelverfilmung – oder zu Dunjunz. Letzteres trifft zu. Das 1987 von Bug-Byte veröffentlichte Spiel für BBC Micro und Acorn Electron ist im Prinzip das britische Pendant zu Gauntlet – nur mit mehr Charme, mehr Tastenchaos und weniger Amerikanismus. Der Titel klingt wie das Ergebnis einer nächtlichen DSA-Runde mit zu viel Bier und zu wenig Vokalen – und ist dabei eines der ambitioniertesten Projekte für BBC Micro überhaupt.

Wenn vier Pixelhelden losziehen, um einen Kelch zu retten, den niemand je gesehen hat, dann ist das entweder der Auftakt zu einer Bibelverfilmung – oder zu Dunjunz. Letzteres trifft zu. Das 1987 von Bug-Byte veröffentlichte Spiel für BBC Micro und Acorn Electron ist im Prinzip das britische Pendant zu Gauntlet – nur mit mehr Charme, mehr Tastenchaos und weniger Amerikanismus. Der Titel klingt wie das Ergebnis einer nächtlichen DSA-Runde mit zu viel Bier und zu wenig Vokalen – und ist dabei eines der ambitioniertesten Projekte für BBC Micro überhaupt.

Fiendish Freddy’s Big Top O’ Fun, entwickelt von Gray Matter Inc. unter Leitung von Chris Gray und veröffentlicht 1989 von Mindscape, ist ein grellbuntes, schwarzhumoriges Zirkusspiel, das mit sechs teils brutalen Minispielen in Folge für offene Münder und verkrampfte Joystickhände sorgte. Der Spieler übernimmt die Rolle eines Zirkusdirektors, der versucht, seinen heruntergekommenen Betrieb mit spektakulären Shows vor der endgültigen Schließung zu retten. 10.000 Dollar müssen verdient werden, doch da ist Fiendish Freddy – ein zynischer Saboteur mit Zylinder und Zigarrenschneidern, der nichts lieber tut, als den Artisten das Leben zur Hölle zu machen.

Fiendish Freddy’s Big Top O’ Fun, entwickelt von Gray Matter Inc. unter Leitung von Chris Gray und veröffentlicht 1989 von Mindscape, ist ein grellbuntes, schwarzhumoriges Zirkusspiel, das mit sechs teils brutalen Minispielen in Folge für offene Münder und verkrampfte Joystickhände sorgte. Der Spieler übernimmt die Rolle eines Zirkusdirektors, der versucht, seinen heruntergekommenen Betrieb mit spektakulären Shows vor der endgültigen Schließung zu retten. 10.000 Dollar müssen verdient werden, doch da ist Fiendish Freddy – ein zynischer Saboteur mit Zylinder und Zigarrenschneidern, der nichts lieber tut, als den Artisten das Leben zur Hölle zu machen.

Quiffy, das letzte Wesen seiner Art, kämpfte bereits 1990 mit einem heute leider allzu üblichen Problem, die Umweltverschmutzung, hier eher die Kanalisationsverschmutzung. Diese setzt dem Charakter, das wie das Produkt einer Liebesnacht zwischen einem Alien und einer panzerlosen Schildkröte daherkommt, ordentlich zu. Das sich natürlich auch andere Wesen dort unten tummeln und sich nicht mit Quiffy verstehen (beispielsweise Teddybären mit Reißzähnen in Bauchhöhe) verschärft die Sachlage ebenso, wie das stetig steigende Wasserniveau, dass den Spieler zusätzlich unter Druck setzt. Als wäre das noch nicht genug, wird Quiffy vom Geist seiner verstorbenen Tante Matilda verfolgte. Matilda imitiert die gesamten Bewegungen des Protagonisten, beginnt jedoch mit einer 15 sekündigen Zeitverzögerung. Allerdings ist die alte Dame deutlich schneller als Quiffy.

Quiffy, das letzte Wesen seiner Art, kämpfte bereits 1990 mit einem heute leider allzu üblichen Problem, die Umweltverschmutzung, hier eher die Kanalisationsverschmutzung. Diese setzt dem Charakter, das wie das Produkt einer Liebesnacht zwischen einem Alien und einer panzerlosen Schildkröte daherkommt, ordentlich zu. Das sich natürlich auch andere Wesen dort unten tummeln und sich nicht mit Quiffy verstehen (beispielsweise Teddybären mit Reißzähnen in Bauchhöhe) verschärft die Sachlage ebenso, wie das stetig steigende Wasserniveau, dass den Spieler zusätzlich unter Druck setzt. Als wäre das noch nicht genug, wird Quiffy vom Geist seiner verstorbenen Tante Matilda verfolgte. Matilda imitiert die gesamten Bewegungen des Protagonisten, beginnt jedoch mit einer 15 sekündigen Zeitverzögerung. Allerdings ist die alte Dame deutlich schneller als Quiffy.