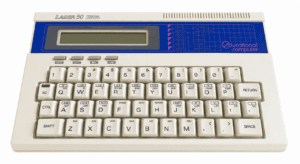

Es ist Mitte der 1980er Jahre, und während Systeme wie der Commodore 64 oder der ZX Spectrum den heimischen Schreibtisch erobern, verfolgt ein Hersteller aus Hongkong einen anderen Ansatz: Computer sollen nicht nur zu Hause stehen, sondern überallhin mitgenommen werden können – und vor allem eines tun: Programmieren lehren. In genau diesem Spannungsfeld entsteht der Video Technology Laser 50, ein Gerät, das sich selbstbewusst als „BASIC learning tool that teaches you BASIC“ bezeichnete.

Es ist Mitte der 1980er Jahre, und während Systeme wie der Commodore 64 oder der ZX Spectrum den heimischen Schreibtisch erobern, verfolgt ein Hersteller aus Hongkong einen anderen Ansatz: Computer sollen nicht nur zu Hause stehen, sondern überallhin mitgenommen werden können – und vor allem eines tun: Programmieren lehren. In genau diesem Spannungsfeld entsteht der Video Technology Laser 50, ein Gerät, das sich selbstbewusst als „BASIC learning tool that teaches you BASIC“ bezeichnete.

Hergestellt wurde der Rechner von VTech, einem Unternehmen, das in den 1980er Jahren sowohl im Bereich preisgünstiger Lernsysteme als auch bei kompatiblen Heimcomputern aktiv war. Der Laser 50 erschien um 1984/85 und wurde je nach Markt unterschiedlich vertrieben – in Frankreich etwa unter der Bezeichnung „Laser One“. Technisch blieb das System dabei unverändert, doch die Umbenennung unterstreicht die Positionierung als Einsteigergerät.

Auf den ersten Blick wirkt der Laser 50 eigenwillig. Statt eines klassischen Bildschirms besitzt er ein einzeiliges LCD mit lediglich 16 Zeichen. Programme müssen daher horizontal durch den Text scrollen, was die Arbeit verlangsamt und eine gewisse Disziplin beim Programmieren erfordert. Im Inneren arbeitet ein Z80-kompatibler Prozessorkern, allerdings nicht als klassischer Einzelchip. Während Systeme wie der Sinclair ZX81 noch klar getrennte Komponenten für CPU, RAM und ROM zeigen, setzt der Laser 50 auf eine stark integrierte Bauweise. Prozessorfunktion, Tastatursteuerung und Displaylogik sind in wenigen spezialisierten Bausteinen zusammengefasst – ein Ansatz, der Kosten spart, aber zugleich Einblicke und Erweiterungen erschwert.

Der Arbeitsspeicher beträgt lediglich 2 Kilobyte RAM, was den verfügbaren Spielraum deutlich begrenzt. Über einen Erweiterungsanschluss lässt sich der Speicher jedoch auf bis zu 16 Kilobyte ausbauen, wodurch sich komplexere Programme realisieren lassen. Trotz dieser Einschränkung war das System in der Lage, bis zu zehn BASIC-Programme gleichzeitig zu verwalten. Diese blieben im Speicher erhalten, solange die Stromversorgung nicht vollständig unterbrochen wurde – ein Detail, das im Alltag überraschend praktisch war.

Der Laser 50 versteht sich klar als Lernsystem. Das Handbuch wird in zeitgenössischen Beschreibungen als besonders zugänglich und praxisnah geschildert, mit zahlreichen Beispielprogrammen und erklärenden Abschnitten. Ergänzt wird dies durch einen Trace-Modus, der Programme schrittweise ausführt und so den Ablauf einzelner Befehle sichtbar macht. Variablen lassen sich dabei beobachten, was das Verständnis von Programmstrukturen erleichtert. Für ein Gerät dieser Größenklasse ist das bemerkenswert konsequent umgesetzt.

Im praktischen Einsatz treten jedoch schnell die Grenzen zutage. Die Tastatur ist vollständig, aber ungewöhnlich angeordnet; insbesondere die Position der Leertaste verlangt Eingewöhnung. Hinzu kommt eine technische Einschränkung, die sich im Alltag bemerkbar macht: Das System verarbeitet Eingaben nur bis zu einer Geschwindigkeit von etwa 20 Wörtern pro Minute zuverlässig. Schnellere Eingaben führen zu ausgelassenen oder doppelt registrierten Zeichen – ein Effekt, der den Arbeitsfluss spürbar beeinflussen kann.

Neben dem Computerbetrieb verfügt der Laser 50 über einen integrierten Taschenrechner-Modus mit wissenschaftlichen Funktionen. Diese Kombination aus Programmierumgebung und Rechenwerkzeug verdeutlicht die Zielgruppe: Schüler, Einsteiger und Anwender, die unterwegs einfache Berechnungen durchführen oder kleine Programme nutzen wollten. Zubehör wie Kassettenrekorder, Thermodrucker oder sogar ein vierfarbiger Plotter erweiterten die Einsatzmöglichkeiten, auch wenn solche Peripherie vermutlich nur von einem kleinen Teil der Nutzer tatsächlich eingesetzt wurde.

Preislich bewegte sich der Laser 50 nach zeitgenössischen Einschätzungen im Bereich von etwa 100 bis 150 US-Dollar, was inflationsbereinigt heute ungefähr 280 bis 450 Euro entspricht. Damit lag er deutlich unter klassischen Heimcomputern, aber über einfachen Taschenrechnern – eine Zwischenposition, die seine Rolle im Markt treffend beschreibt.

Im Vergleich zu tragbaren Systemen wie dem TRS-80 Pocket Computer zeigt sich, dass der Laser 50 zwar komfortabler zu bedienen war, jedoch nicht die Leistungsfähigkeit eines vollwertigen Heimcomputers erreichte. Gleichzeitig fehlte ihm eine breitere Softwarebasis, was seine langfristige Nutzung einschränkte.

Über das Gerät selbst ist heute nur wenig dokumentiert. Zeitgenössische Testberichte sind selten, technische Unterlagen nur fragmentarisch erhalten. Ein Großteil des Wissens basiert auf erhaltenen Geräten, Handbüchern und späteren Analysen durch Sammler. Diese lückenhafte Quellenlage ist jedoch kein Zufall, sondern typisch für eine Geräteklasse, die eher als Lernwerkzeug denn als Plattform für eine wachsende Softwarekultur gedacht war.

Der Laser 50 ist damit kein System, das durch Leistung oder Verbreitung auffiel, sondern eines, das einen sehr spezifischen Ansatz verfolgte: Programmieren zugänglich zu machen, ohne die Hürde eines großen, teuren Heimcomputers. Gerade diese Zwischenstellung macht ihn heute interessant – als Zeugnis einer Phase, in der Computer klein genug wurden, um sie mitzunehmen, aber noch weit davon entfernt waren, universell einsetzbar zu sein.

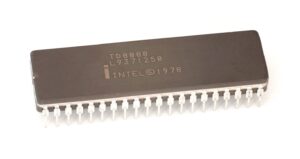

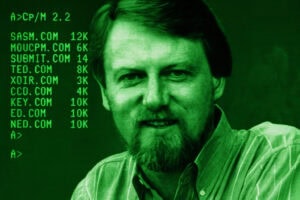

Seattle, Frühjahr 1980. In den Büroräumen von Seattle Computer Products sitzt ein junger Entwickler über einem neuen Projekt. Die Firma hat gerade eine Prozessorplatine für den Intel 8086 entwickelt – eine leistungsfähige 16-Bit-CPU, die auf dem damals verbreiteten S-100-Bus eingesetzt werden soll. Doch ohne ein Betriebssystem bleibt die Hardware kaum nutzbar. Also beginnt der Ingenieur Tim Paterson, ein eigenes System zu schreiben. In wenigen Wochen entsteht ein funktionierendes System, das intern den pragmatischen Namen „Quick and Dirty Operating System“ erhält. Jahrzehnte später erinnerte sich Paterson nüchtern an diese Situation: Er habe das System schlicht geschrieben, „weil wir ein Betriebssystem für die

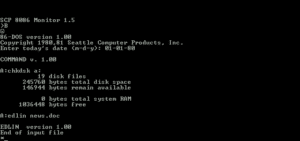

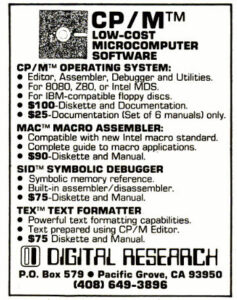

Seattle, Frühjahr 1980. In den Büroräumen von Seattle Computer Products sitzt ein junger Entwickler über einem neuen Projekt. Die Firma hat gerade eine Prozessorplatine für den Intel 8086 entwickelt – eine leistungsfähige 16-Bit-CPU, die auf dem damals verbreiteten S-100-Bus eingesetzt werden soll. Doch ohne ein Betriebssystem bleibt die Hardware kaum nutzbar. Also beginnt der Ingenieur Tim Paterson, ein eigenes System zu schreiben. In wenigen Wochen entsteht ein funktionierendes System, das intern den pragmatischen Namen „Quick and Dirty Operating System“ erhält. Jahrzehnte später erinnerte sich Paterson nüchtern an diese Situation: Er habe das System schlicht geschrieben, „weil wir ein Betriebssystem für die  Das Projekt erhielt intern zunächst den Namen QDOS, eine Abkürzung für „Quick and Dirty Operating System“. In frühen Anzeigen und Produktinformationen von Seattle Computer Products wurde diese Bezeichnung zeitweise auch öffentlich verwendet. Schon bald entschied sich das Unternehmen jedoch für den Namen 86-DOS, der sich direkt auf den verwendeten Intel-Prozessor bezog und professioneller wirkte.

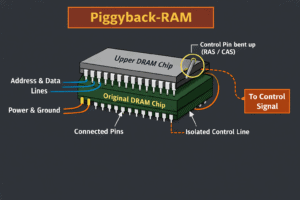

Das Projekt erhielt intern zunächst den Namen QDOS, eine Abkürzung für „Quick and Dirty Operating System“. In frühen Anzeigen und Produktinformationen von Seattle Computer Products wurde diese Bezeichnung zeitweise auch öffentlich verwendet. Schon bald entschied sich das Unternehmen jedoch für den Namen 86-DOS, der sich direkt auf den verwendeten Intel-Prozessor bezog und professioneller wirkte. In den frühen 1980er-Jahren stieg der Bedarf an Arbeitsspeicher deutlich schneller, als es die Entwickler vieler Heim- und Mikrocomputer vorgesehen hatten. Die Hürden für Upgrades waren hoch: RAM-Bausteine waren kostspielig, passende Erweiterungskarten oft nicht lieferbar oder im Gehäuse schlicht nicht vorgesehen. In dieser Situation etablierte sich unter Bastlern und Servicetechnikern eine pragmatische Lösung, die als Piggybacking bekannt wurde: Ein zusätzlicher Speicherchip wurde direkt auf einen vorhandenen Baustein gelötet – gewissermaßen „Huckepack“.

In den frühen 1980er-Jahren stieg der Bedarf an Arbeitsspeicher deutlich schneller, als es die Entwickler vieler Heim- und Mikrocomputer vorgesehen hatten. Die Hürden für Upgrades waren hoch: RAM-Bausteine waren kostspielig, passende Erweiterungskarten oft nicht lieferbar oder im Gehäuse schlicht nicht vorgesehen. In dieser Situation etablierte sich unter Bastlern und Servicetechnikern eine pragmatische Lösung, die als Piggybacking bekannt wurde: Ein zusätzlicher Speicherchip wurde direkt auf einen vorhandenen Baustein gelötet – gewissermaßen „Huckepack“.

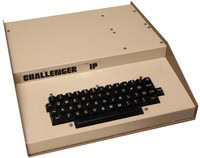

Der Amstrad CPC (Colour Personal Computer), eine Heimcomputer-Serie aus Großbritannien, wurde 1984 von Amstrad unter der Leitung von Alan Michael Sugar veröffentlicht. Die Serie war Amstrads Antwort auf die Dominanz von Commodore, Sinclair und Acorn im britischen Heimcomputermarkt der frühen 1980er Jahre. Sugar, ein britischer Unternehmer aus einfachen Verhältnissen, hatte sich bis dahin mit billigen Stereoanlagen und Haushaltsgeräten einen Namen gemacht. Mit dem CPC wollte er in den expandierenden Heimcomputermarkt einsteigen, allerdings mit einer radikal anderen Herangehensweise: statt einem nackten Motherboard wie beim Sinclair

Der Amstrad CPC (Colour Personal Computer), eine Heimcomputer-Serie aus Großbritannien, wurde 1984 von Amstrad unter der Leitung von Alan Michael Sugar veröffentlicht. Die Serie war Amstrads Antwort auf die Dominanz von Commodore, Sinclair und Acorn im britischen Heimcomputermarkt der frühen 1980er Jahre. Sugar, ein britischer Unternehmer aus einfachen Verhältnissen, hatte sich bis dahin mit billigen Stereoanlagen und Haushaltsgeräten einen Namen gemacht. Mit dem CPC wollte er in den expandierenden Heimcomputermarkt einsteigen, allerdings mit einer radikal anderen Herangehensweise: statt einem nackten Motherboard wie beim Sinclair